VALSE2020在线大会 网络架构设计与类脑 20200805会议记录

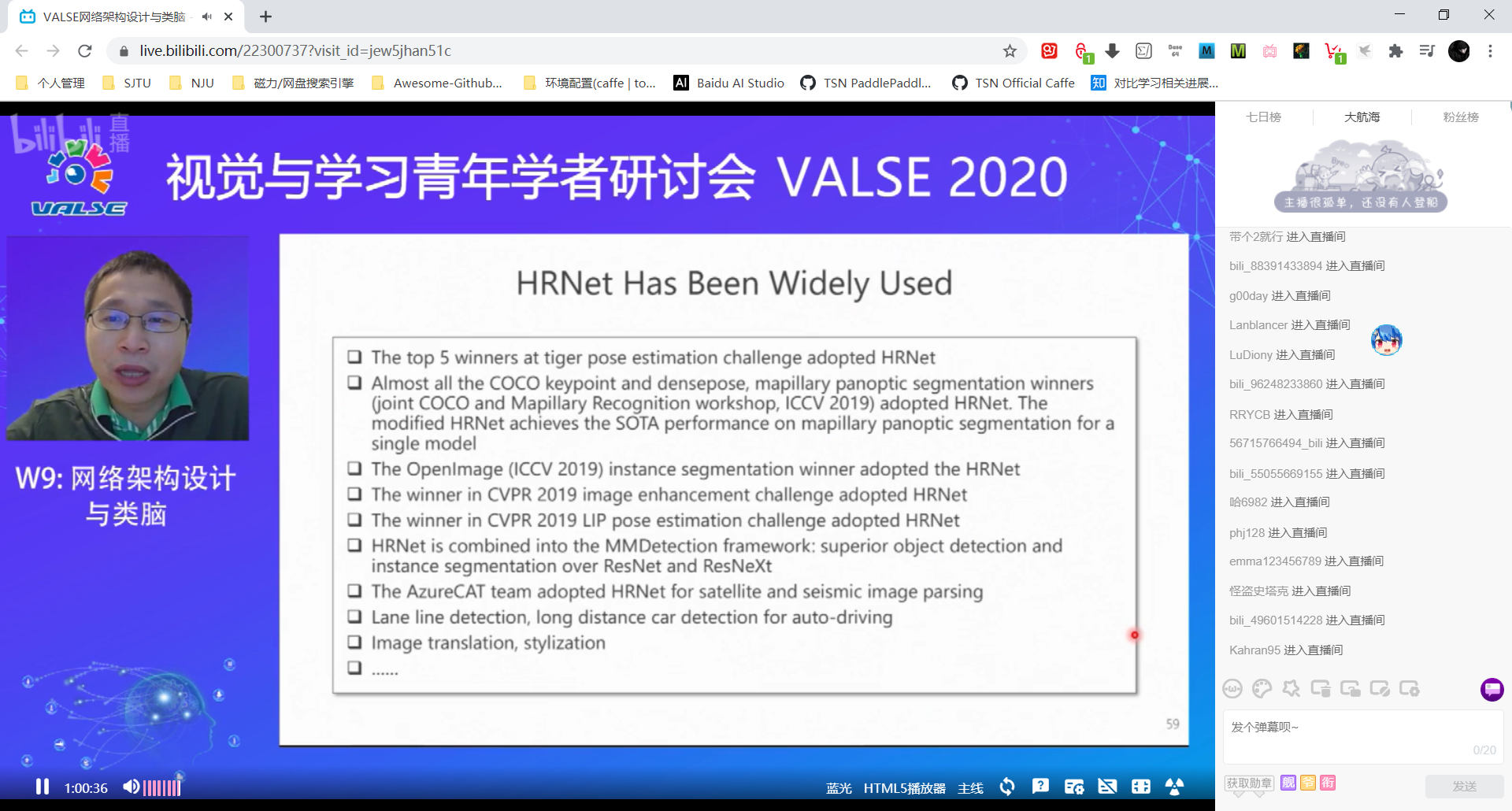

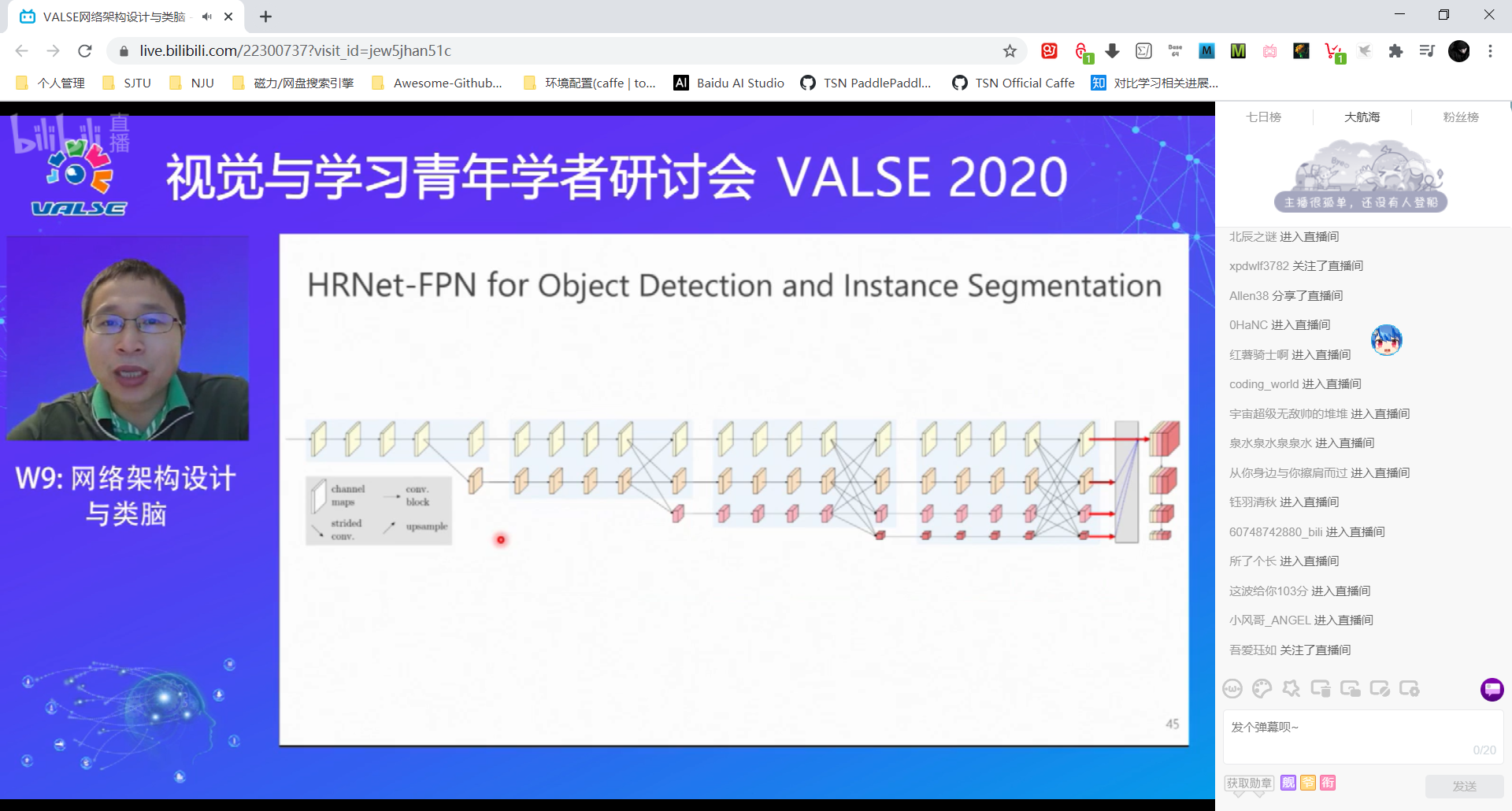

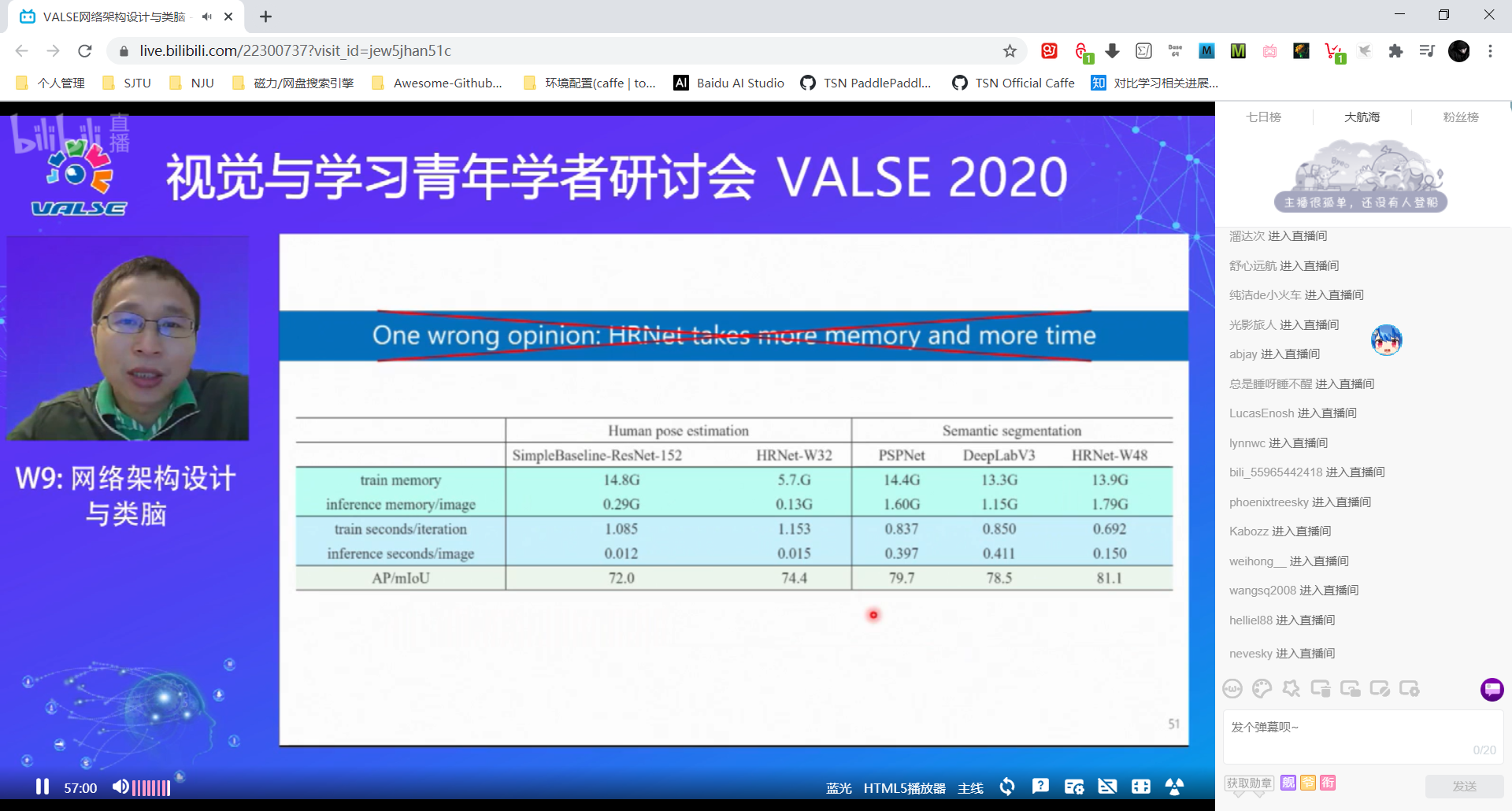

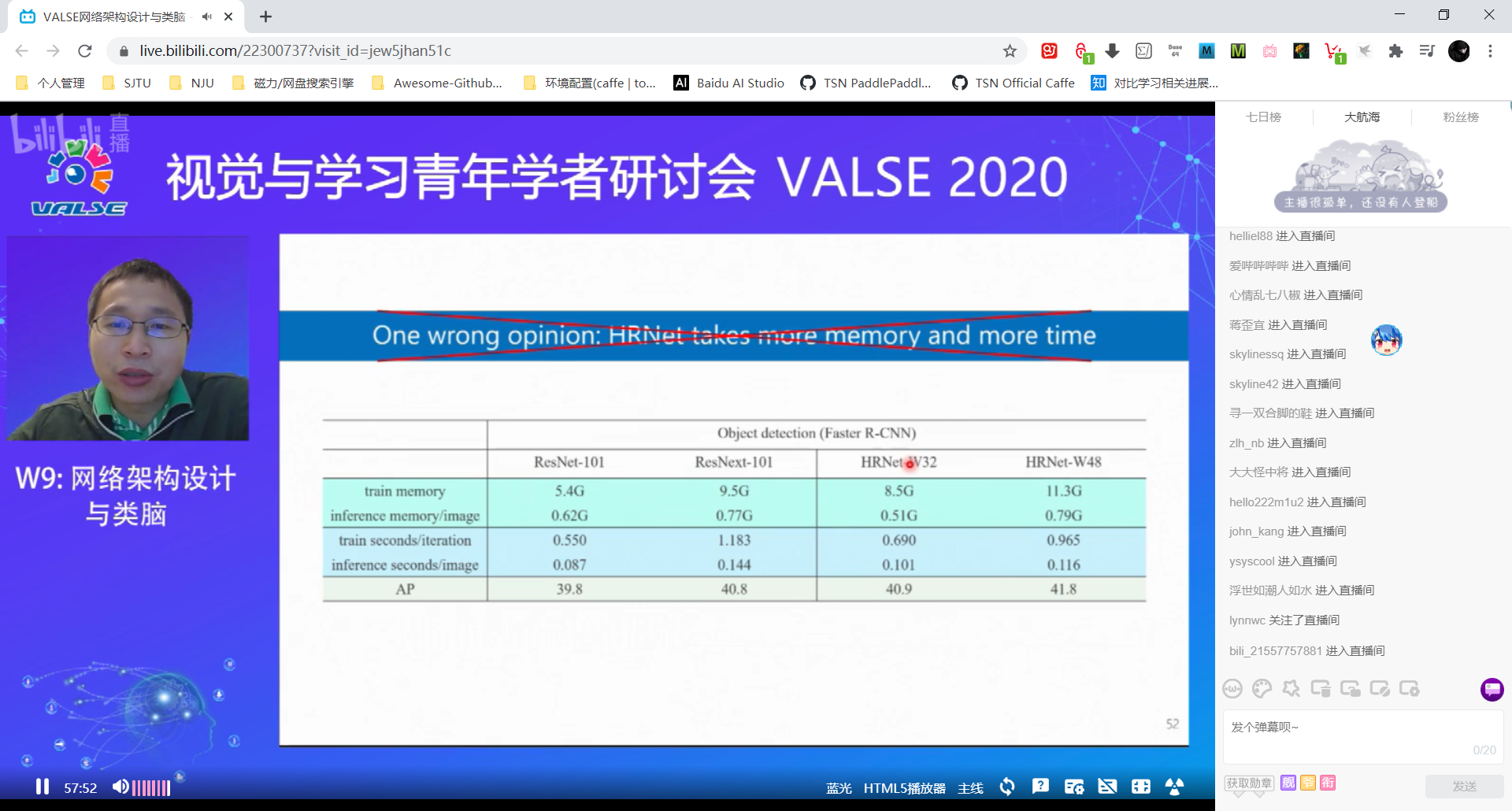

1. High-Resolution Networks: A Universal Architecture for Visual Recognition

【时间】09:00-09:40

【讲者】王井东(Microsoft Research)

【题目】High-Resolution Networks: A Universal Architecture for Visual Recognition

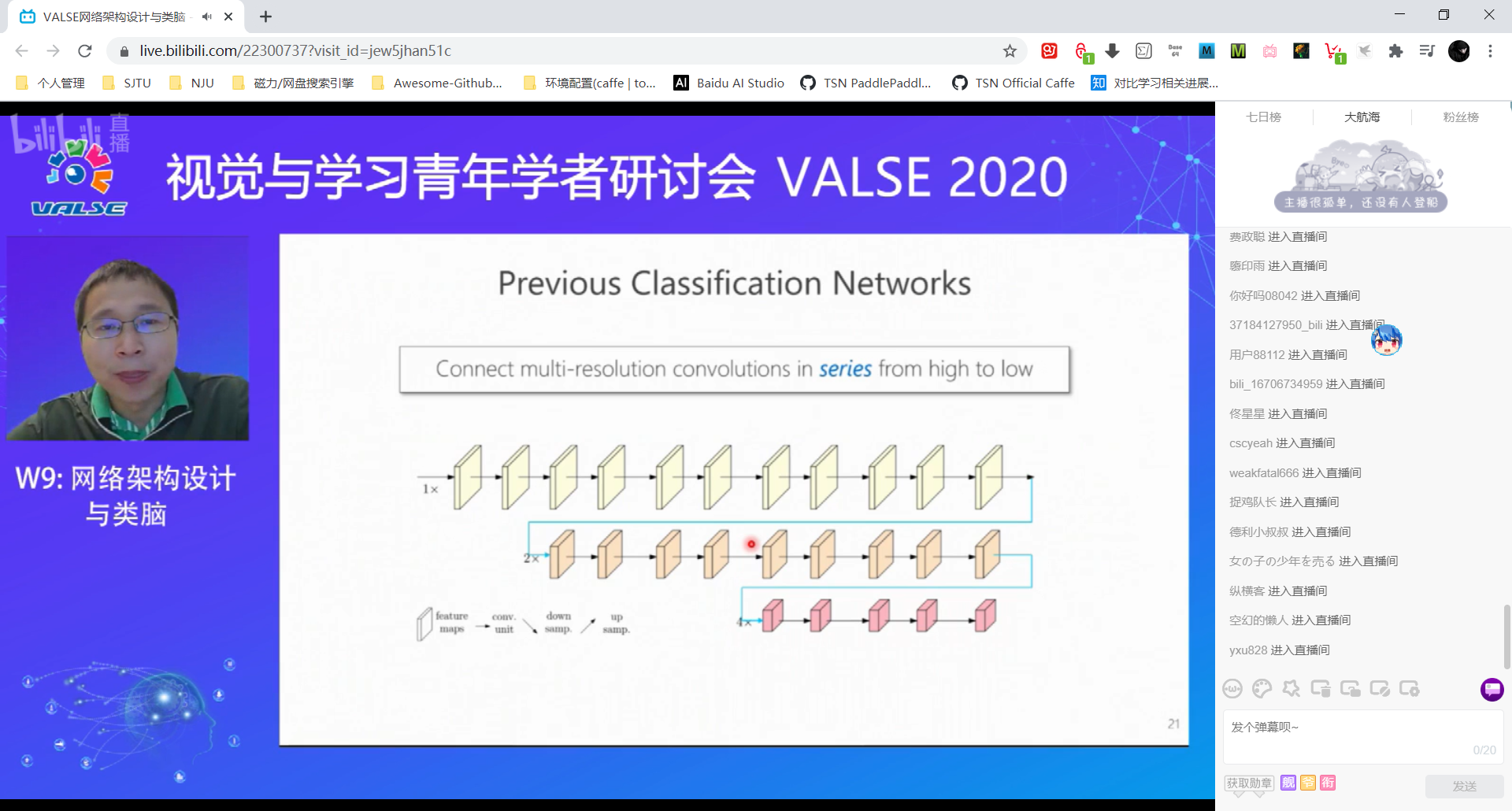

传统的分类网络:learn low-resolution representation

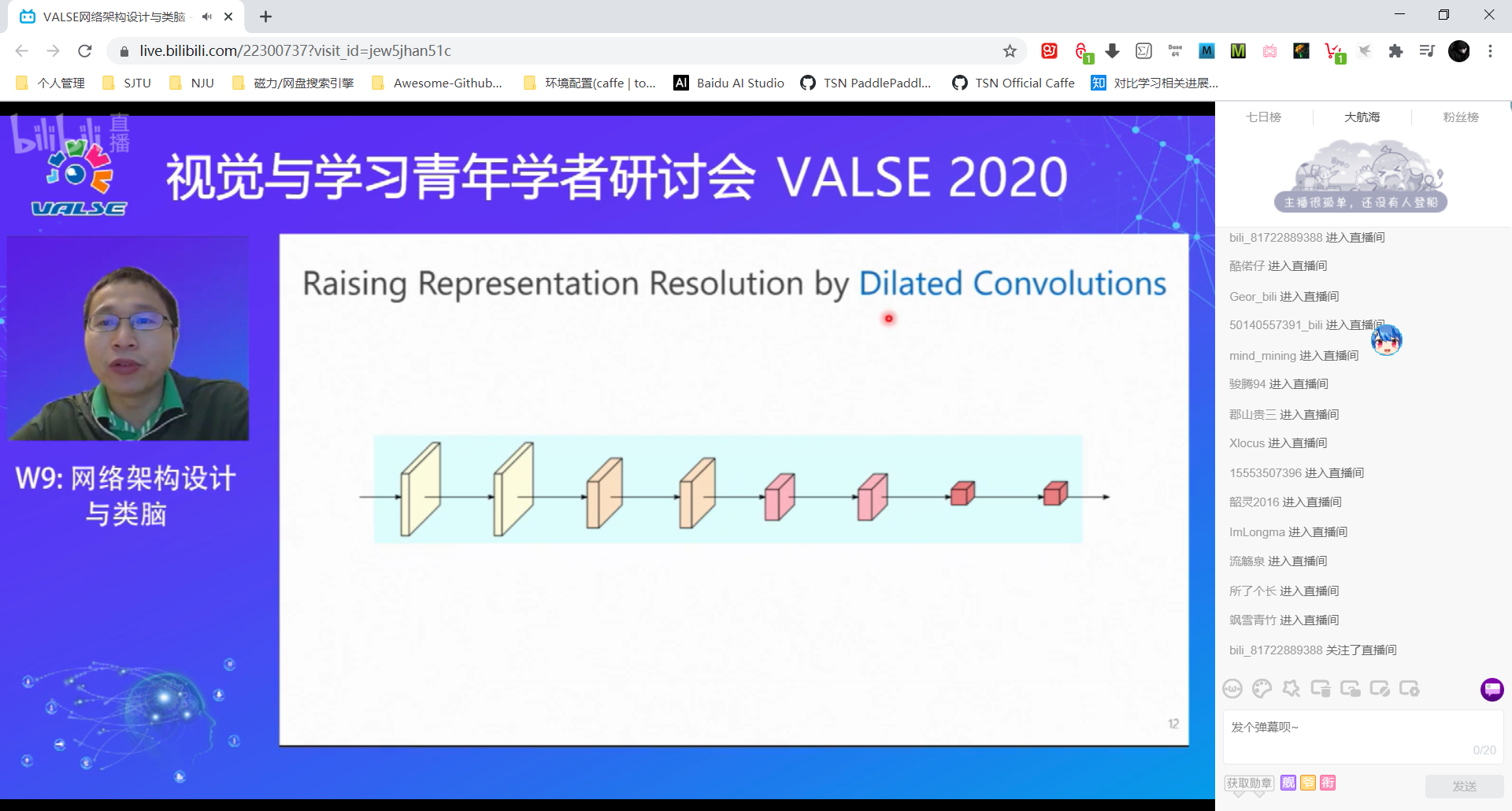

空洞卷积计算量大

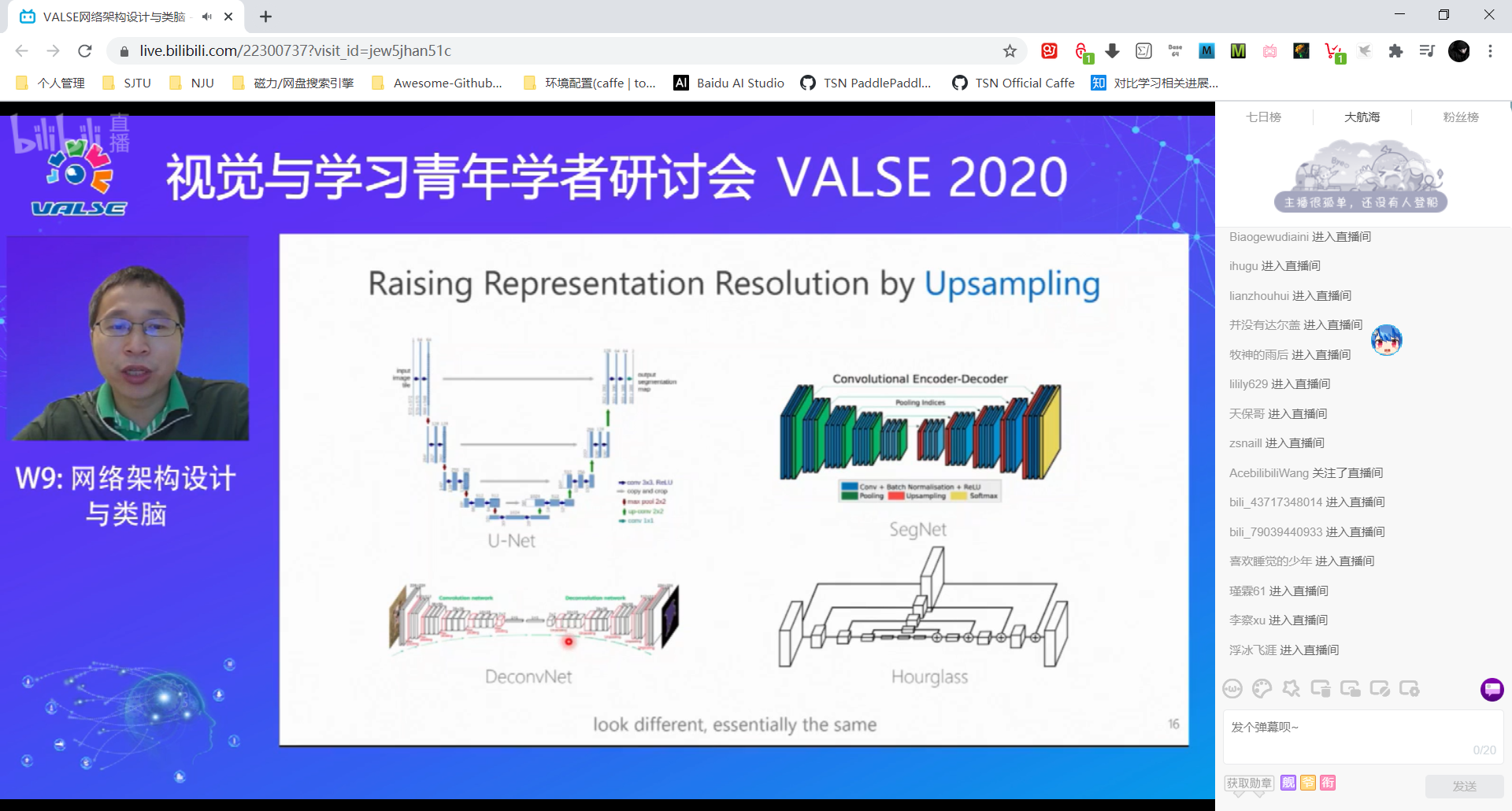

上采样的性能不太好,低分辨率特征到高分辨率的学习比较弱

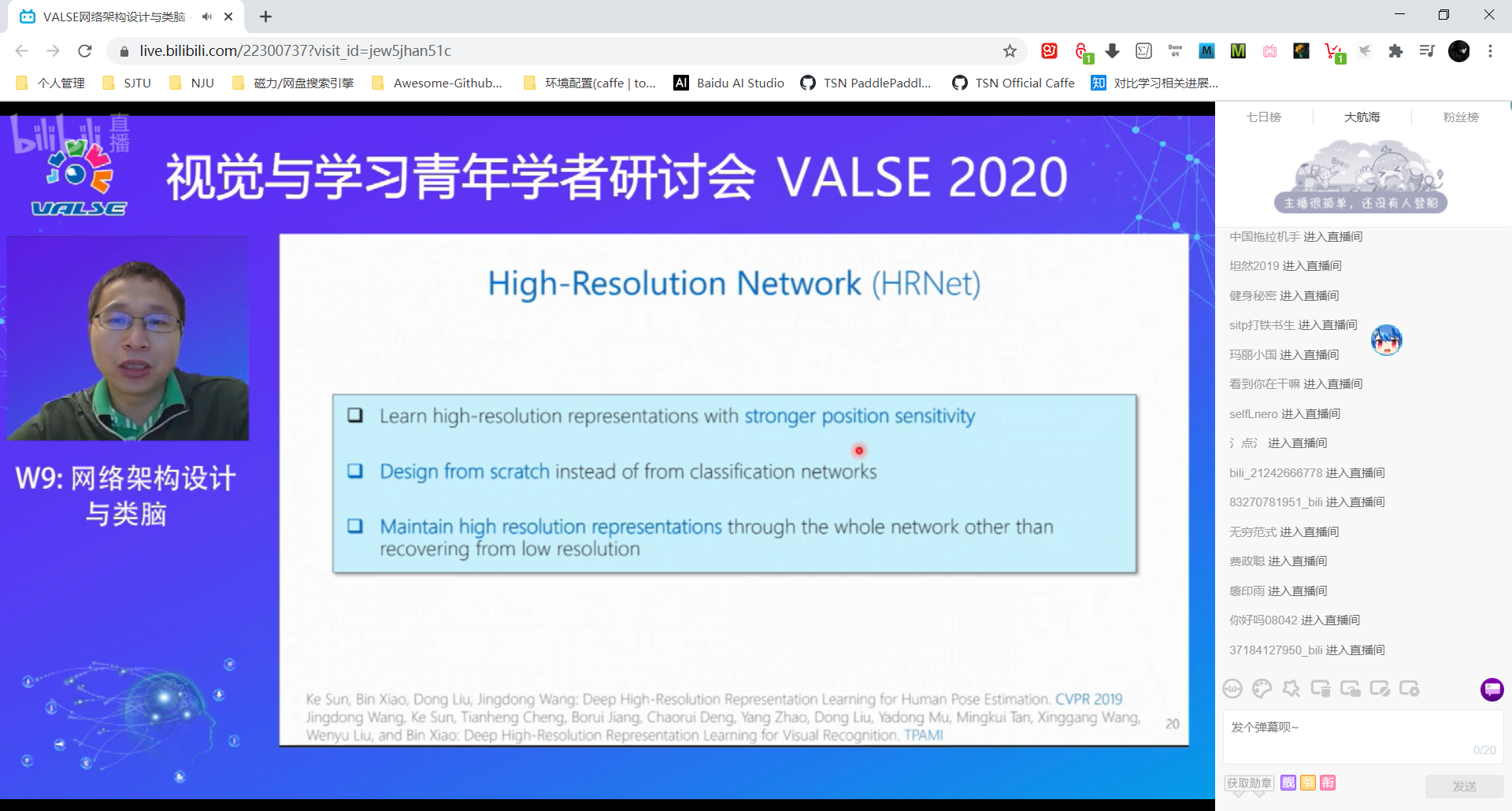

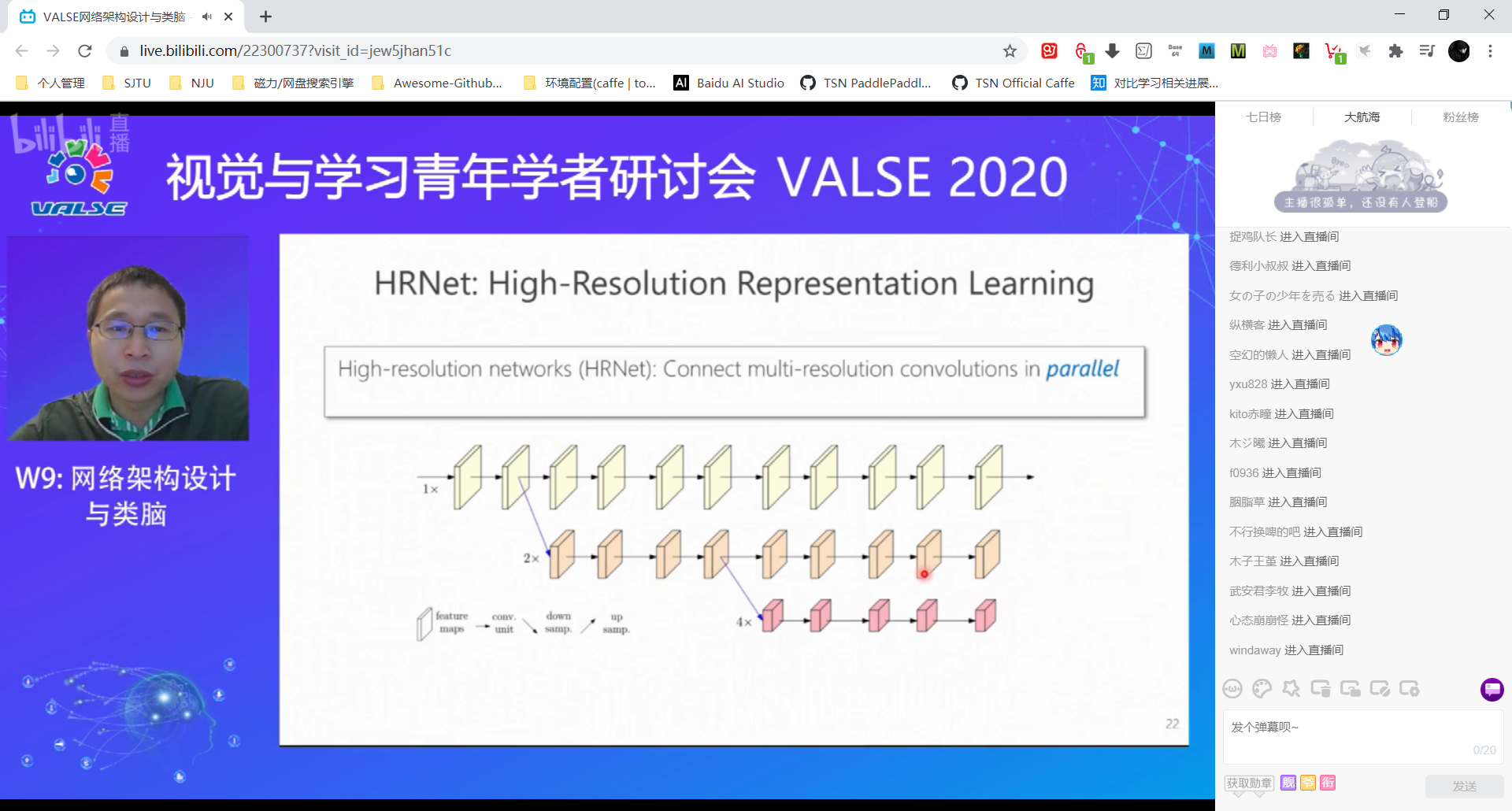

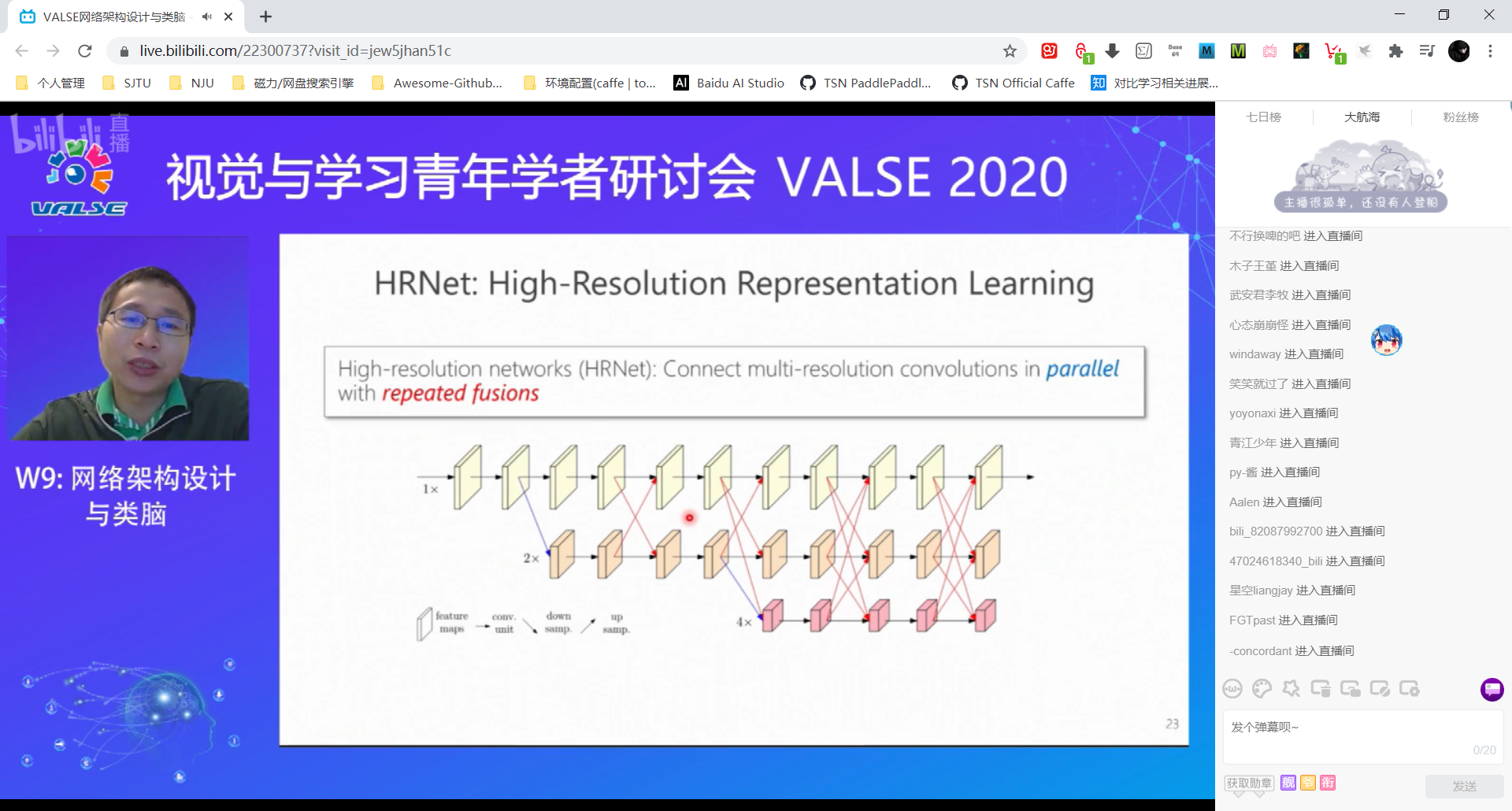

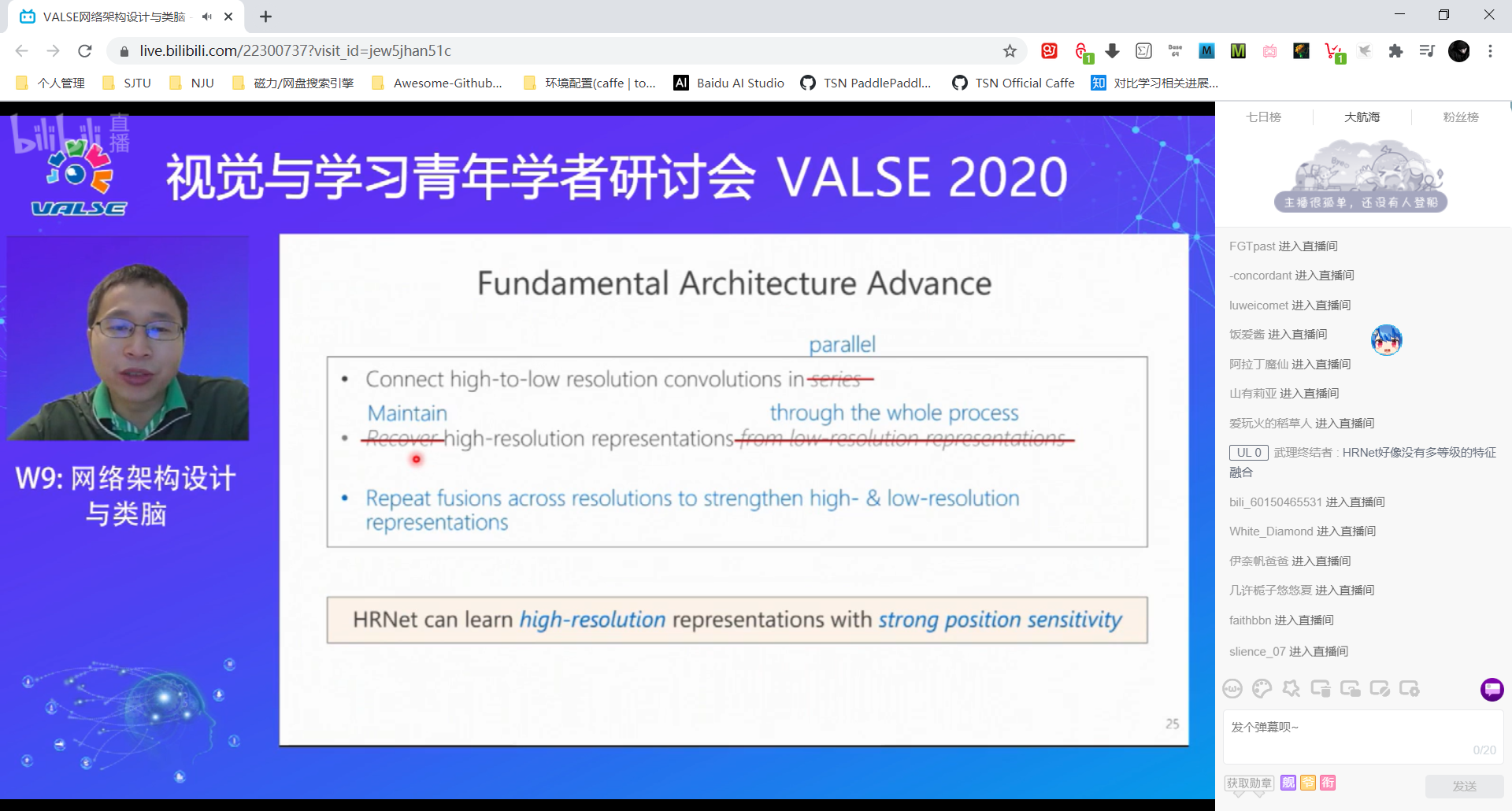

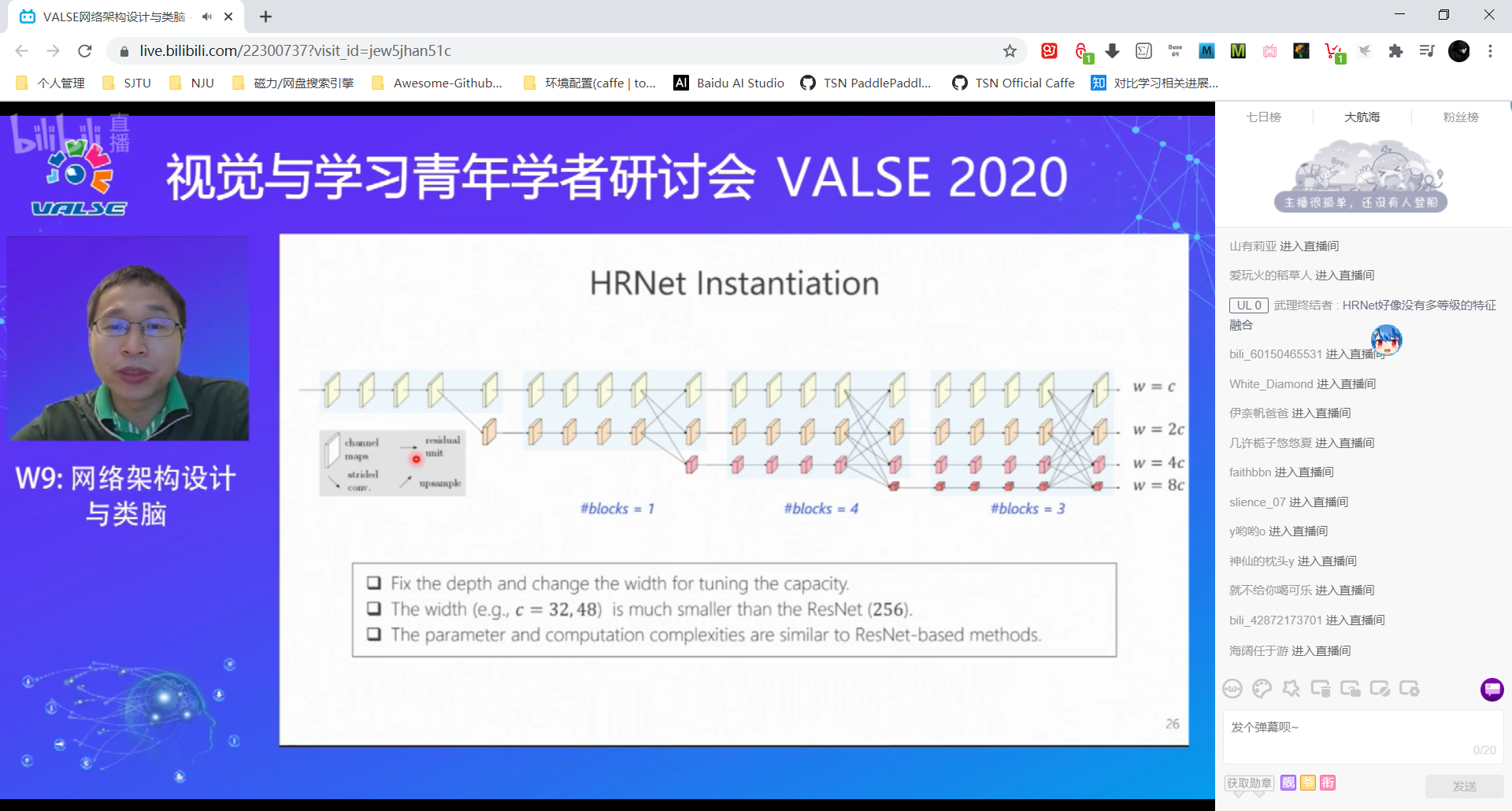

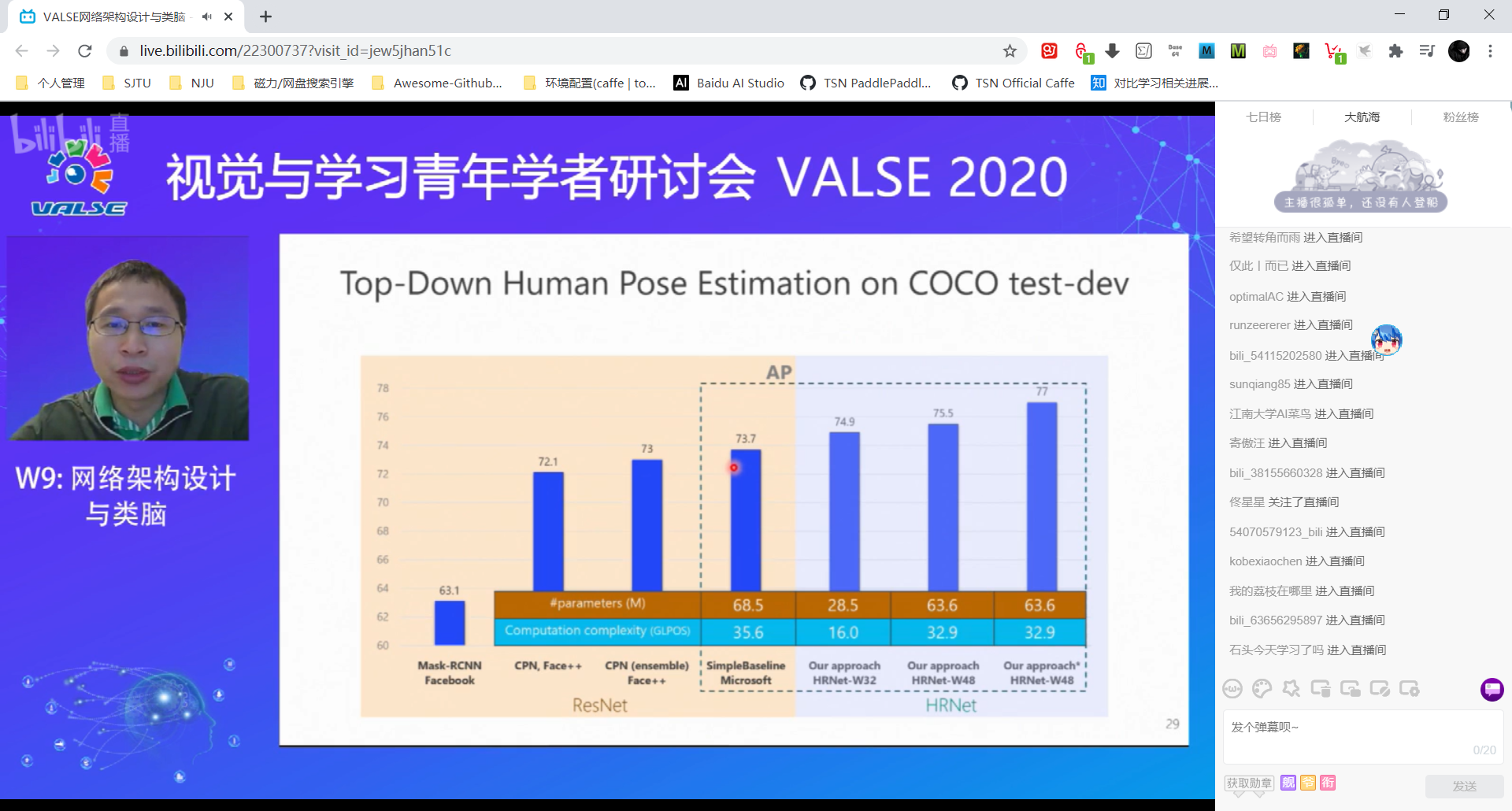

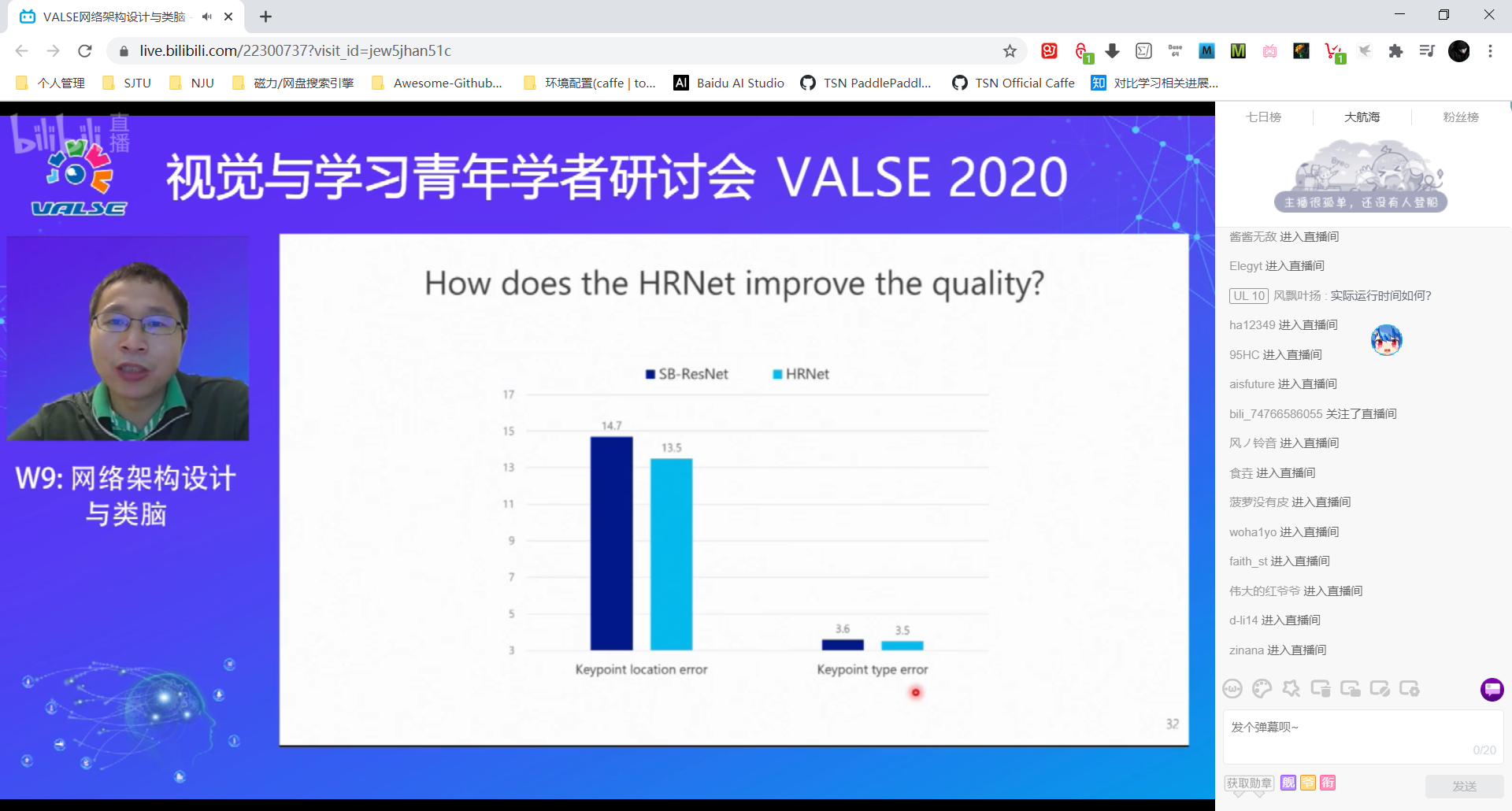

1.1 HRNet

高分辨率 semantic 不强,于是用到了 repeated fusion

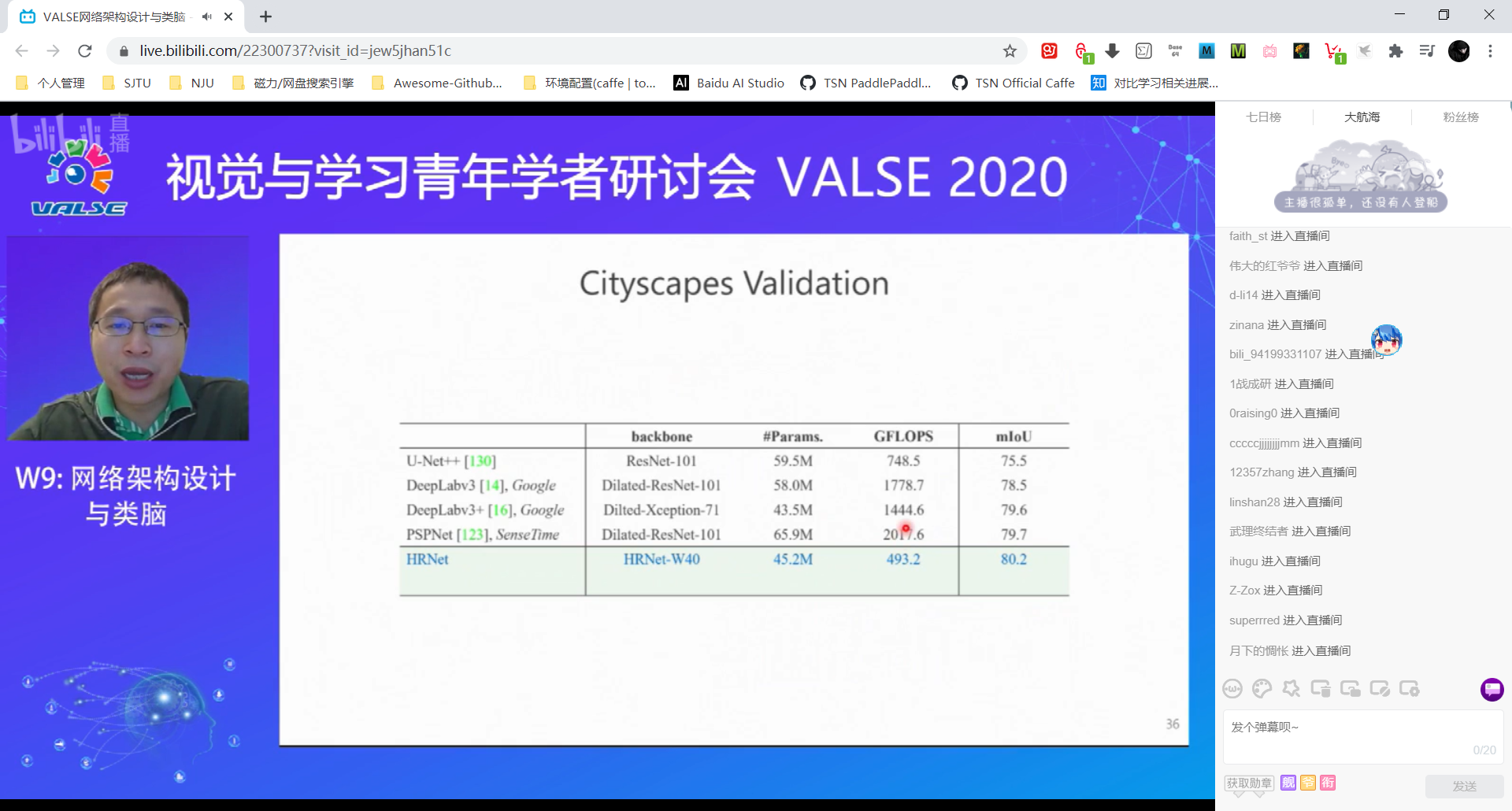

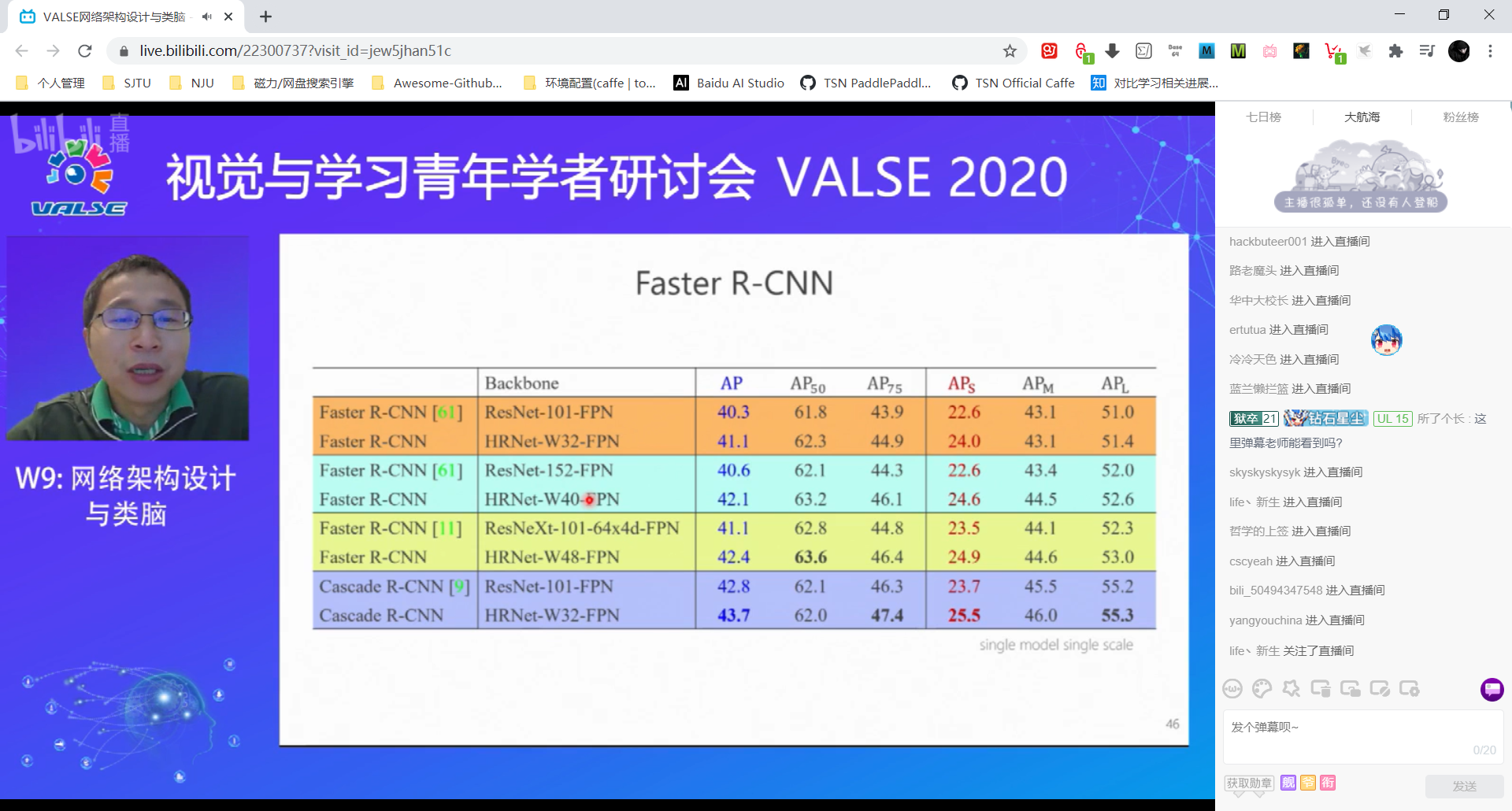

在目标检测任务中,基于HRNet的Faster RCNN在小物体检测有涨点。

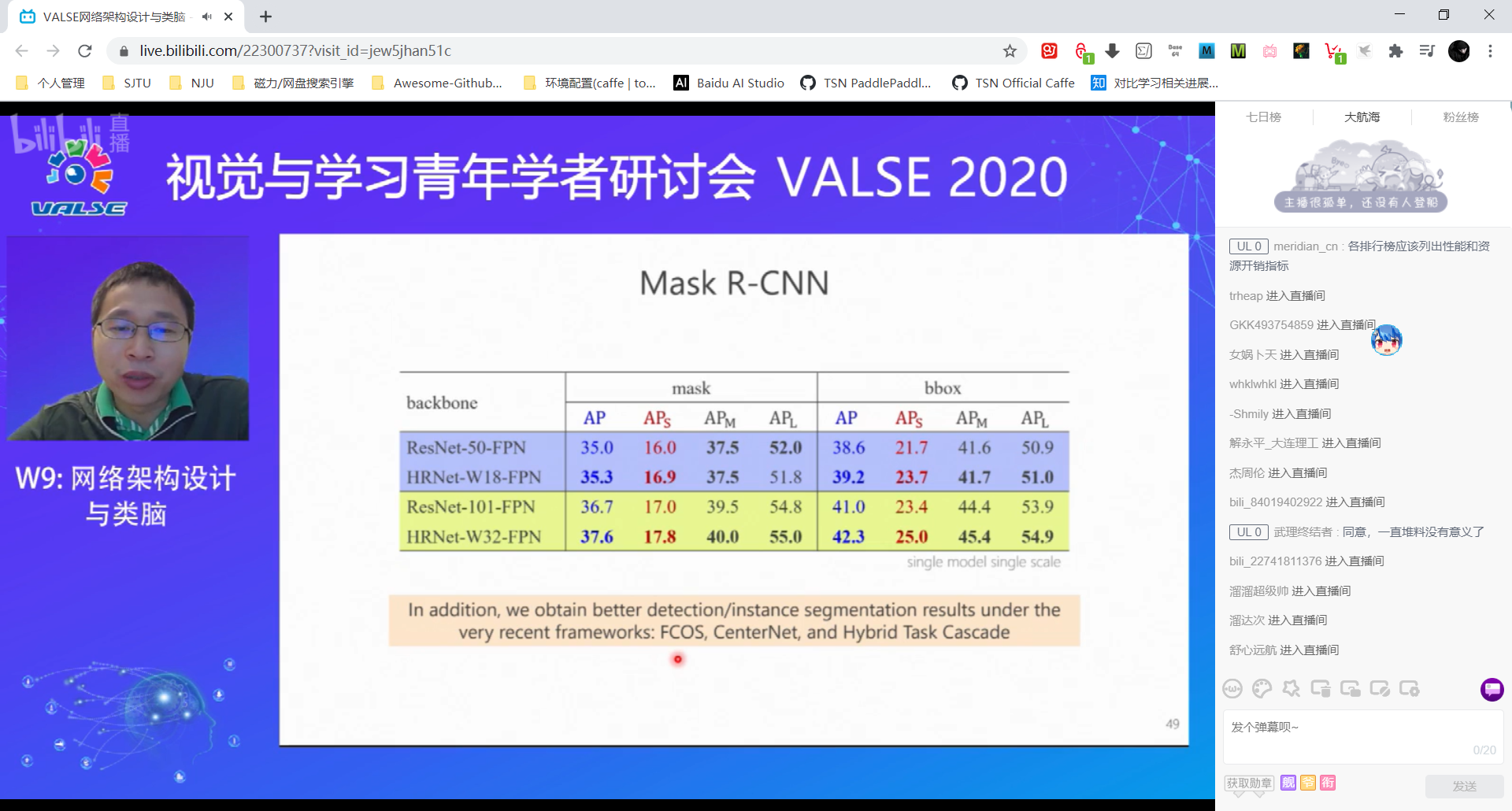

在实例分割任务中,基于HRNet的Mask RCNN在小/中/大物体检测有涨点。

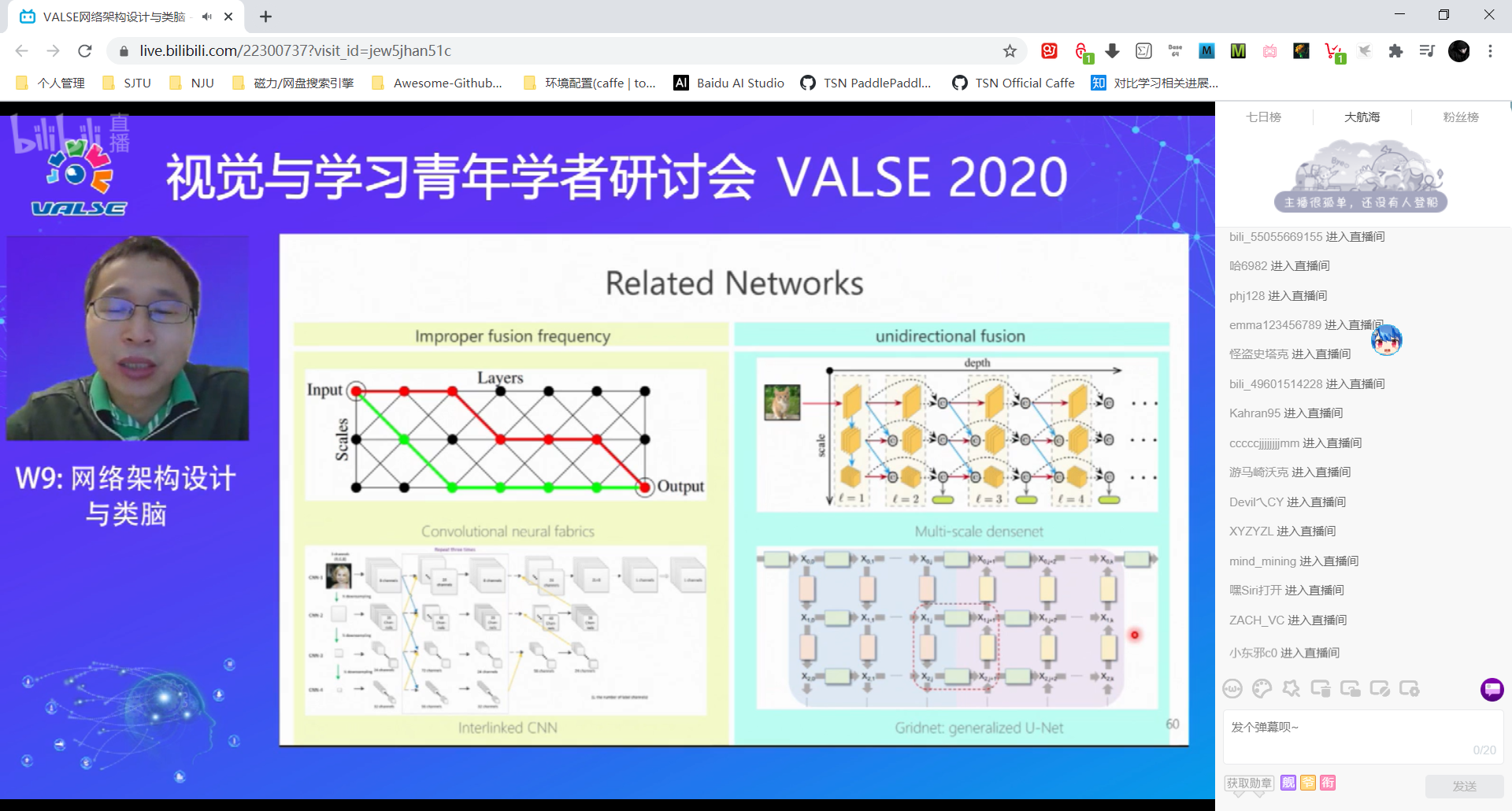

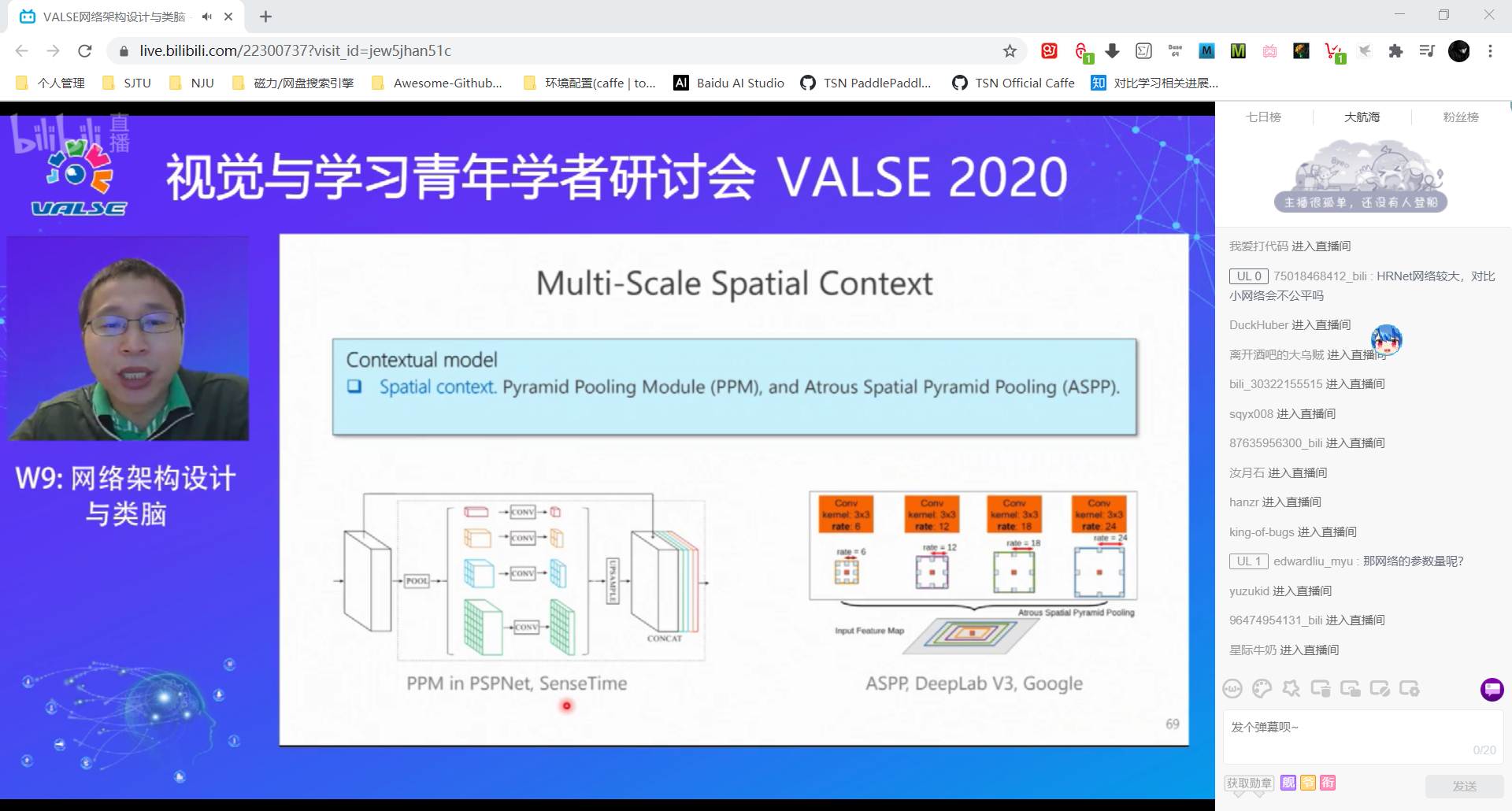

Related Works

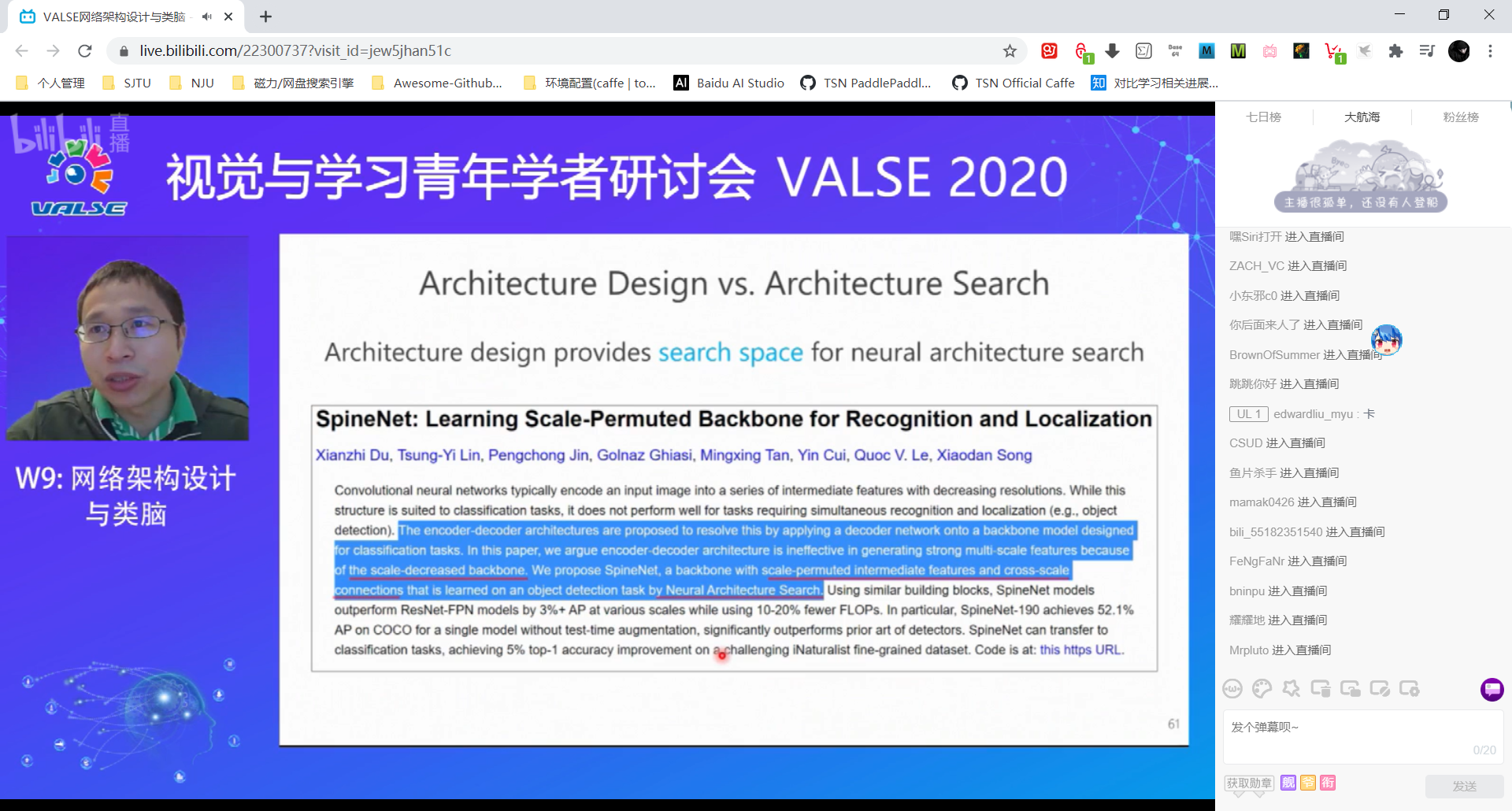

关于 Architecture Design

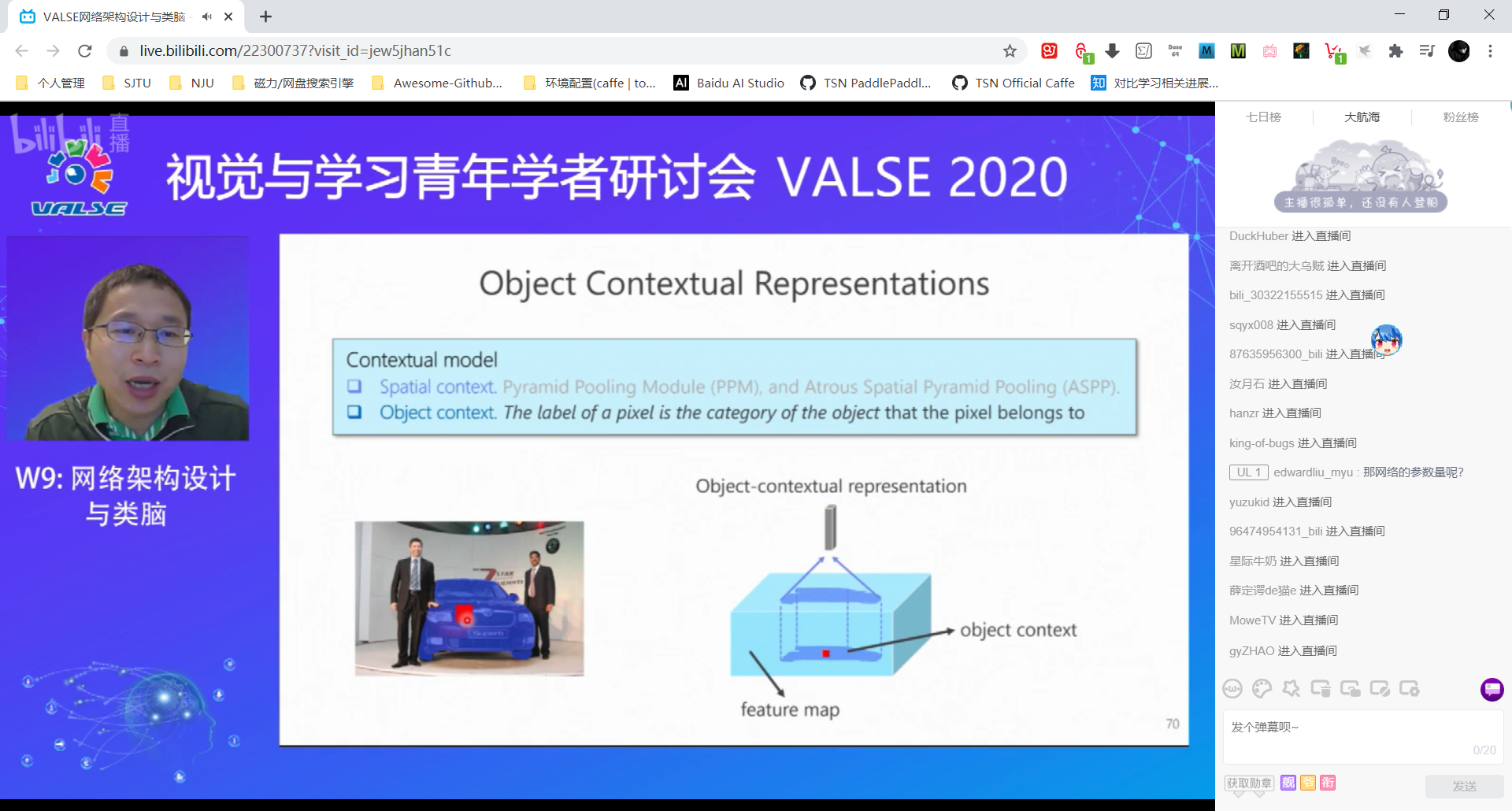

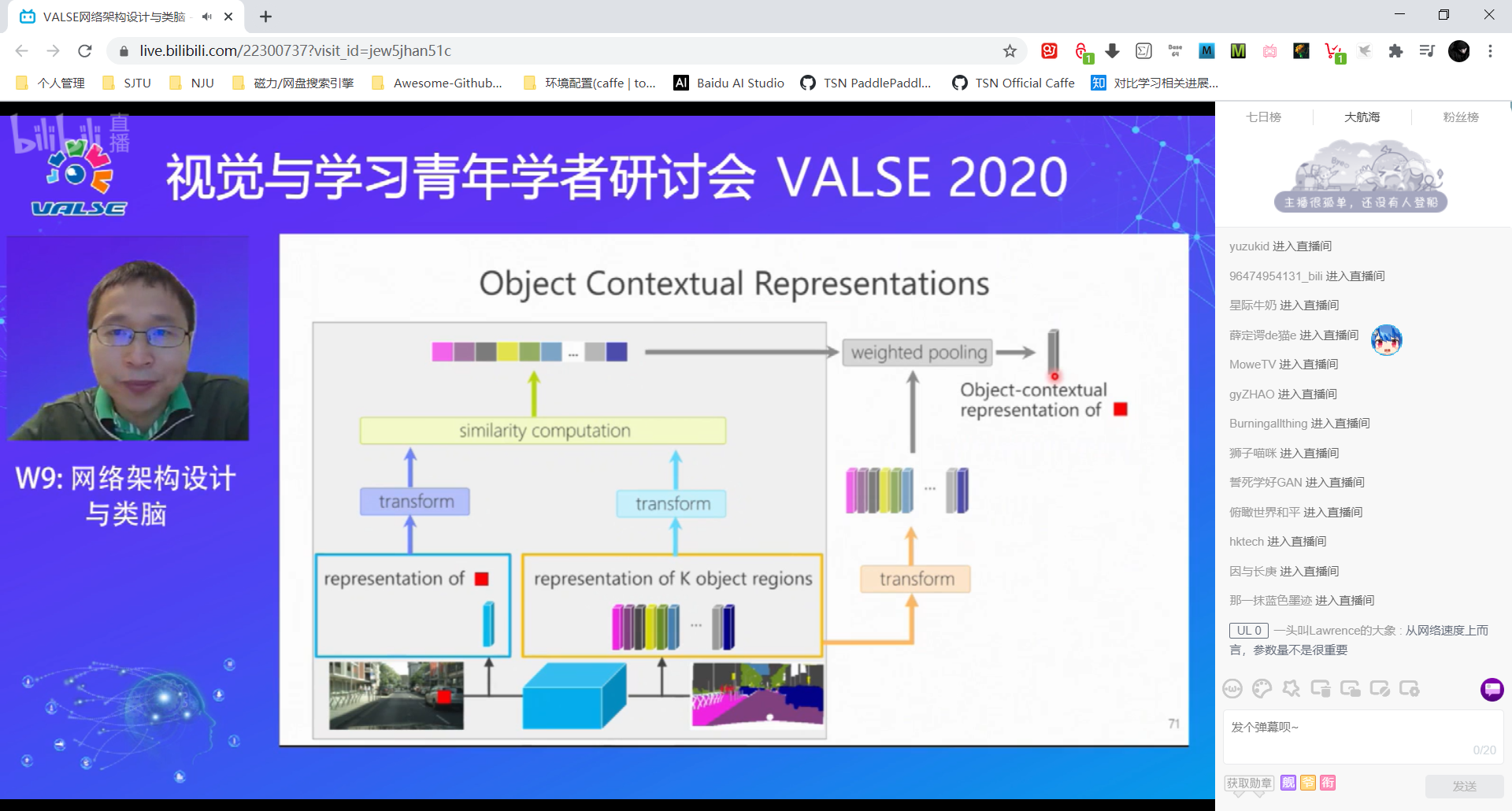

1.2 OCRNet

像素点的标签 = 物体的标签

1.3 HigherHRNet

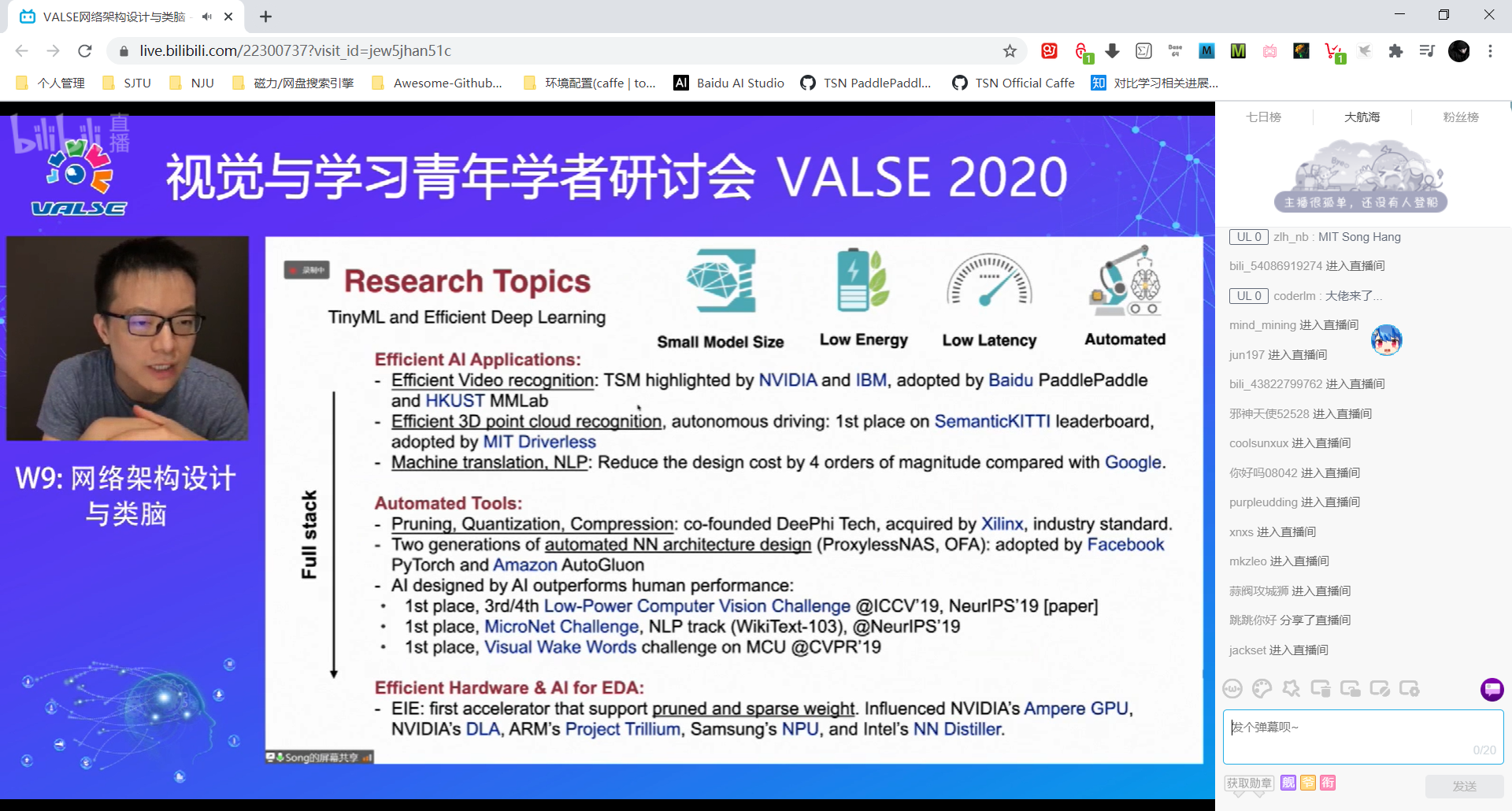

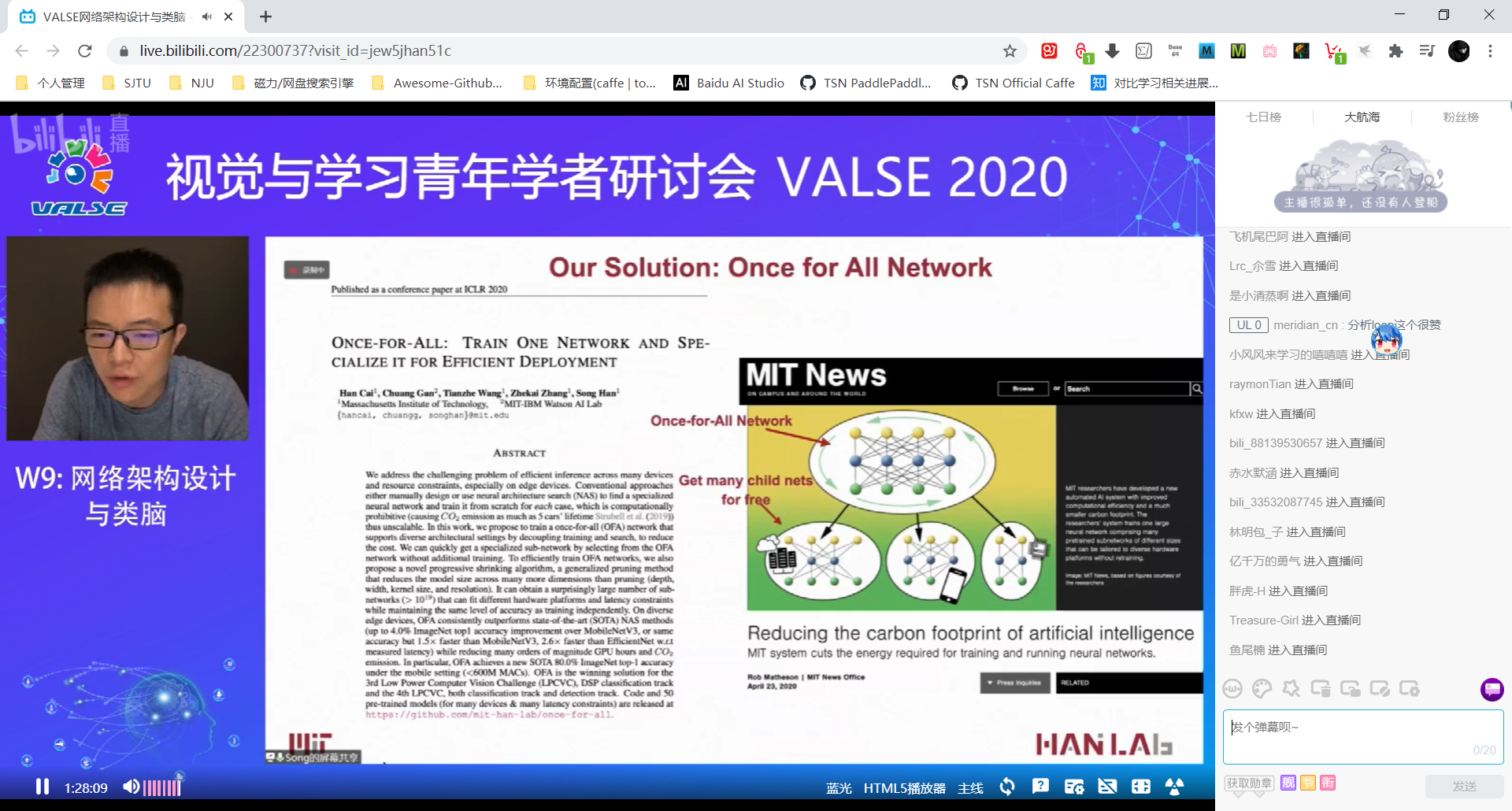

2. AutoML for TinyML with Once-for-All Network

【时间】09:40-10:20

【讲者】韩松(MIT)

【题目】AutoML for TinyML with Once-for-All Network

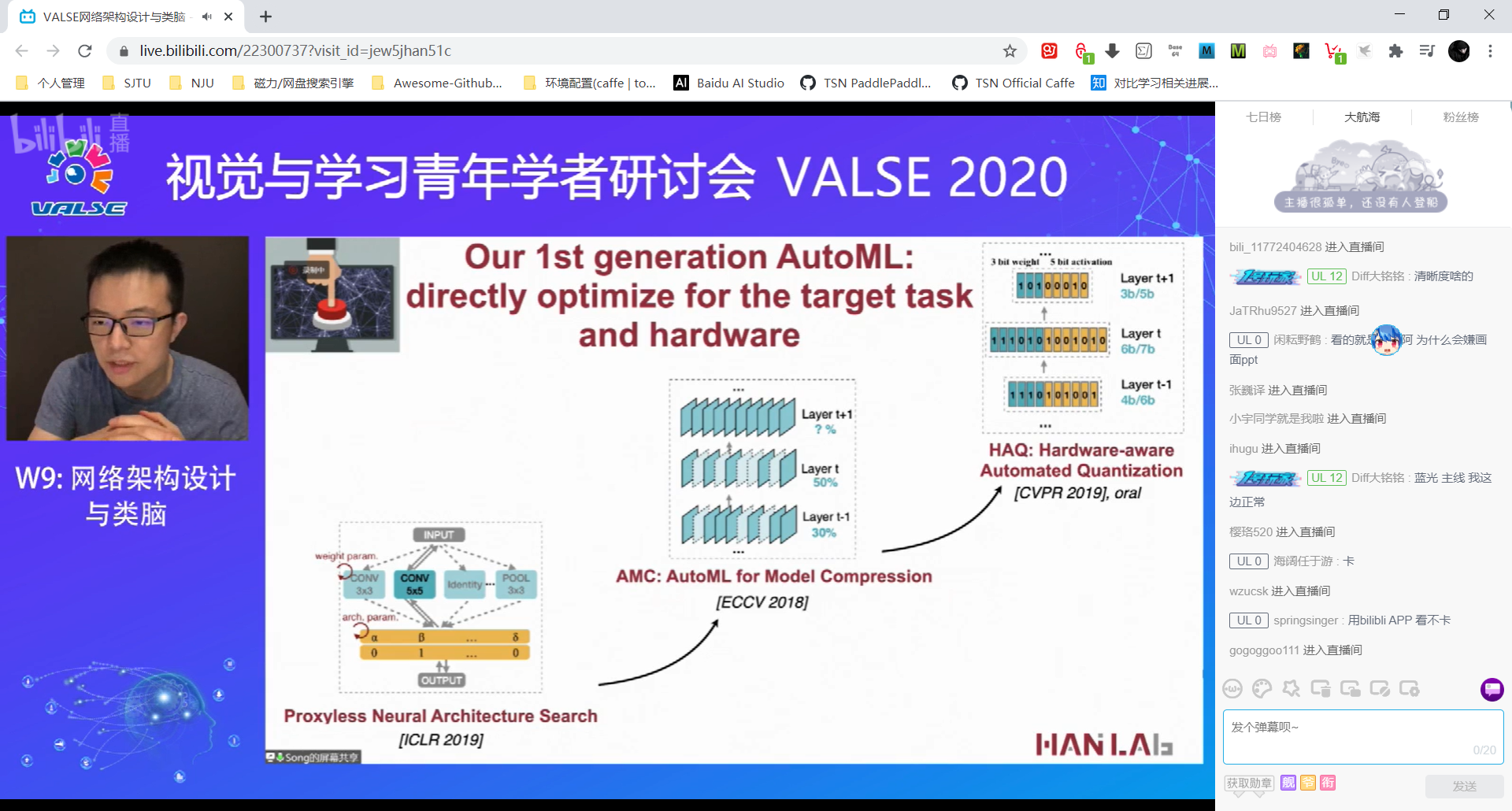

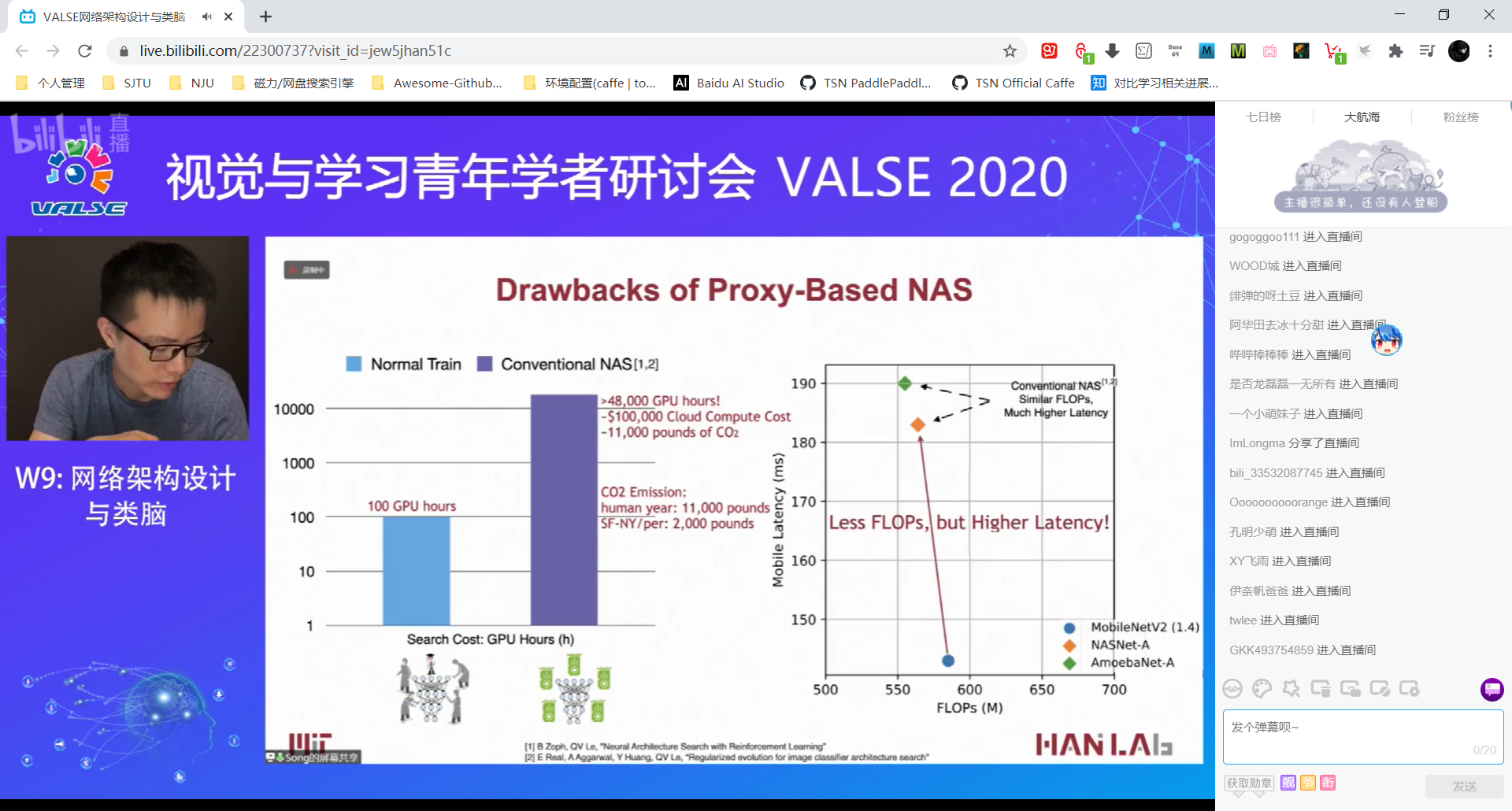

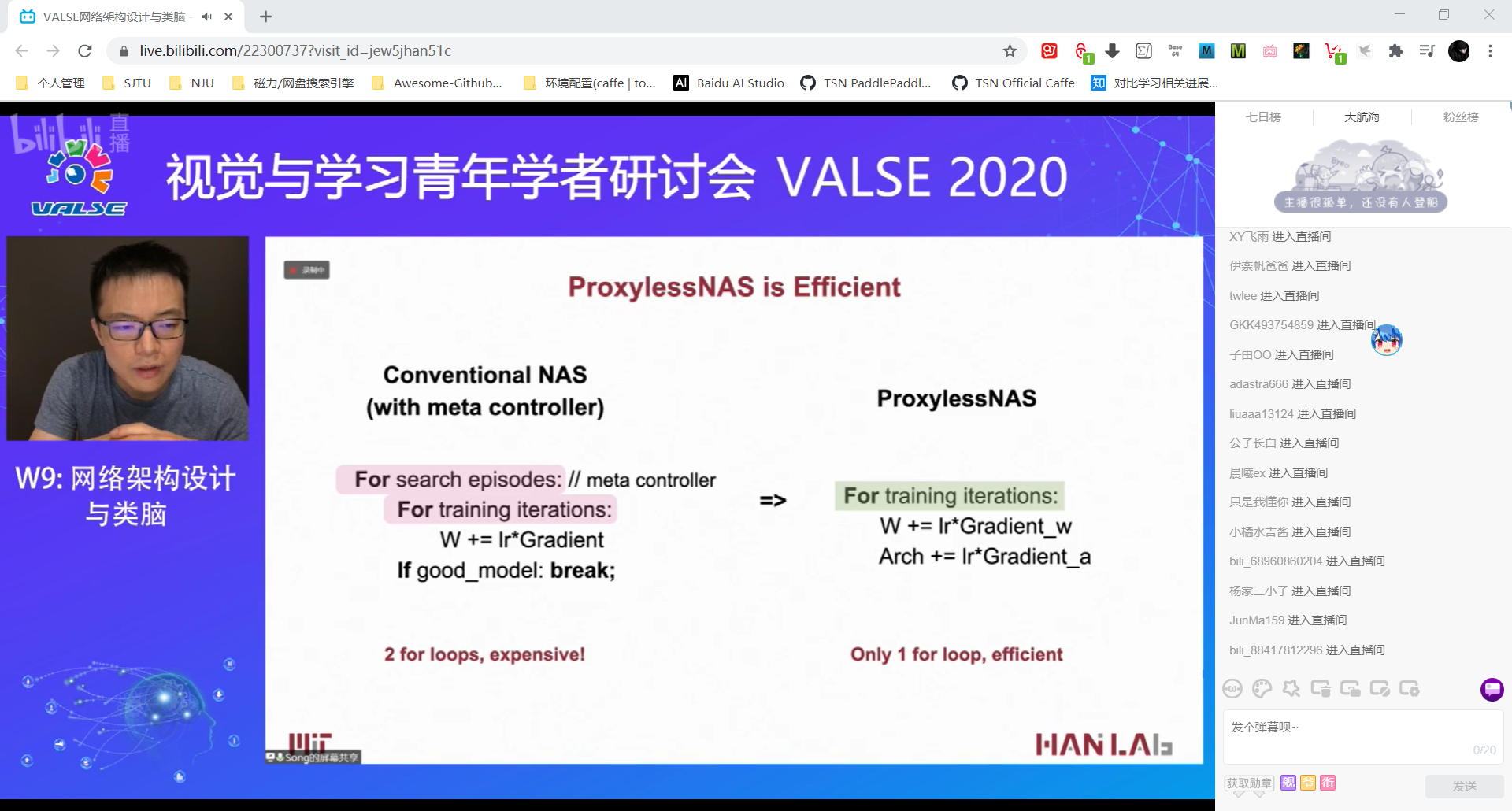

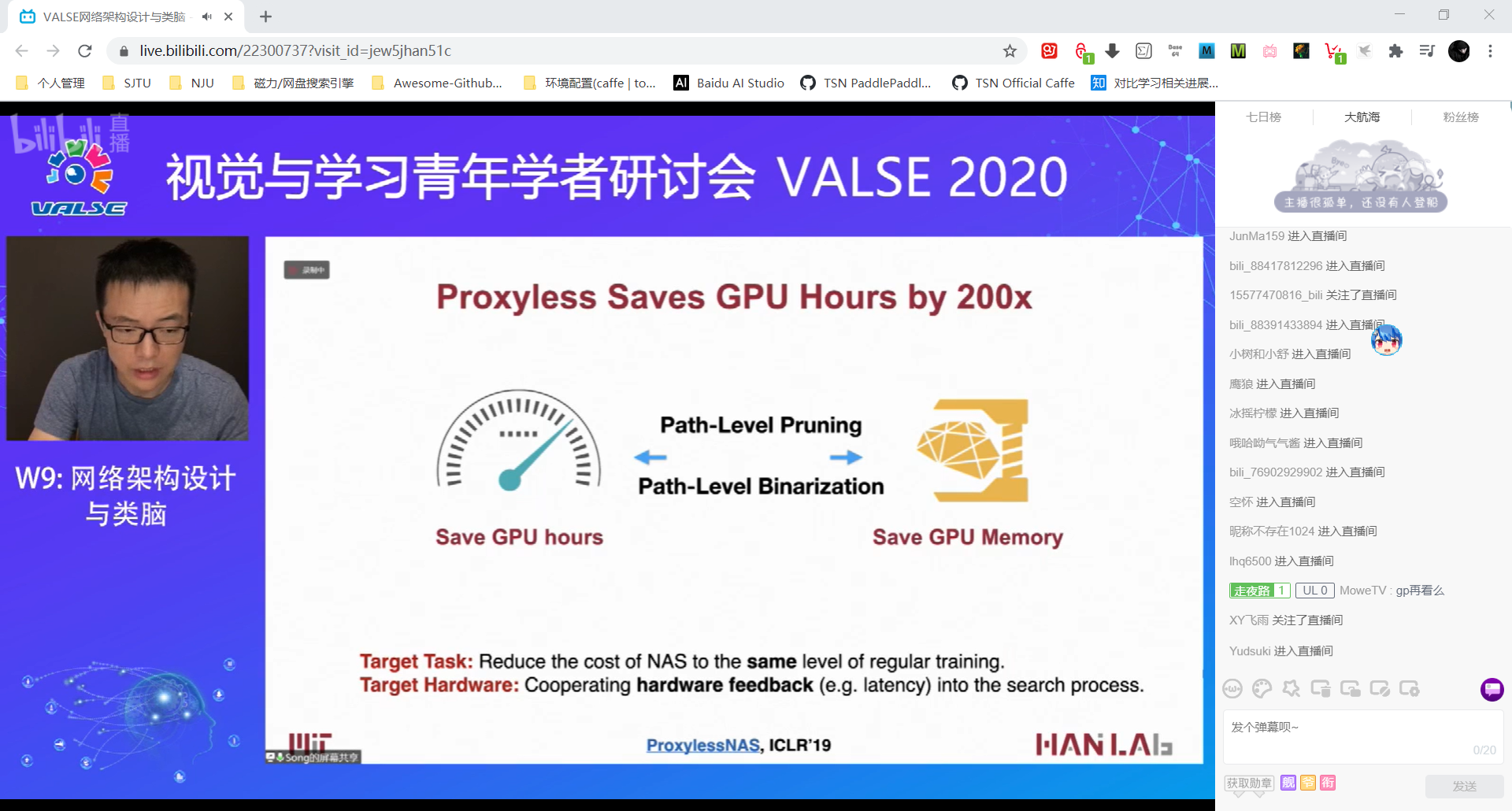

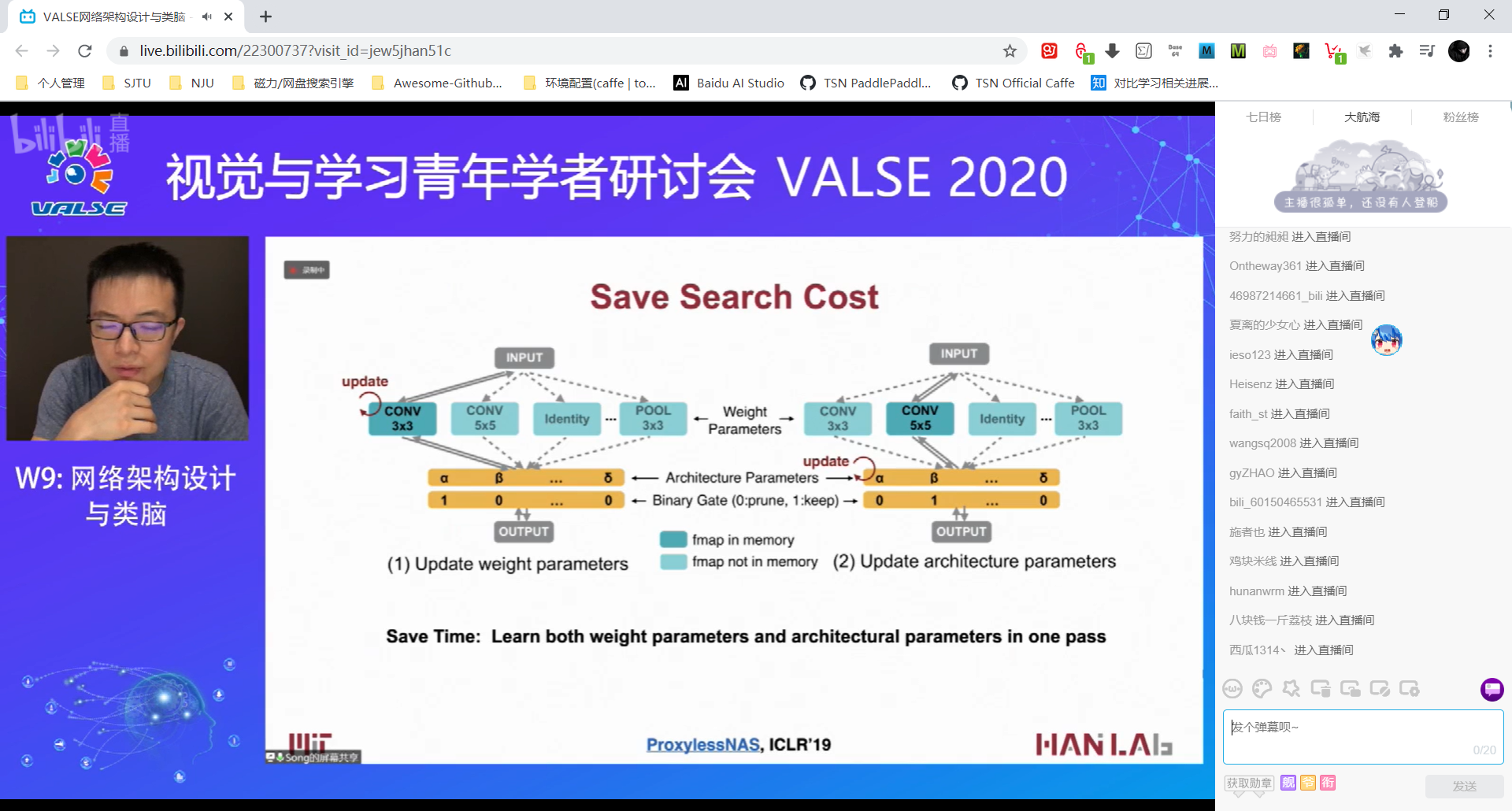

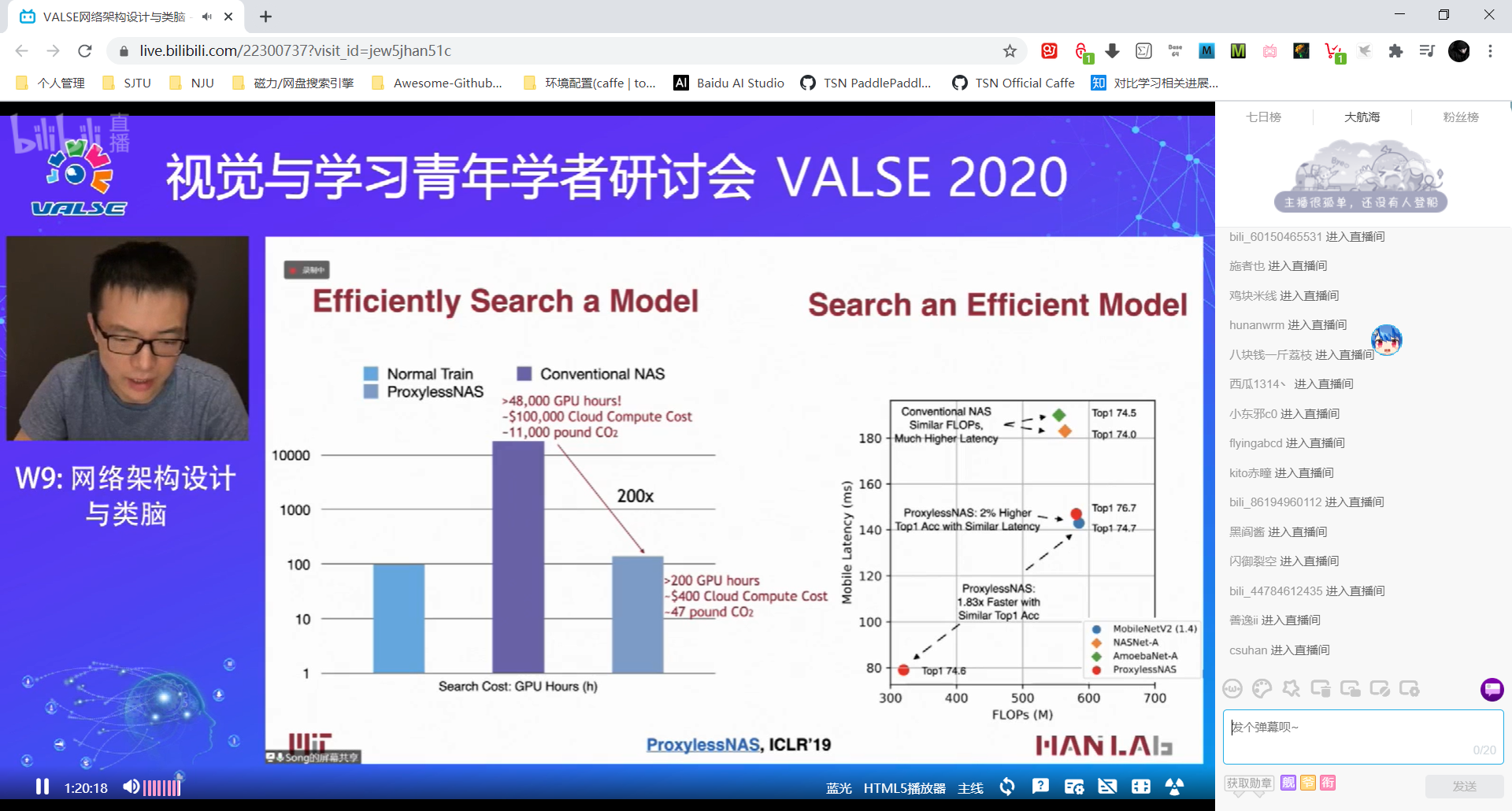

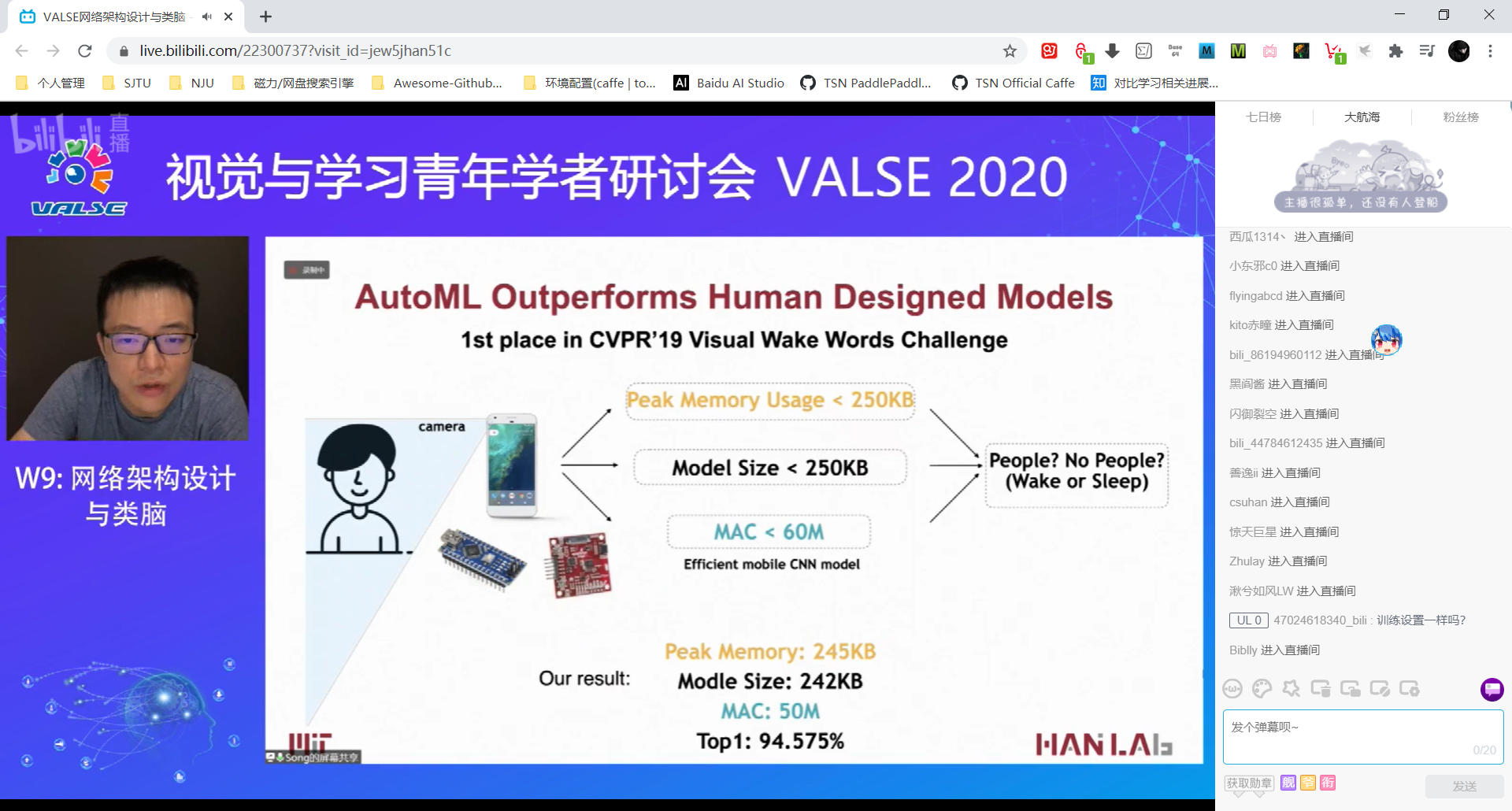

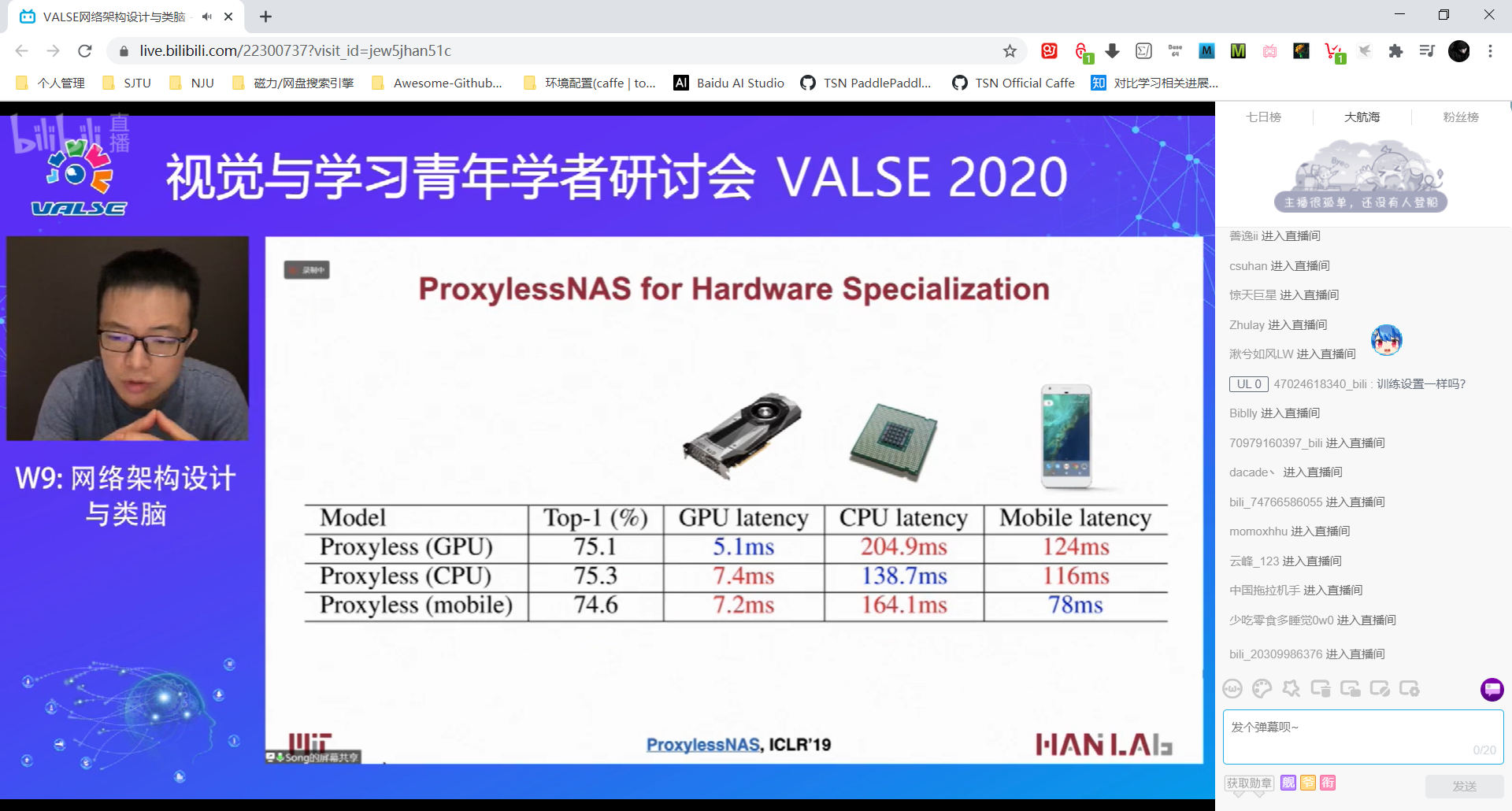

2.1 ProxylessNAS

latency 作为 feedback

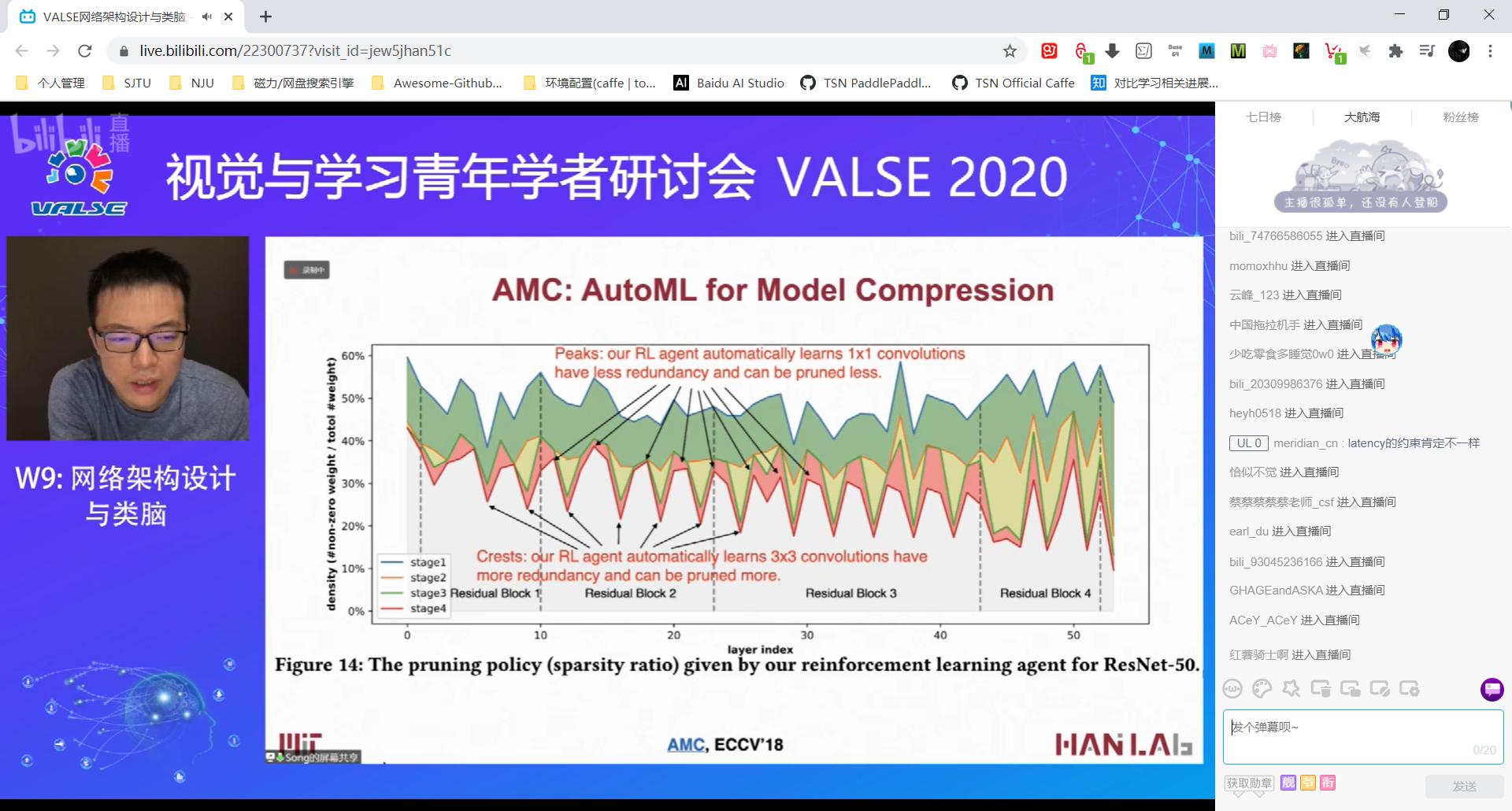

2.2 AMC

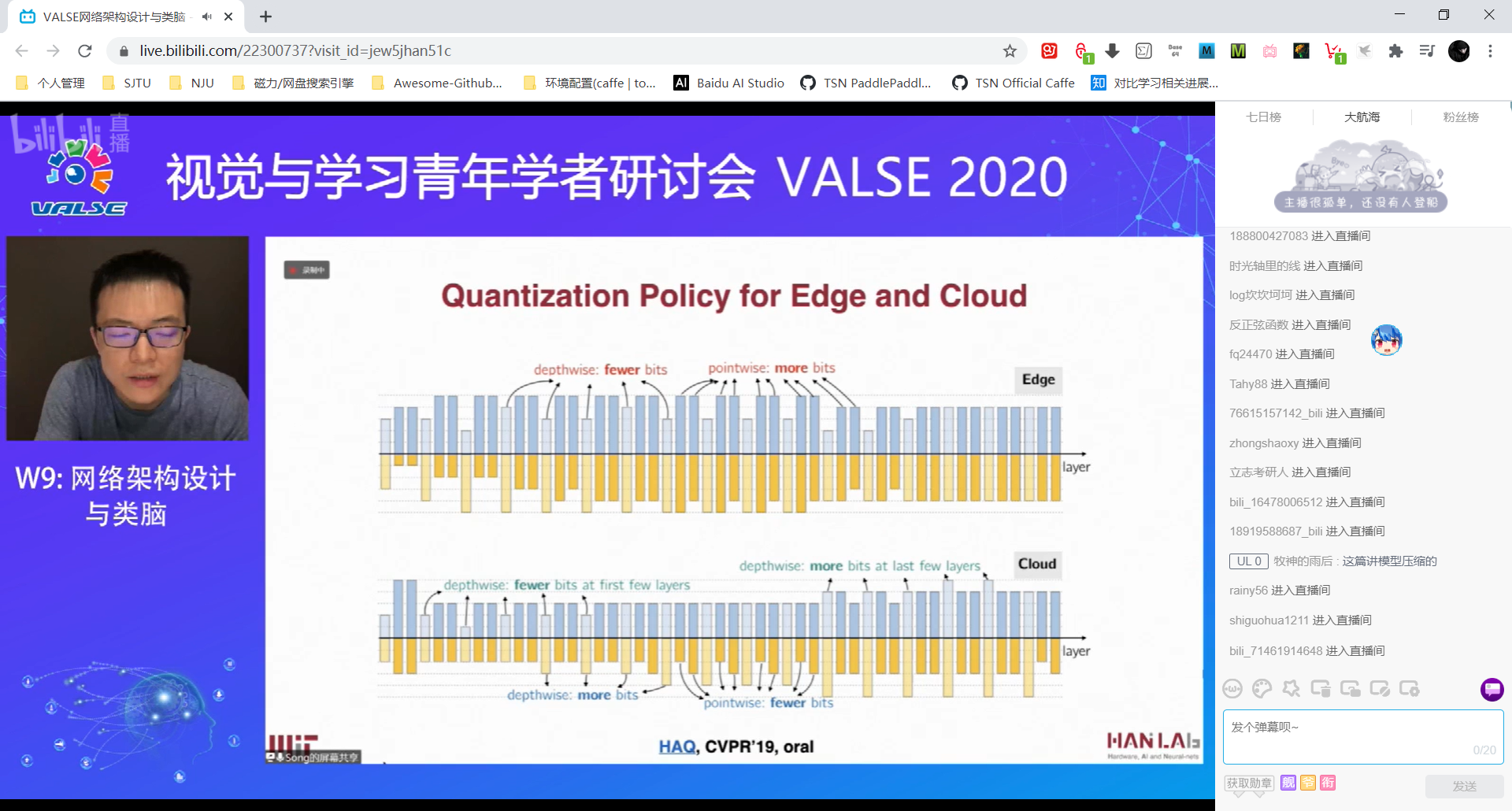

2.3 HAC (CVPR2019)

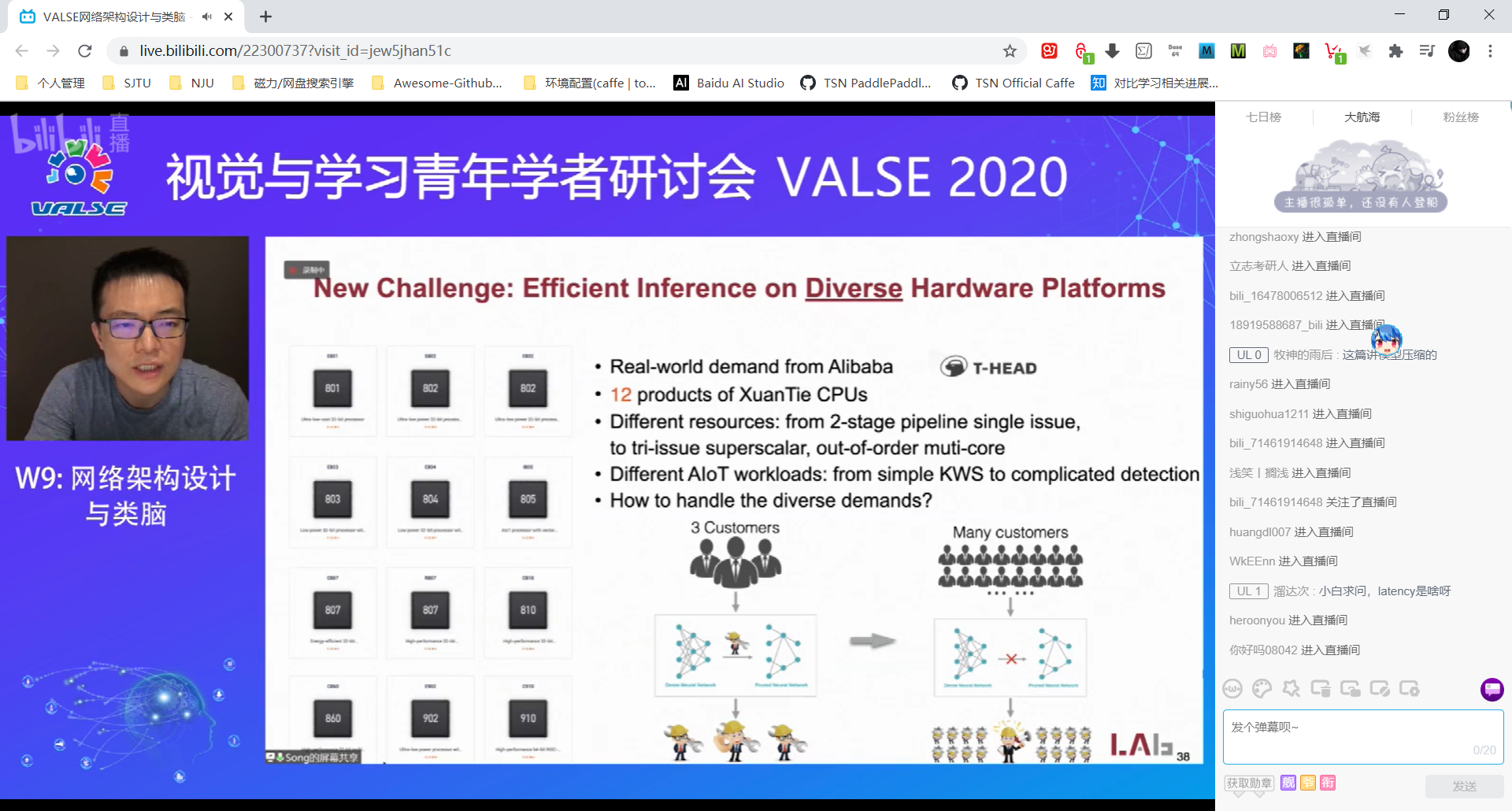

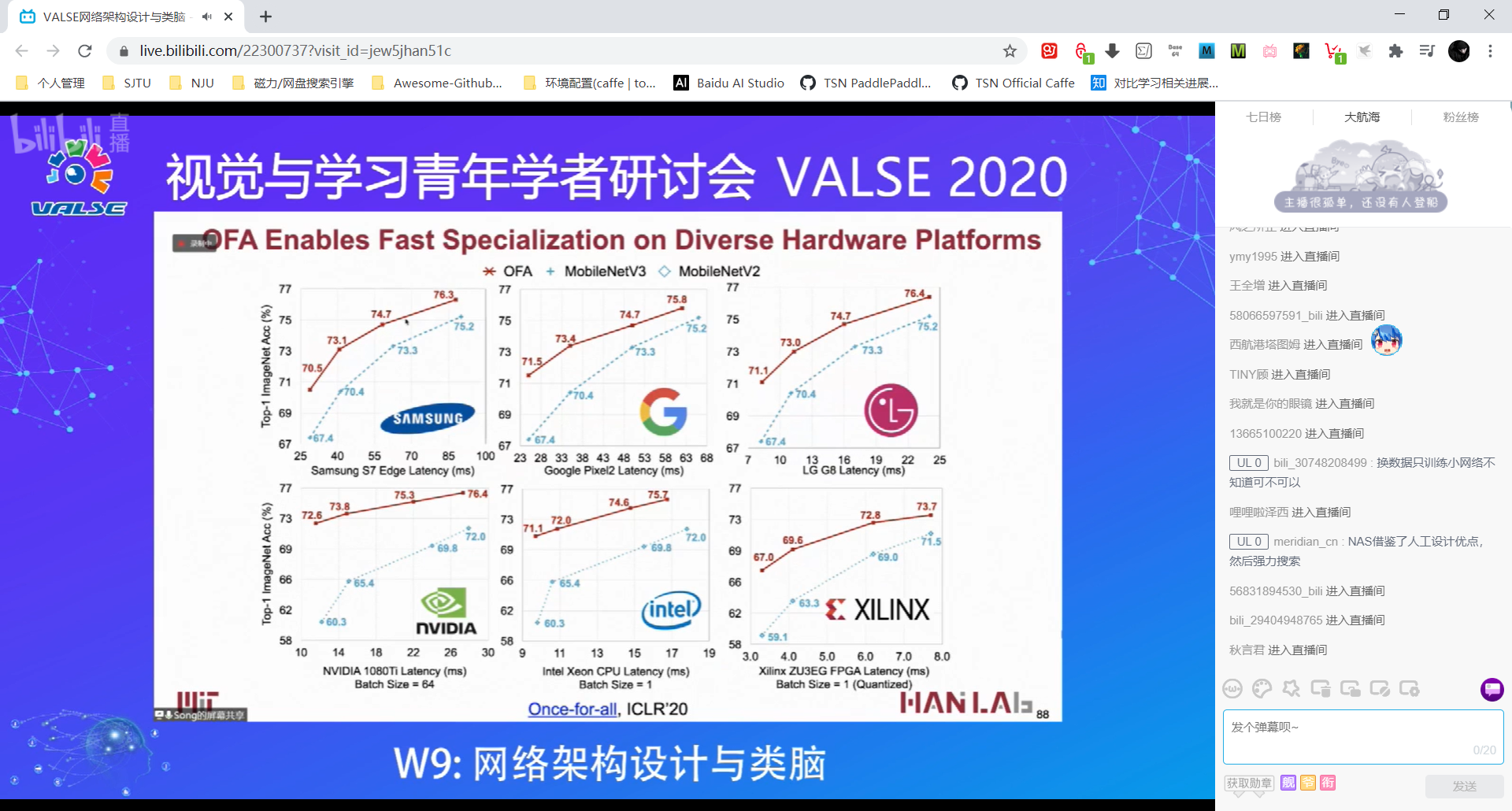

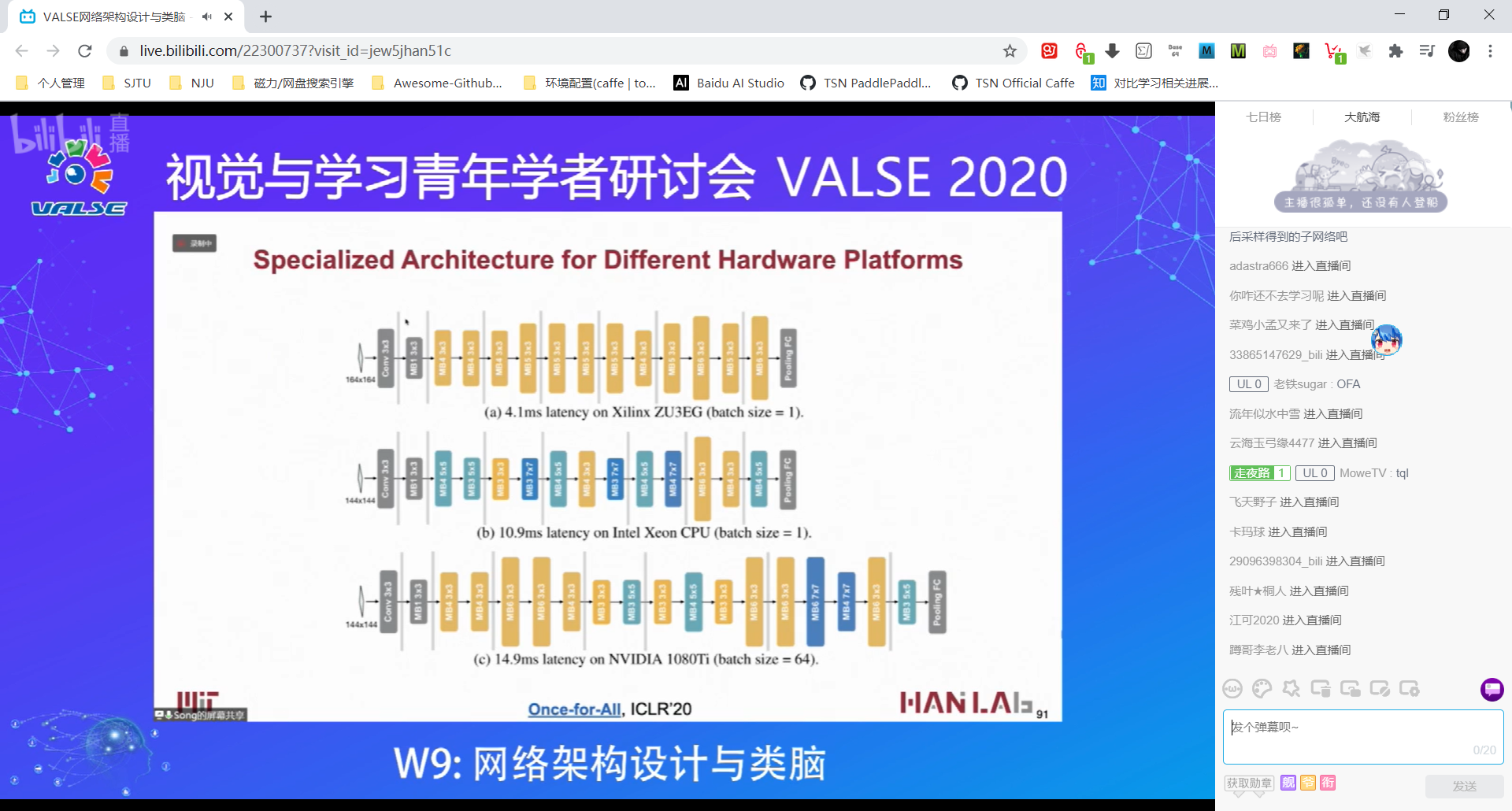

2.4 现实挑战:为不同硬件平台定制高效推理模型

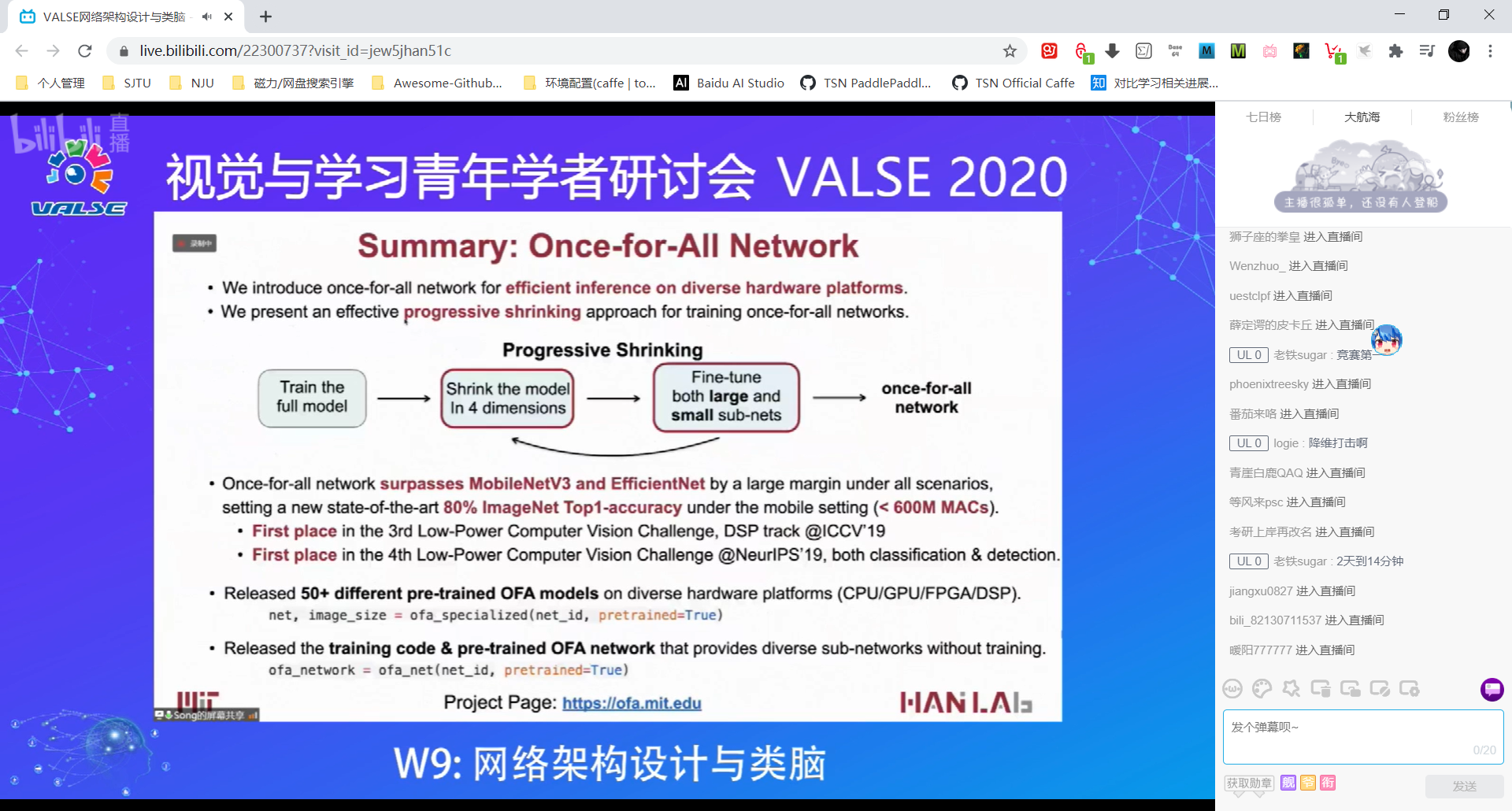

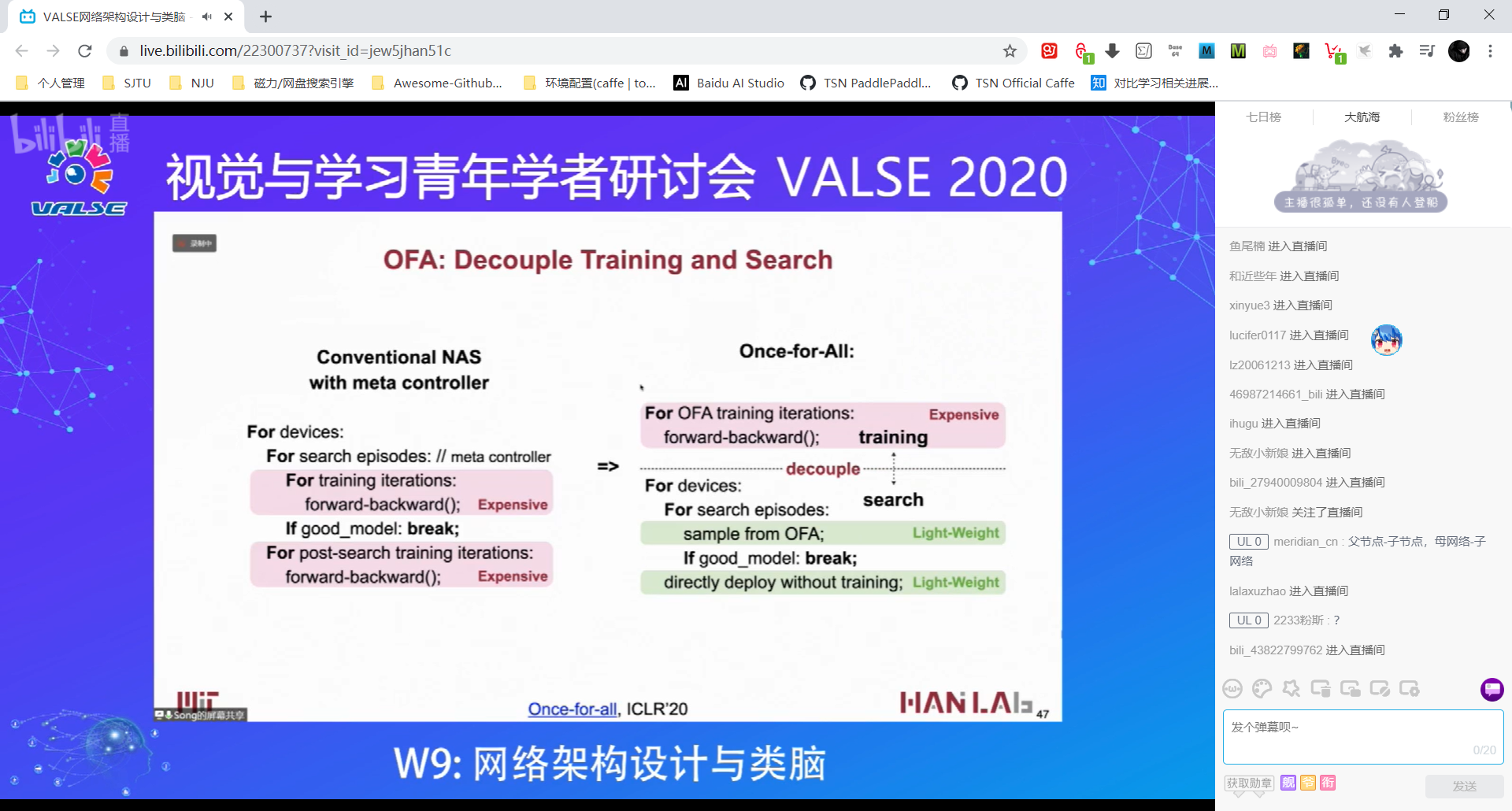

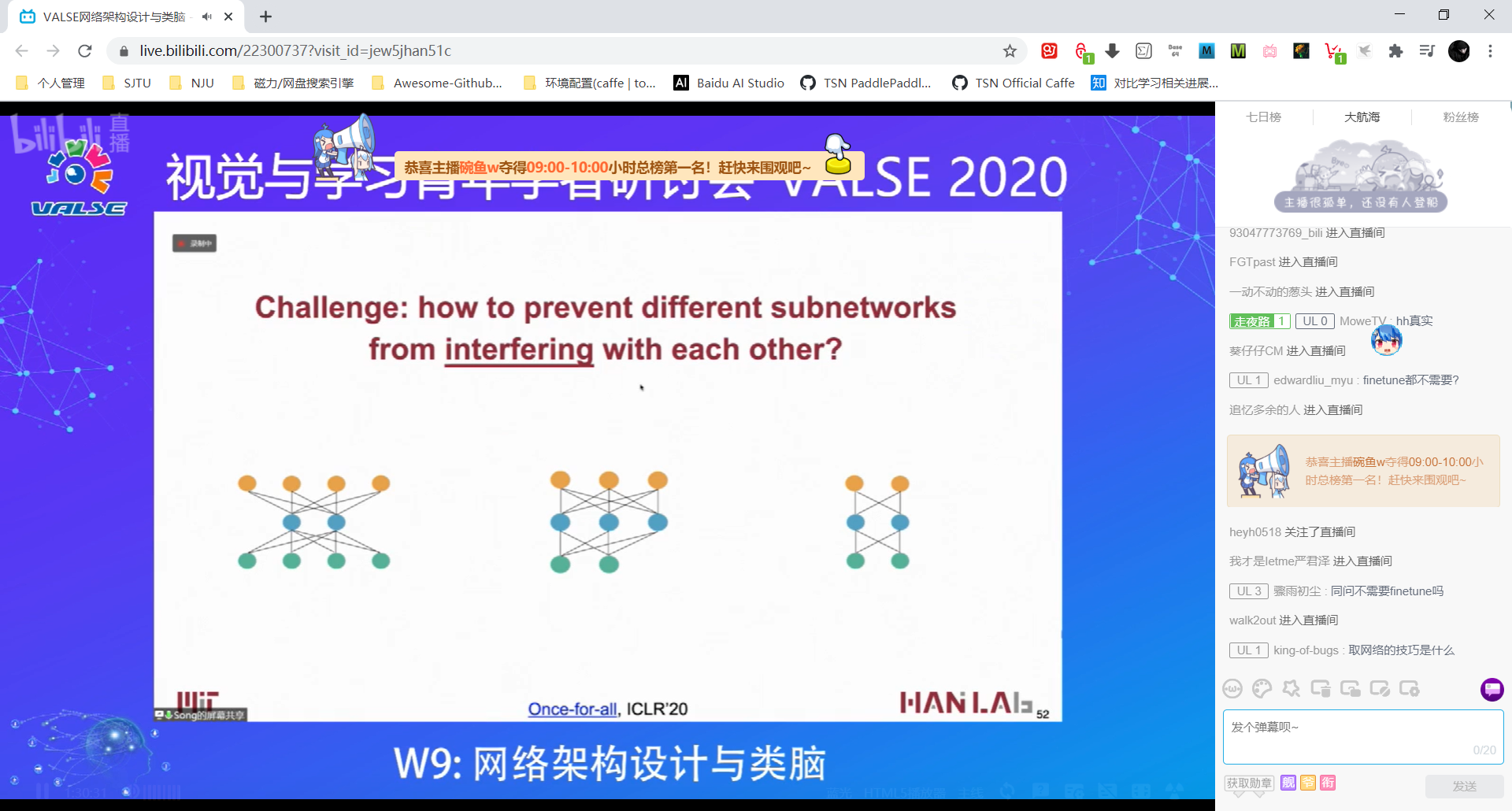

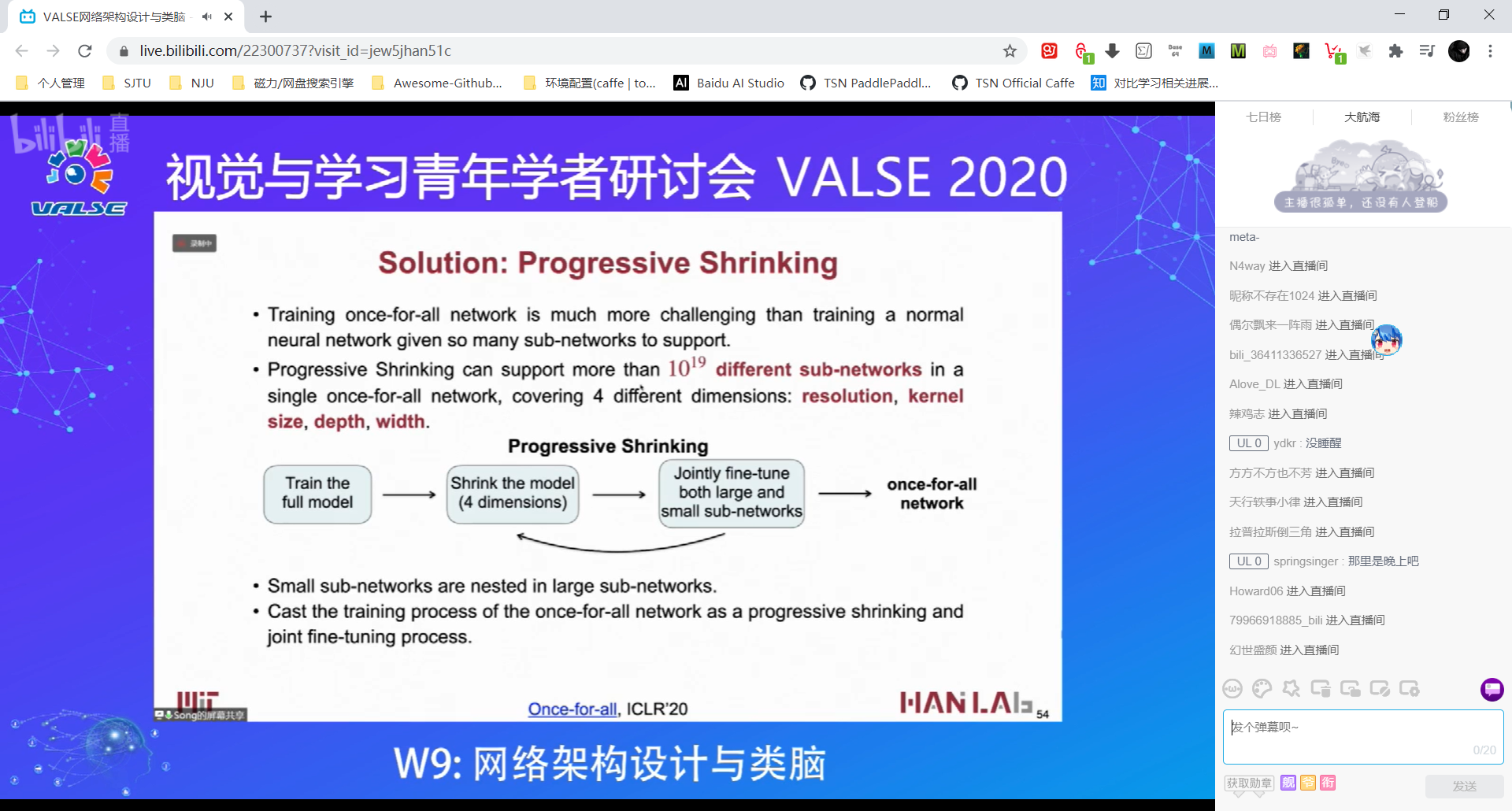

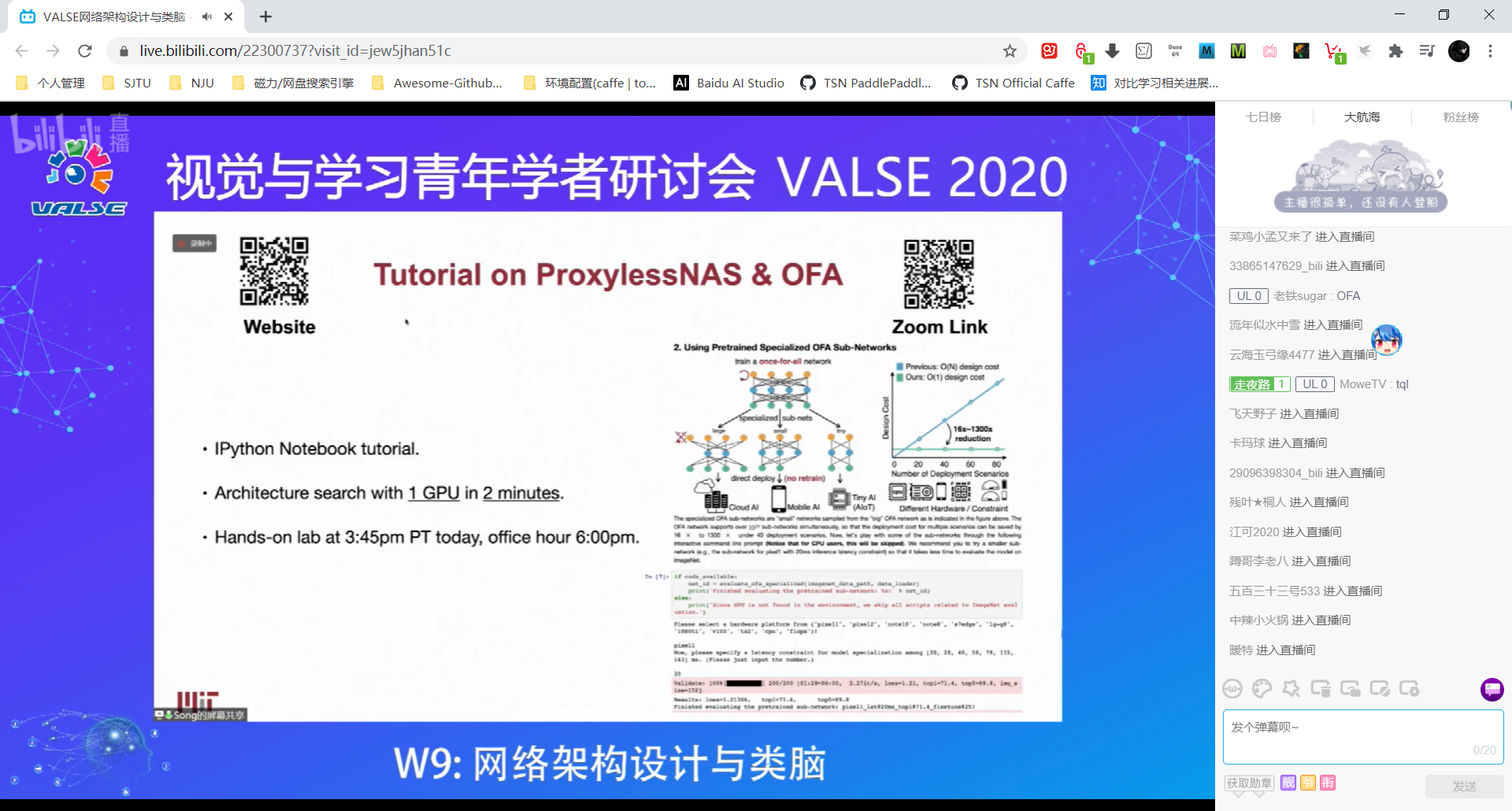

2.5 Once-For-All, Slide 在韩老师个人主页也有

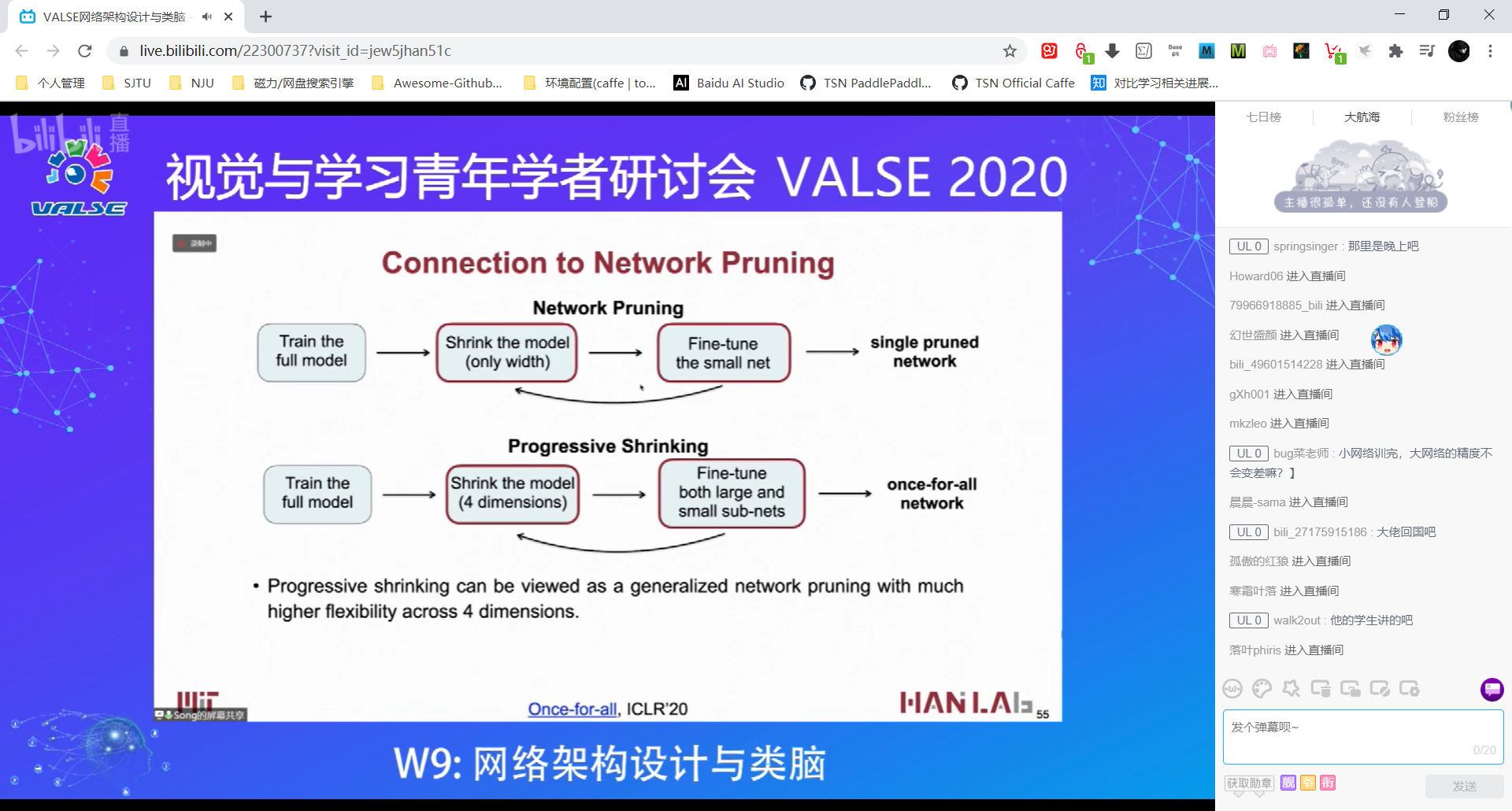

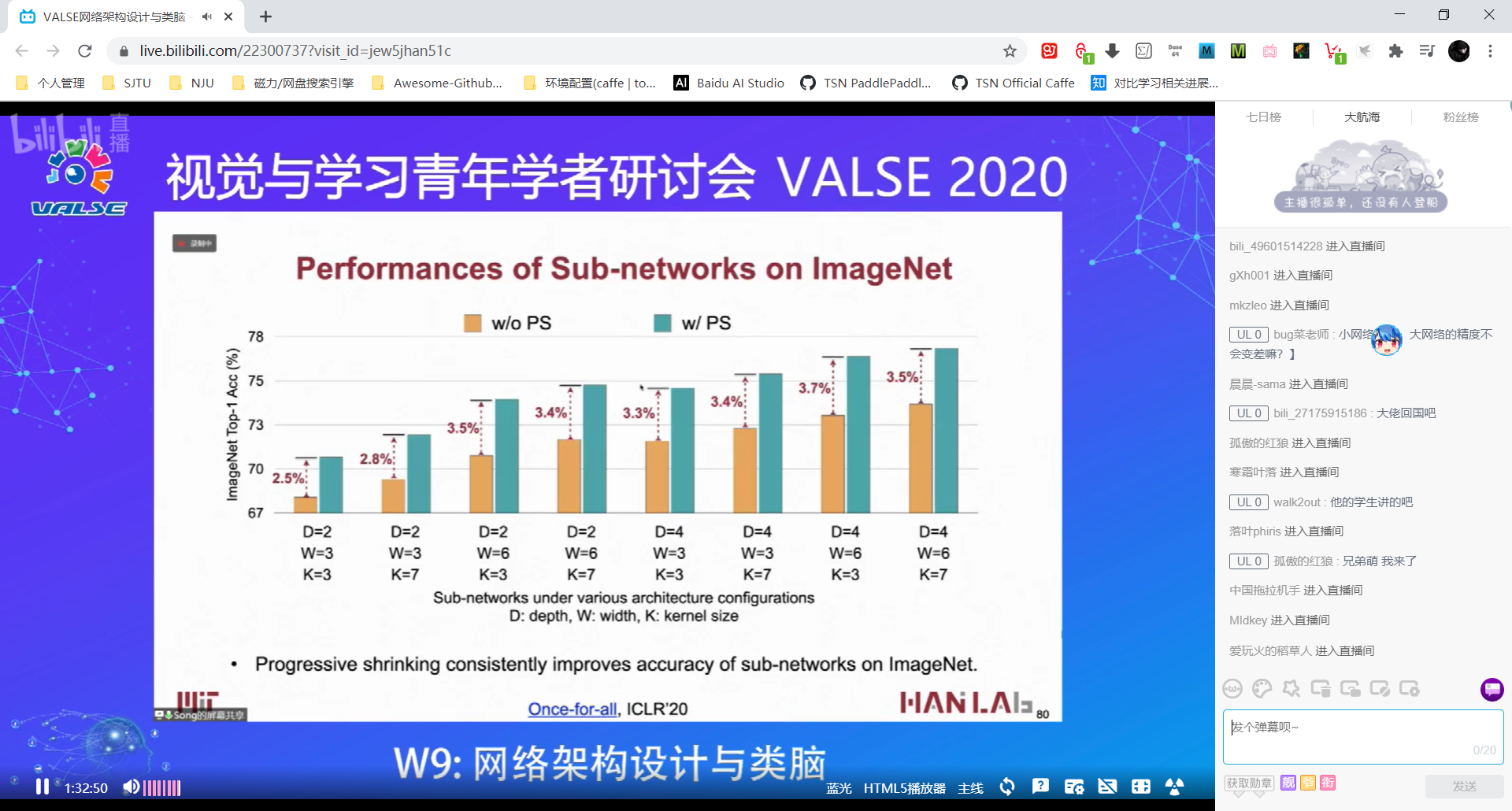

Progressive Shrinking

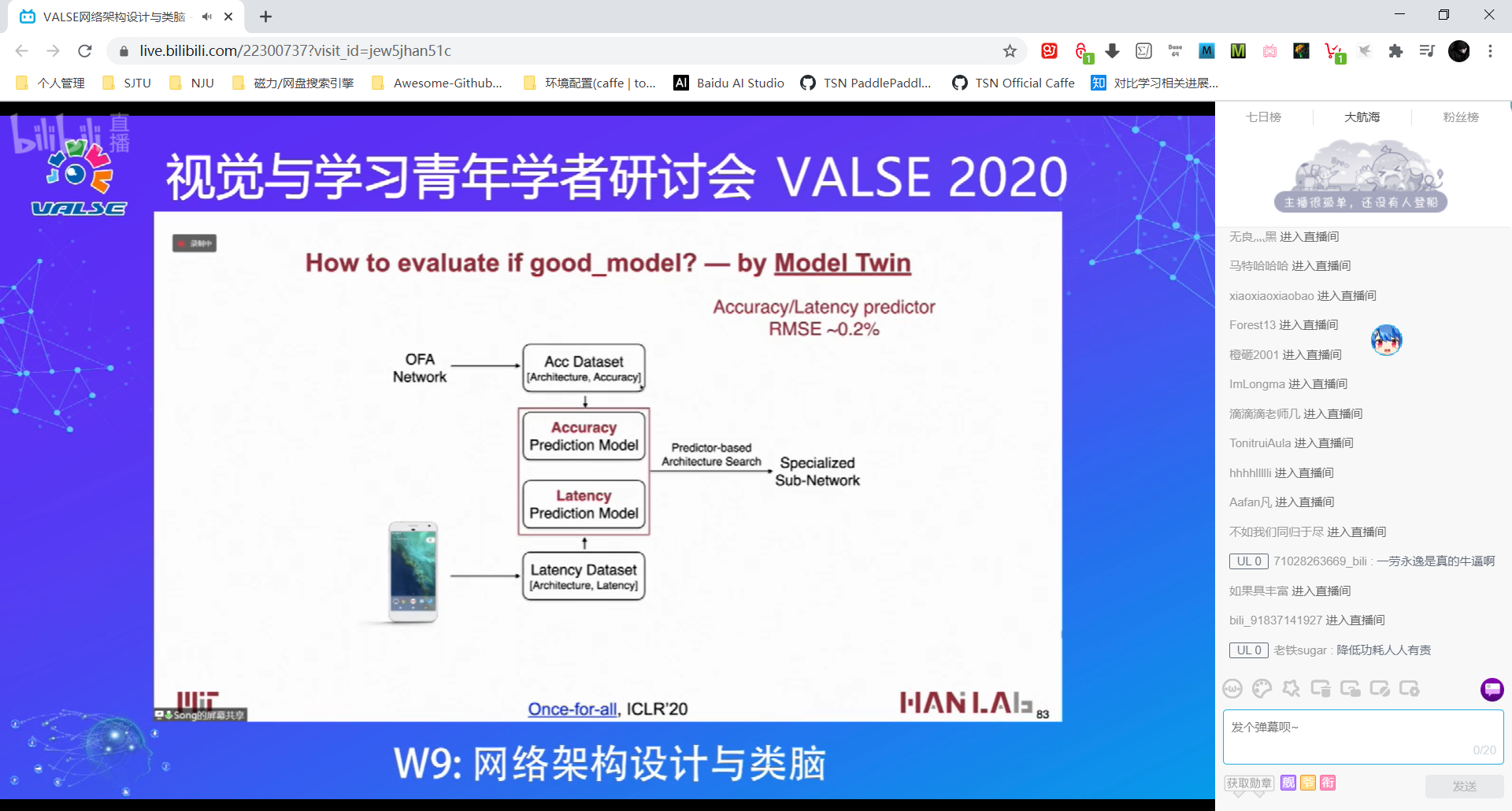

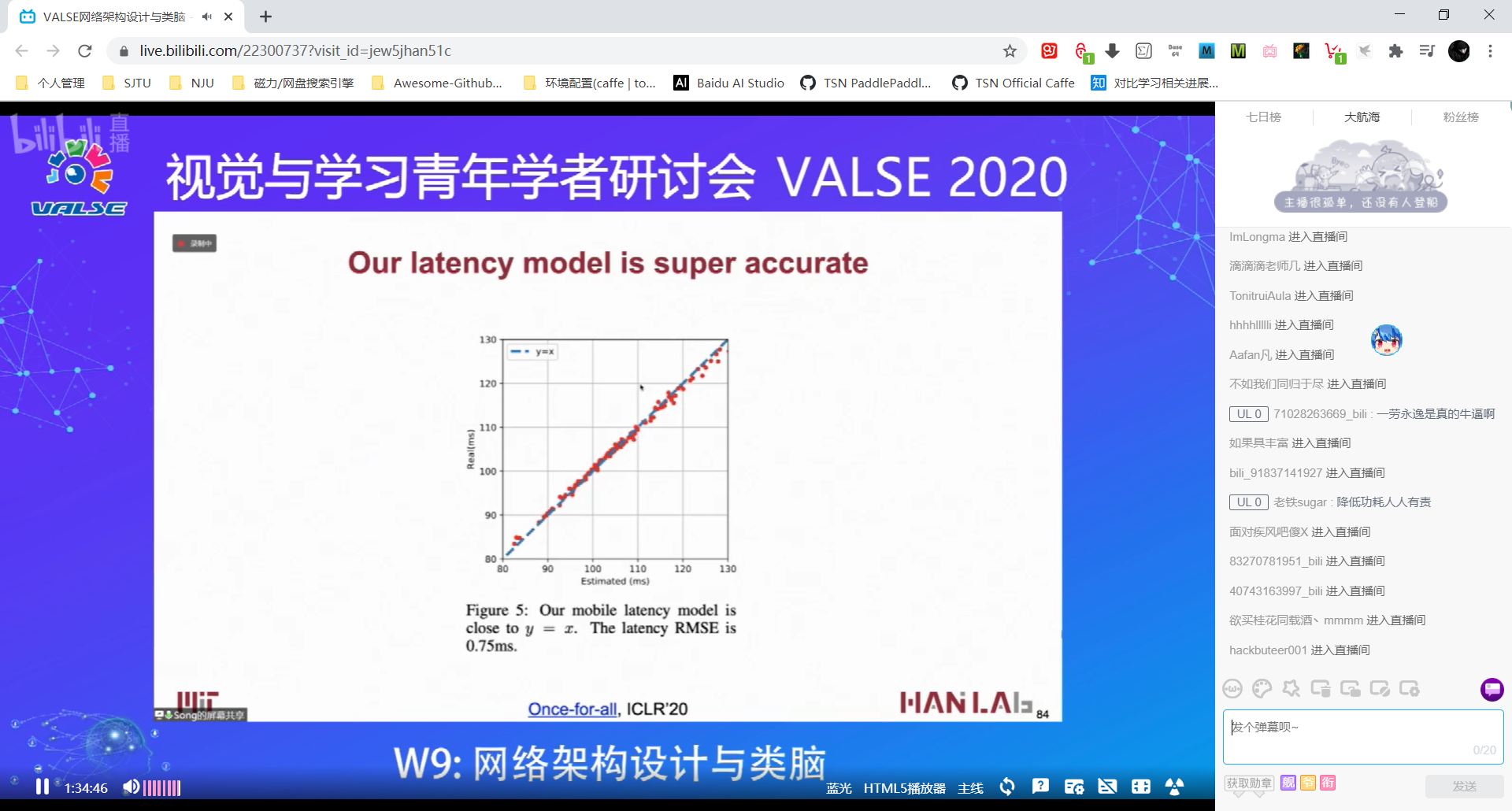

Accuracy-latency Predictor

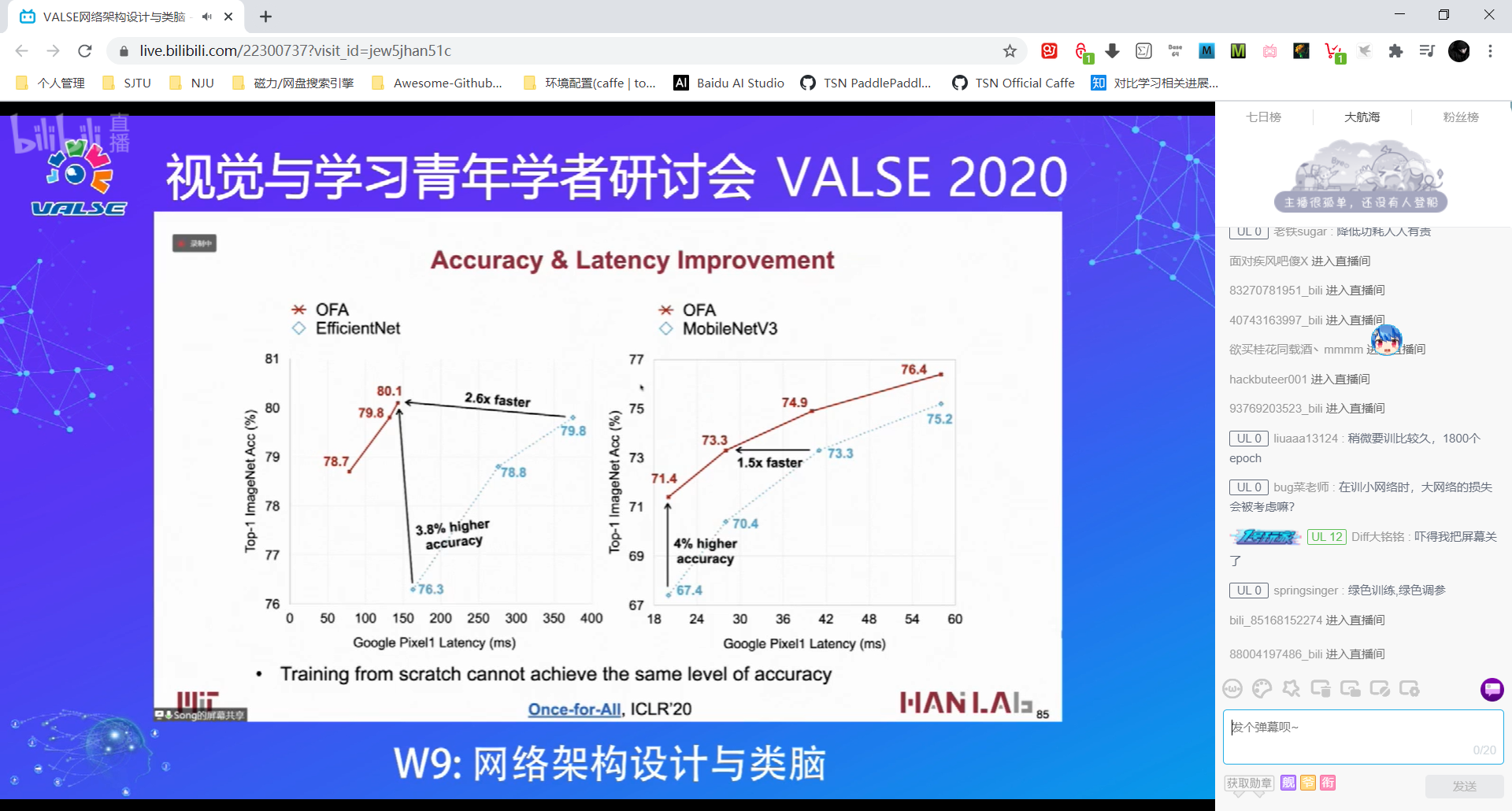

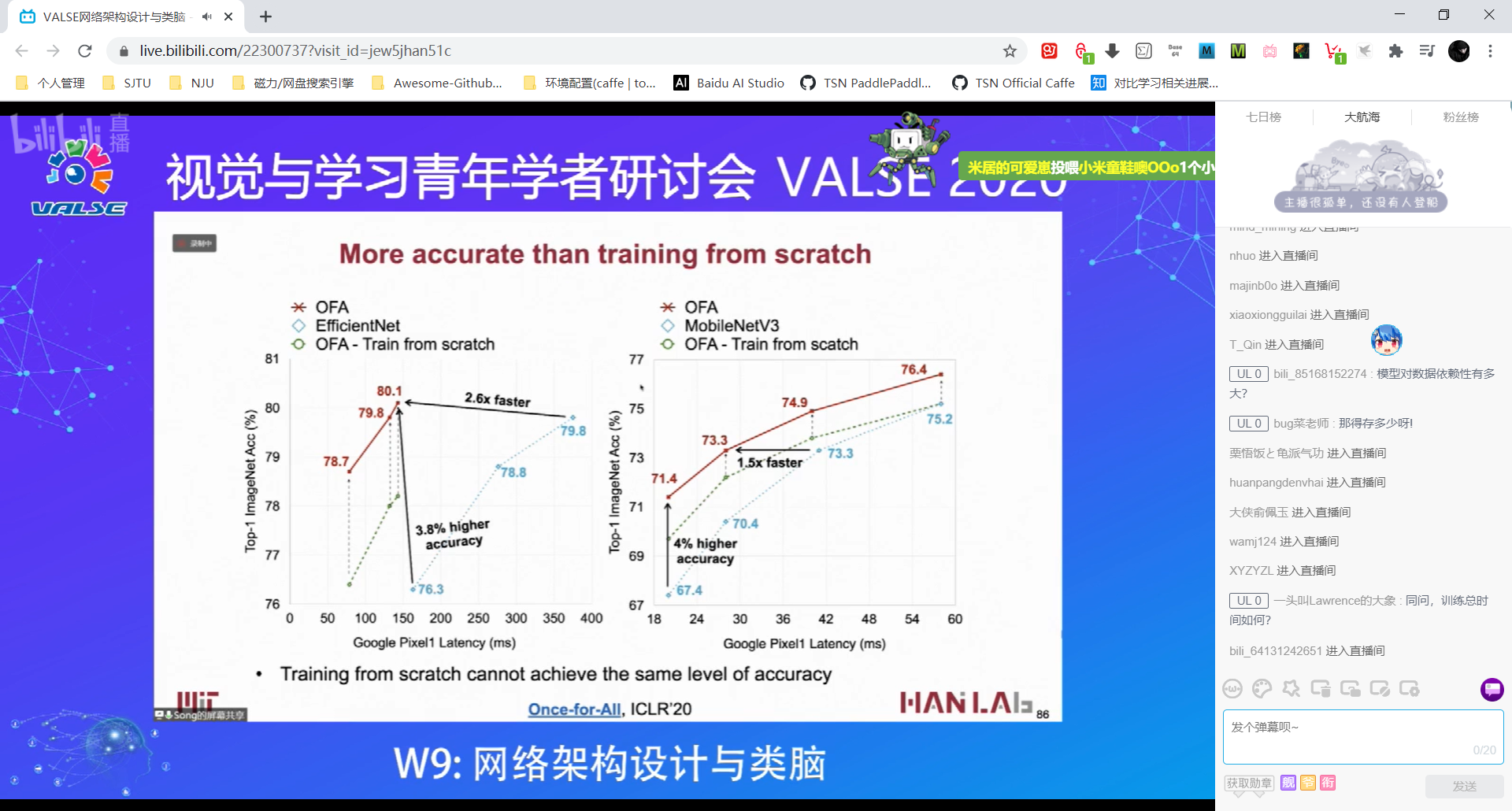

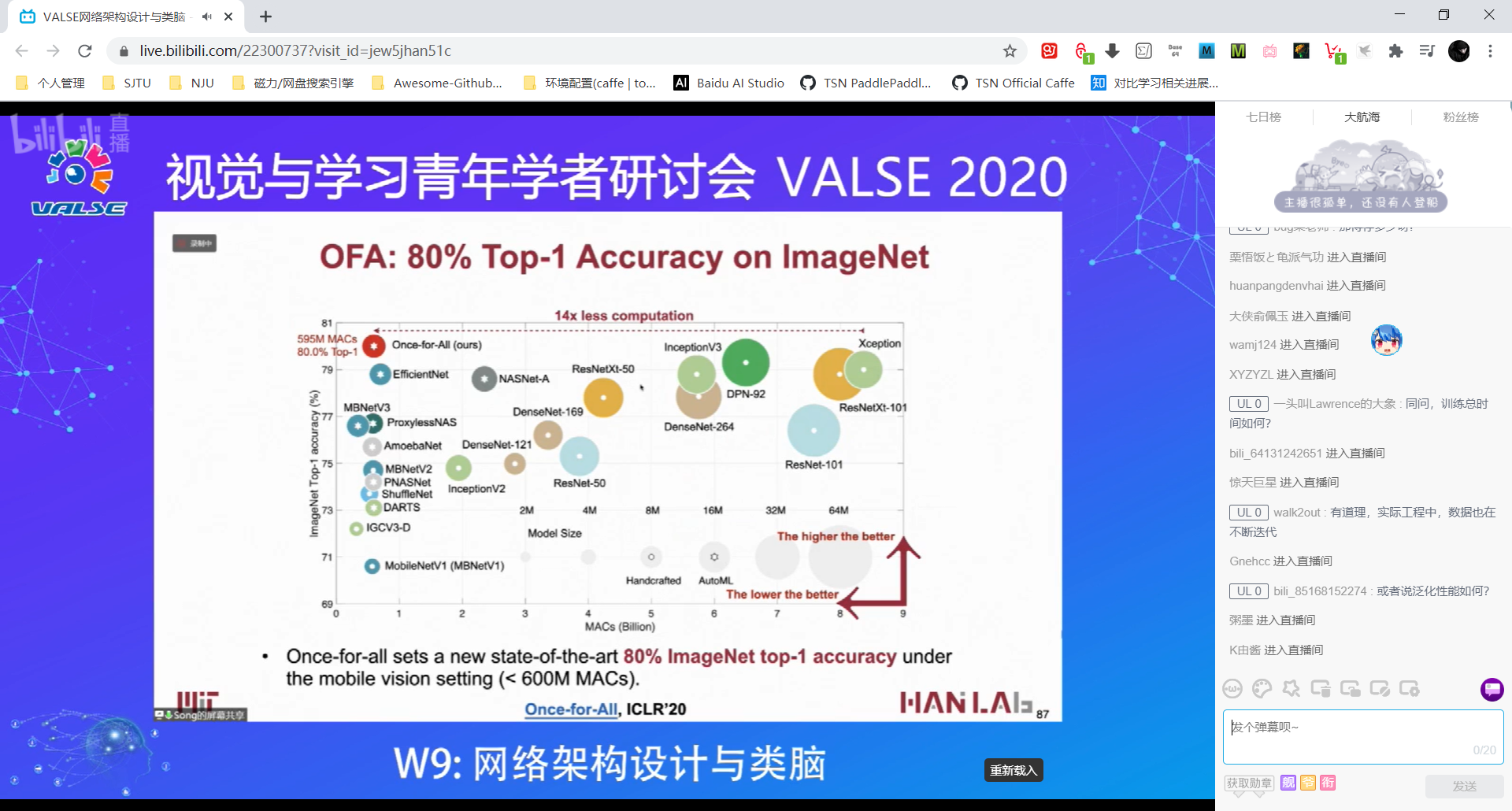

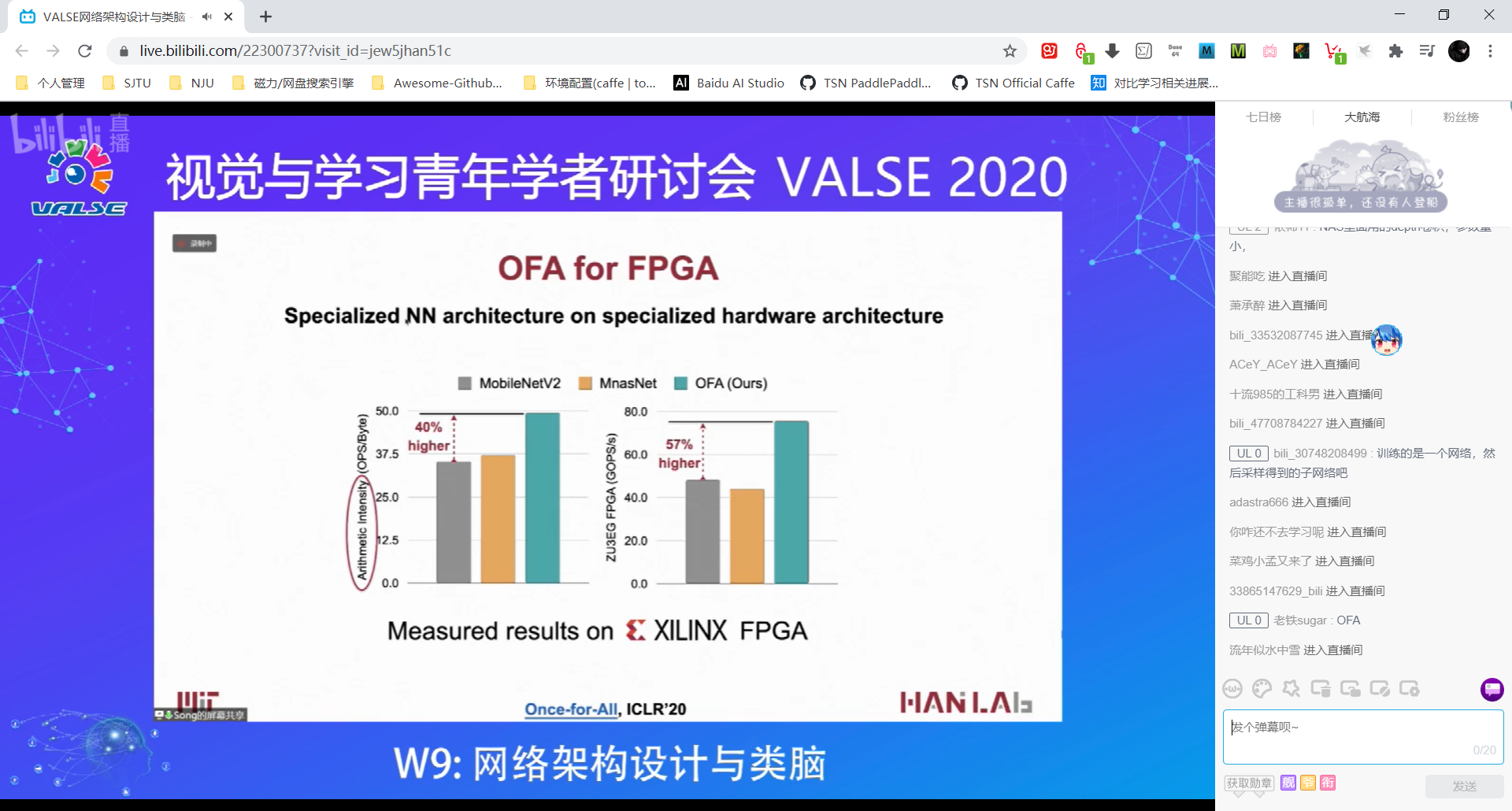

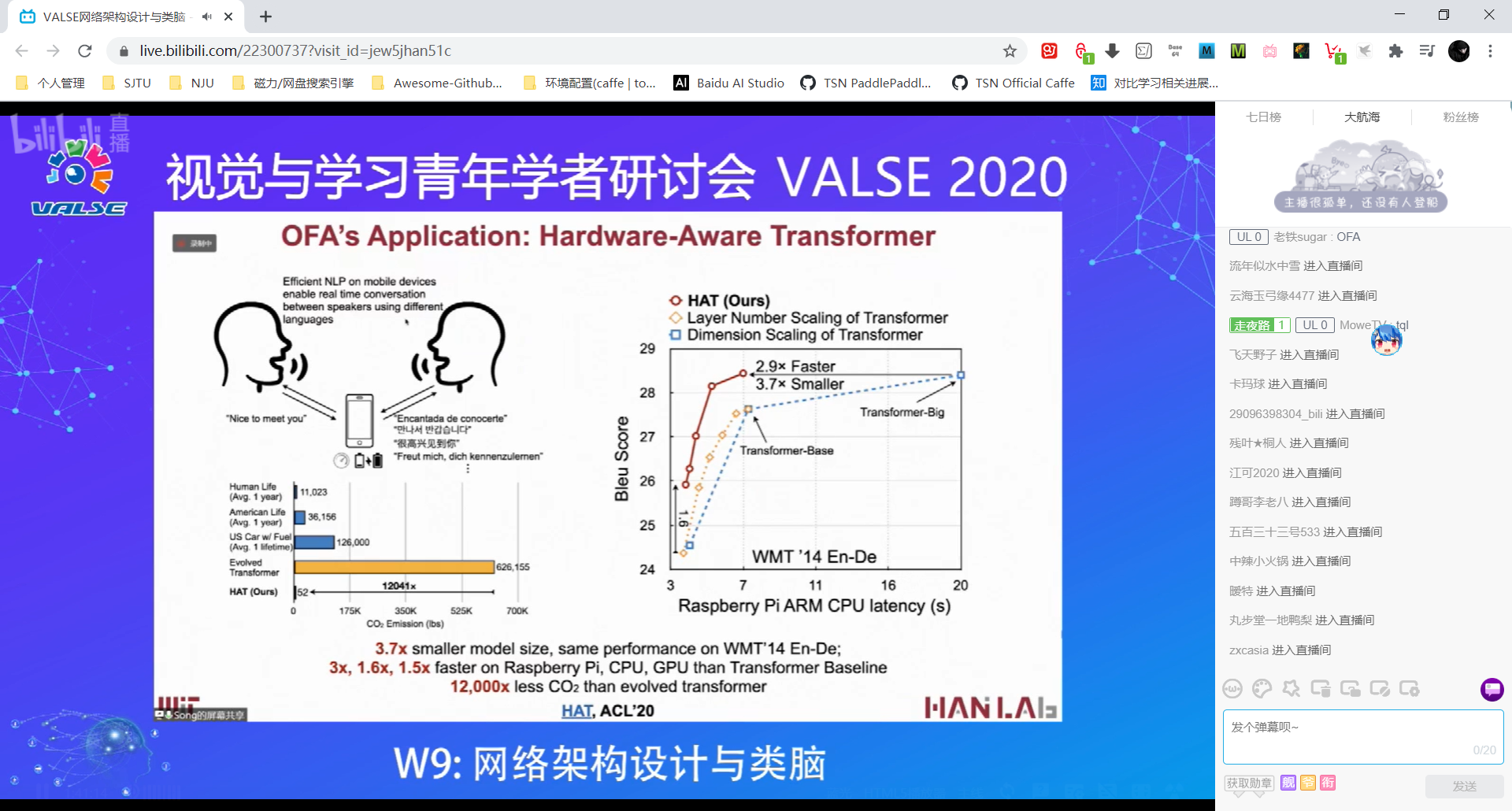

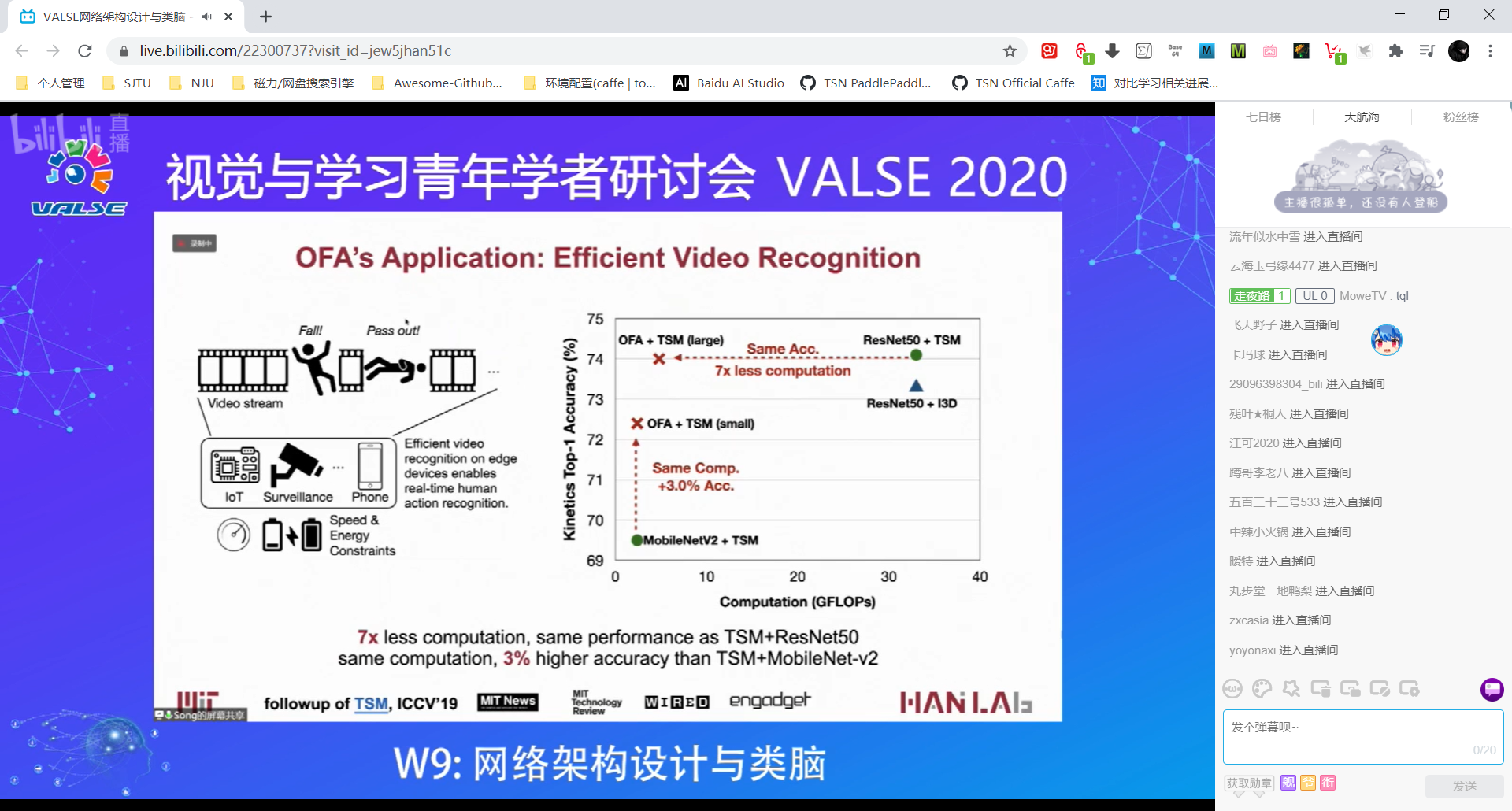

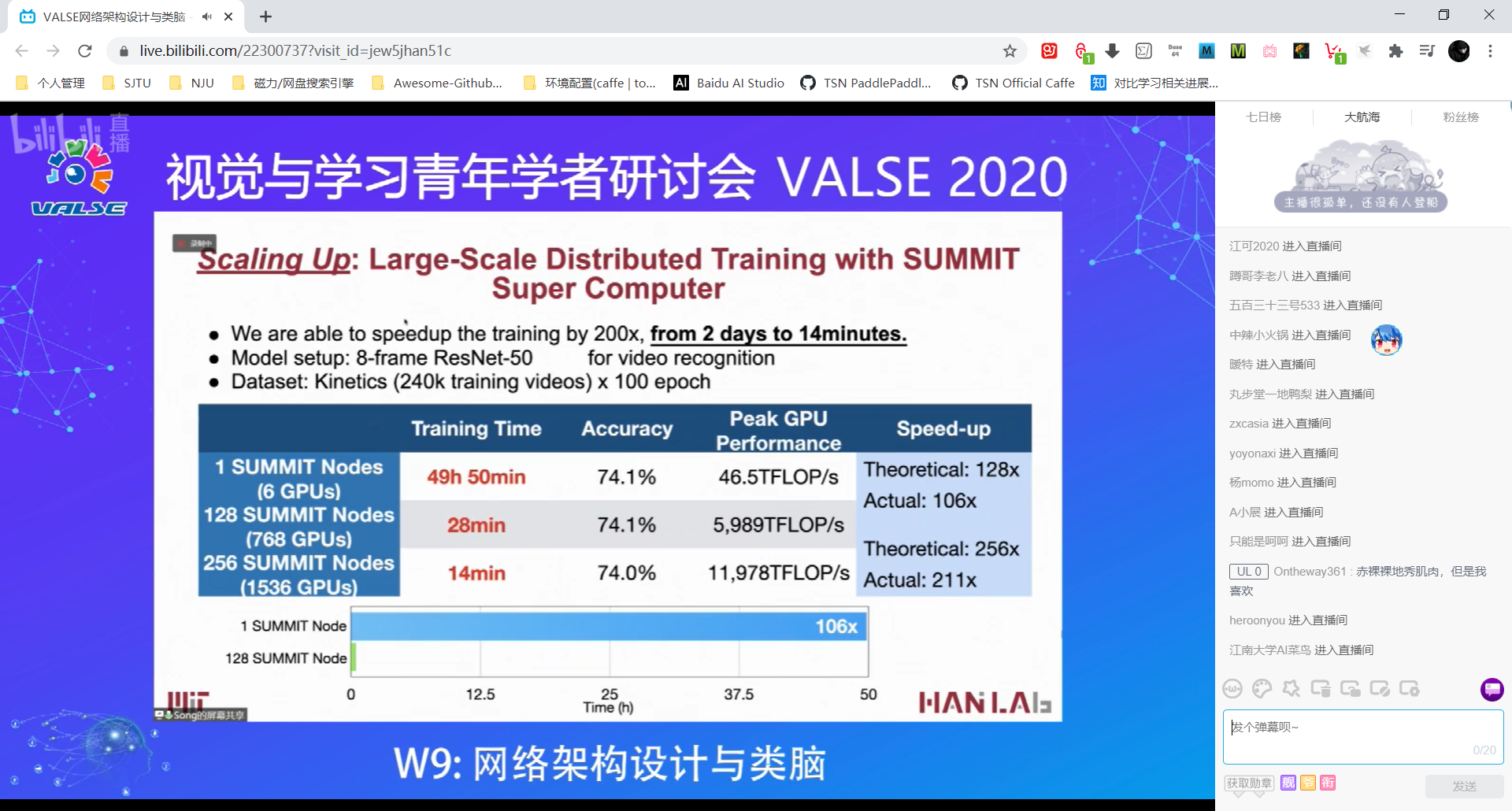

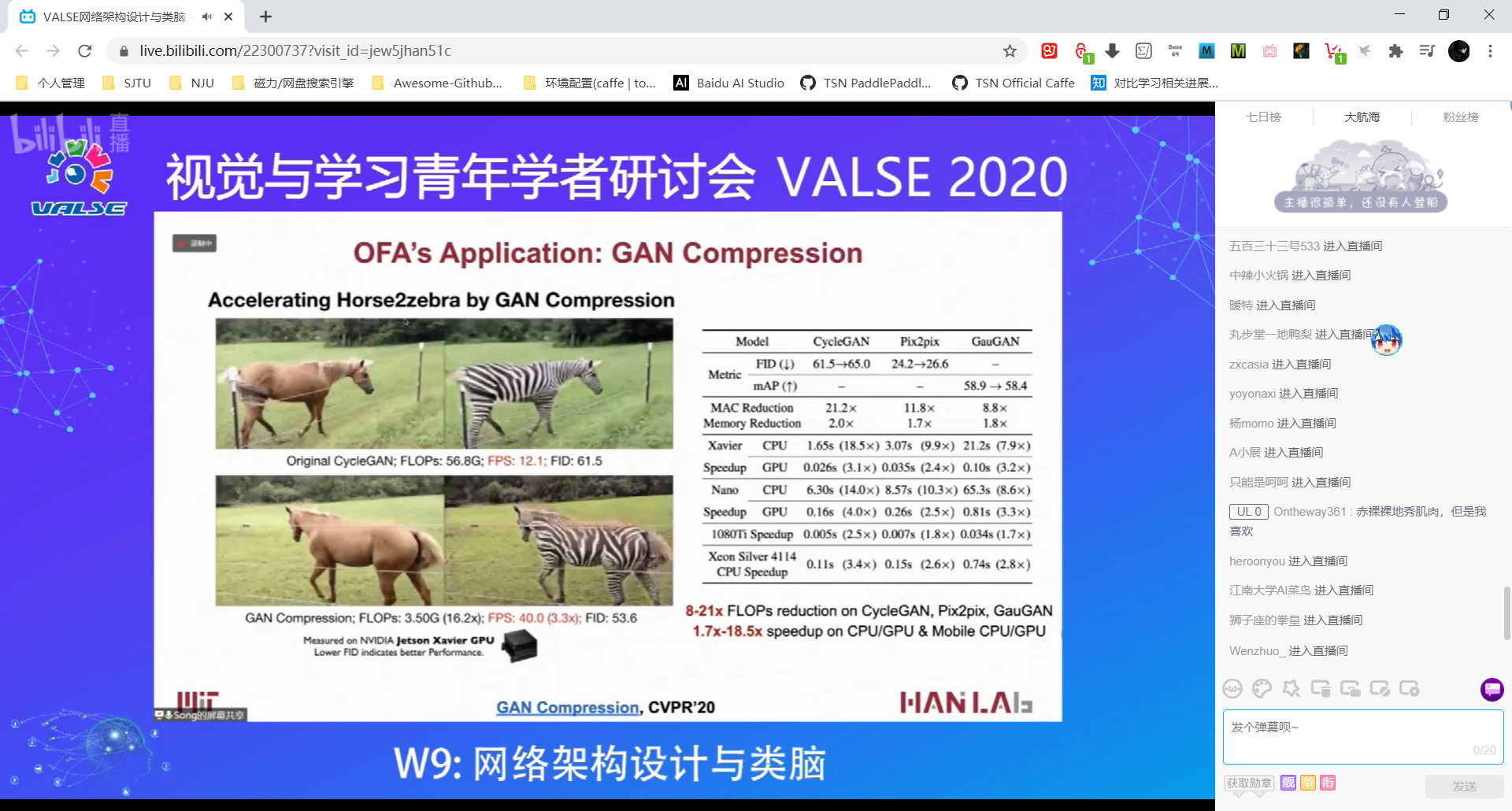

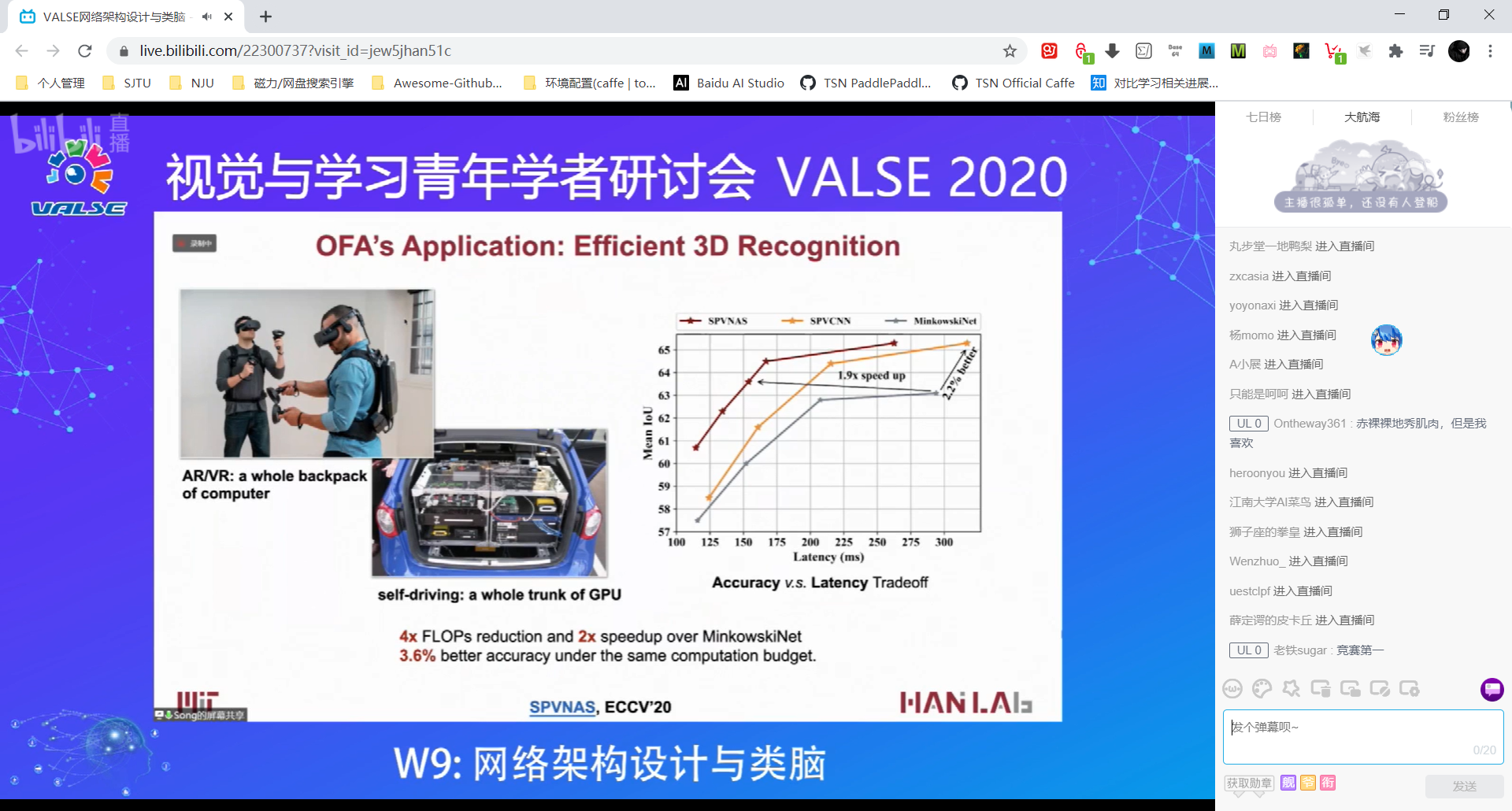

Performance

3. Rethinking Bottleneck and Self-attention Structures for Efficient Network Design

【时间】10:20-10:50

【讲者】冯佳时(National University of Singapore)

【题目】Rethinking Bottleneck and Self-attention Structures for Efficient Network Design

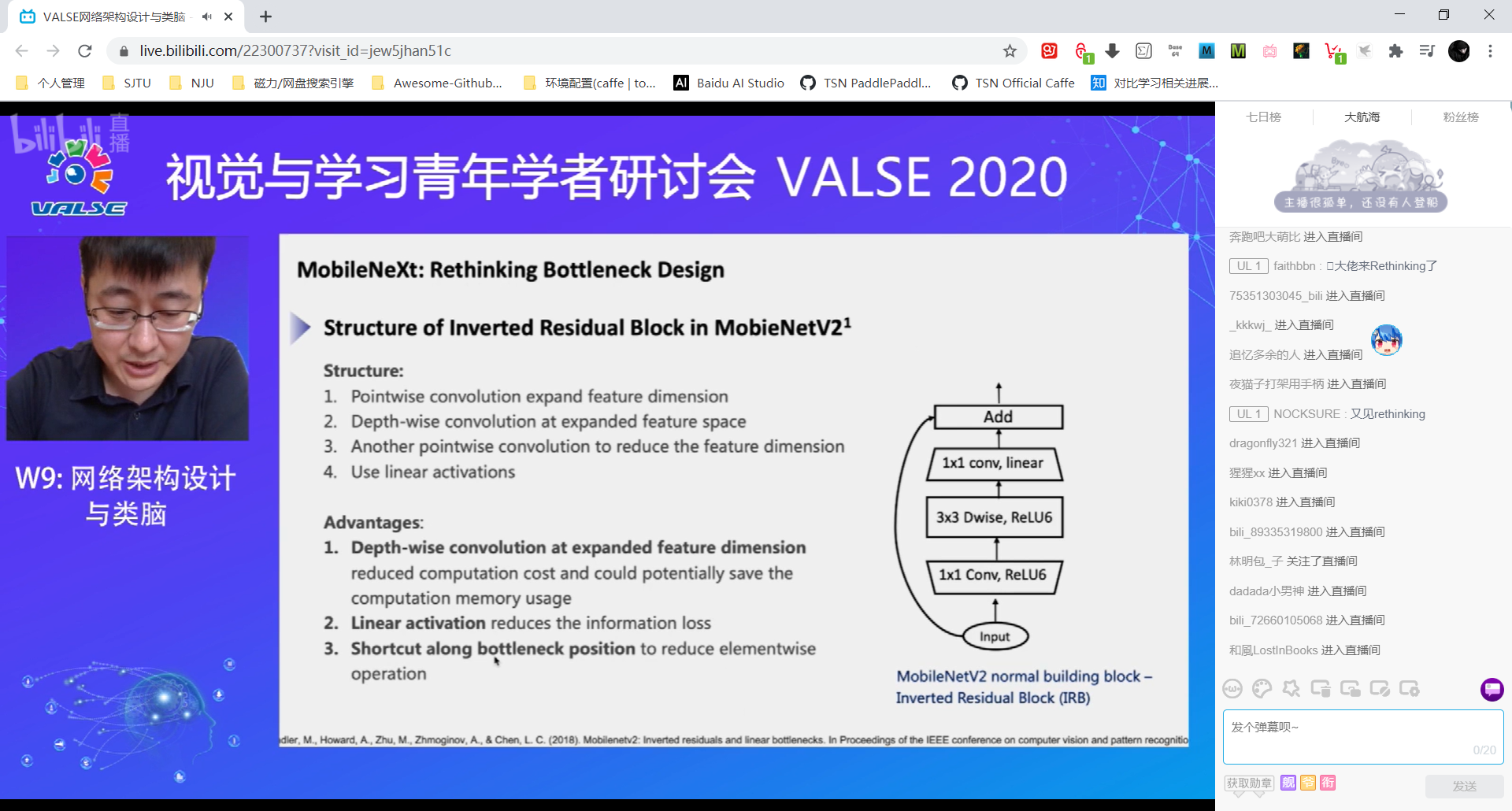

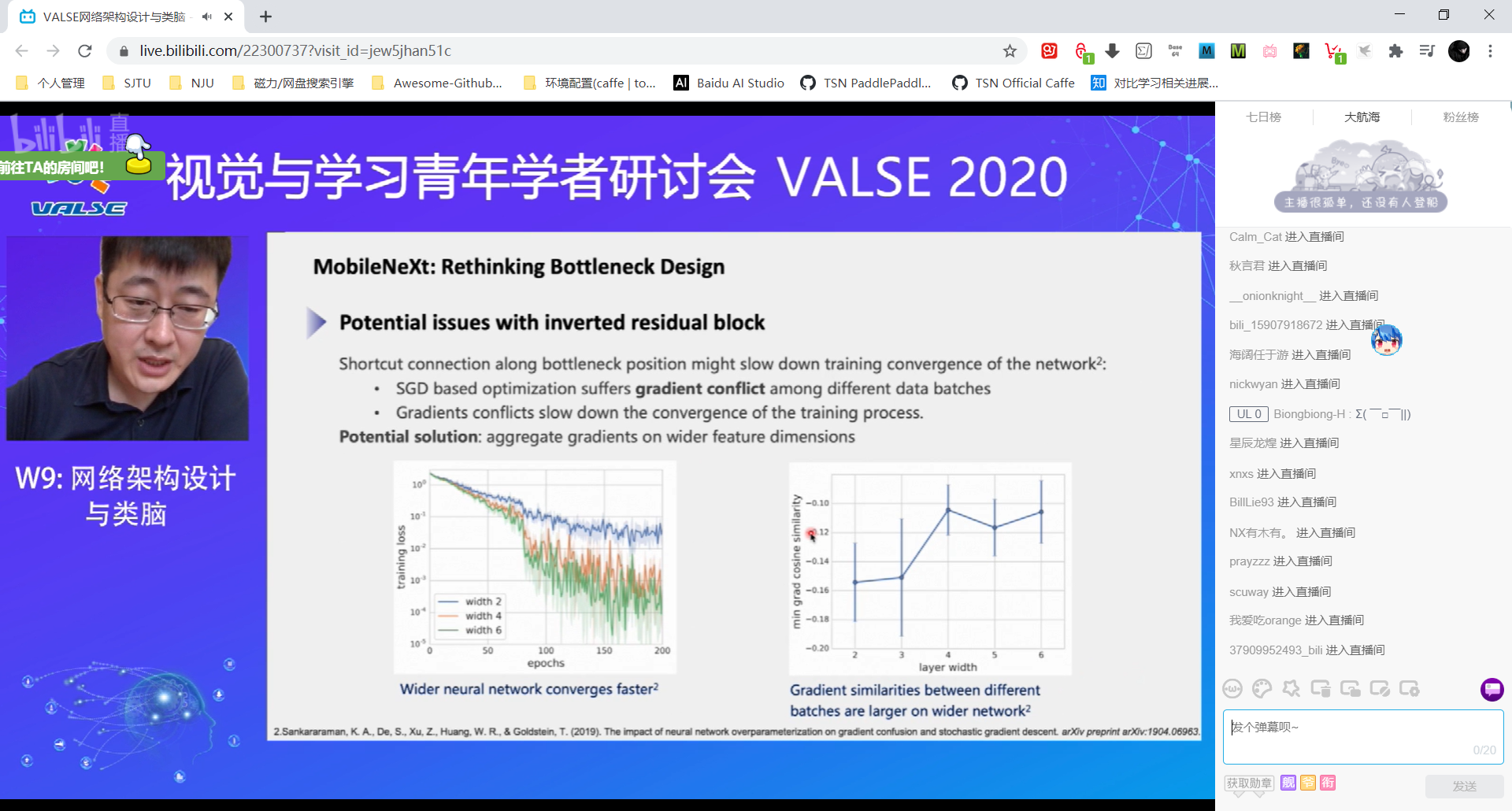

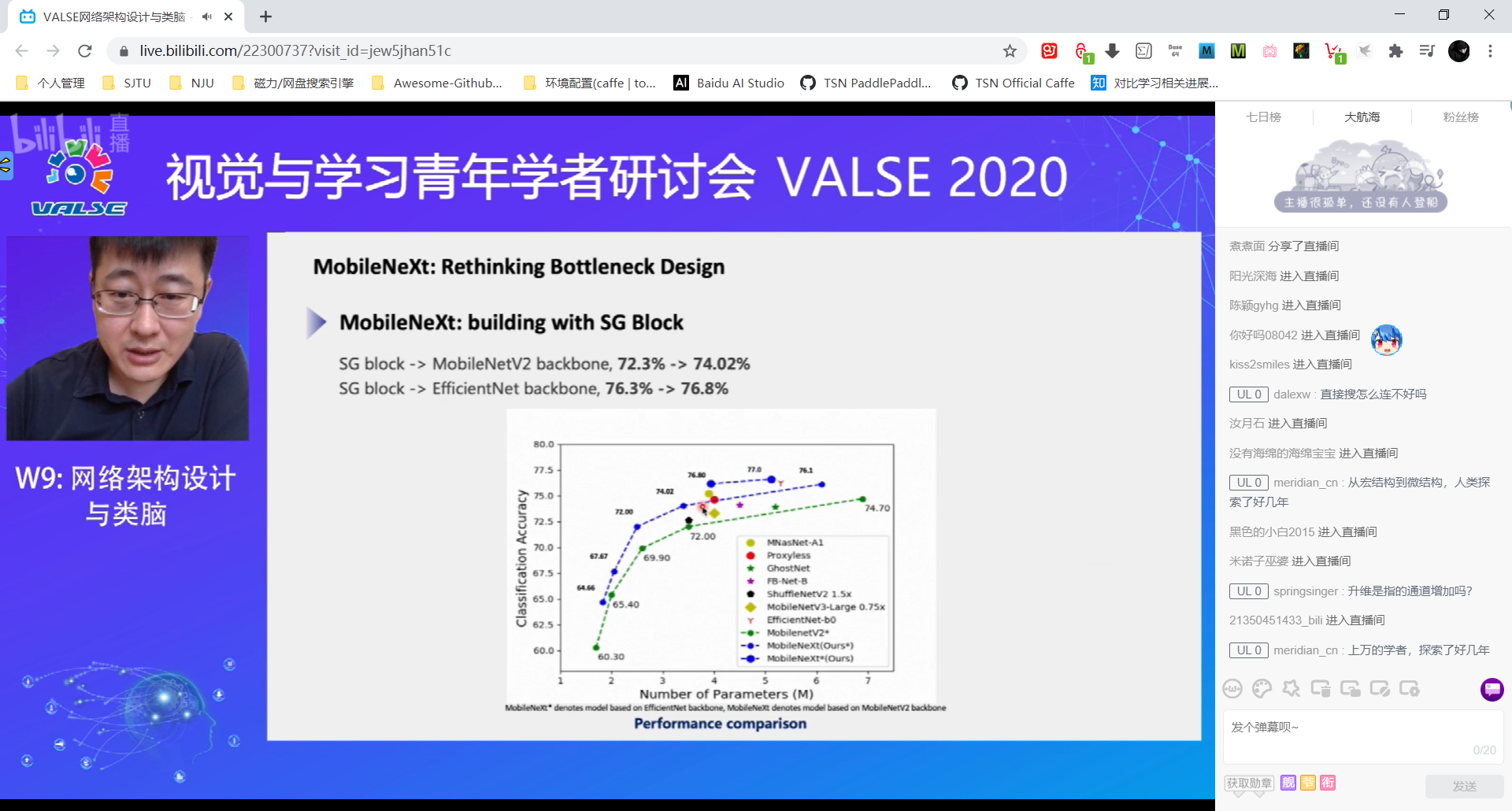

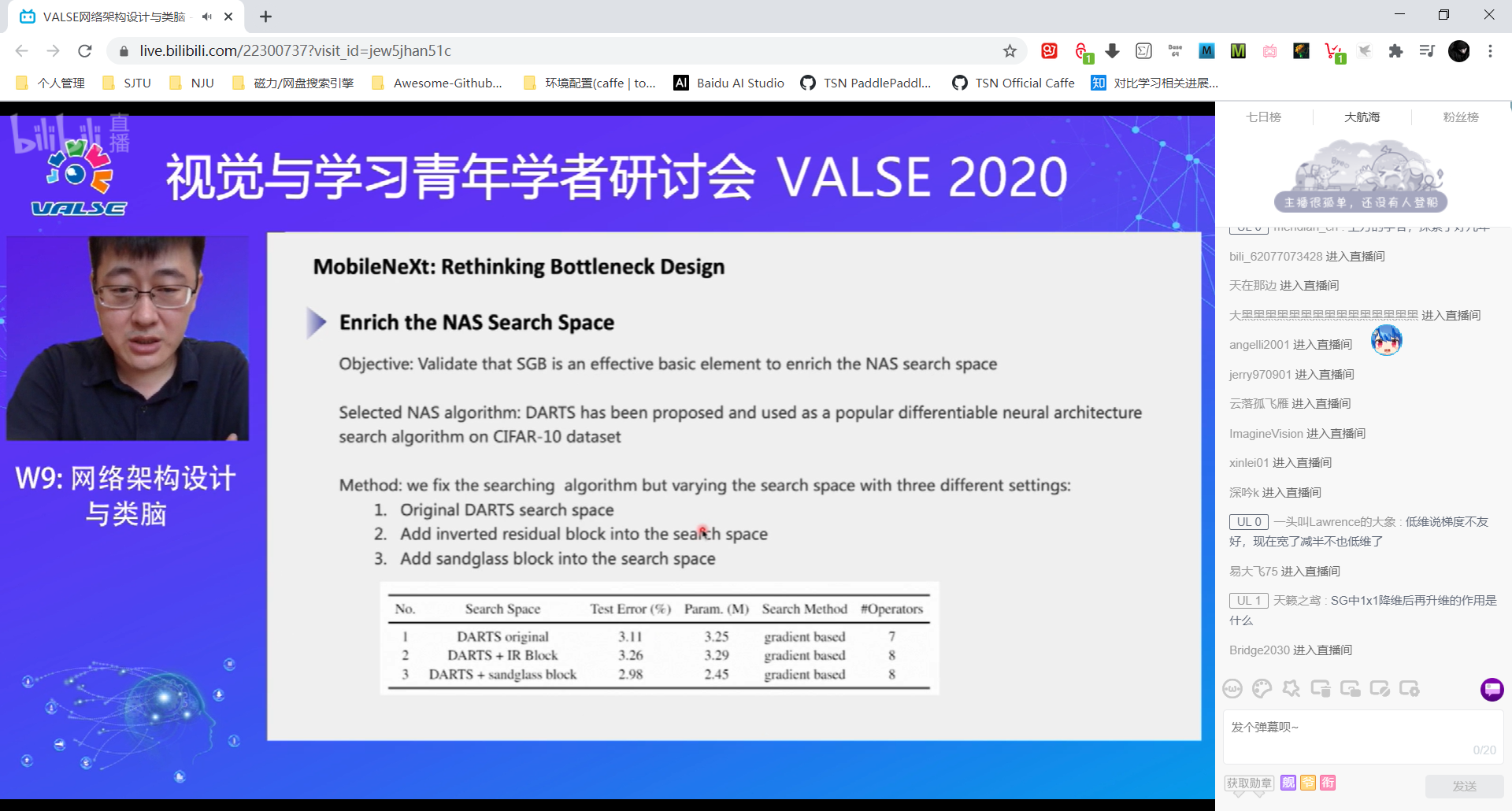

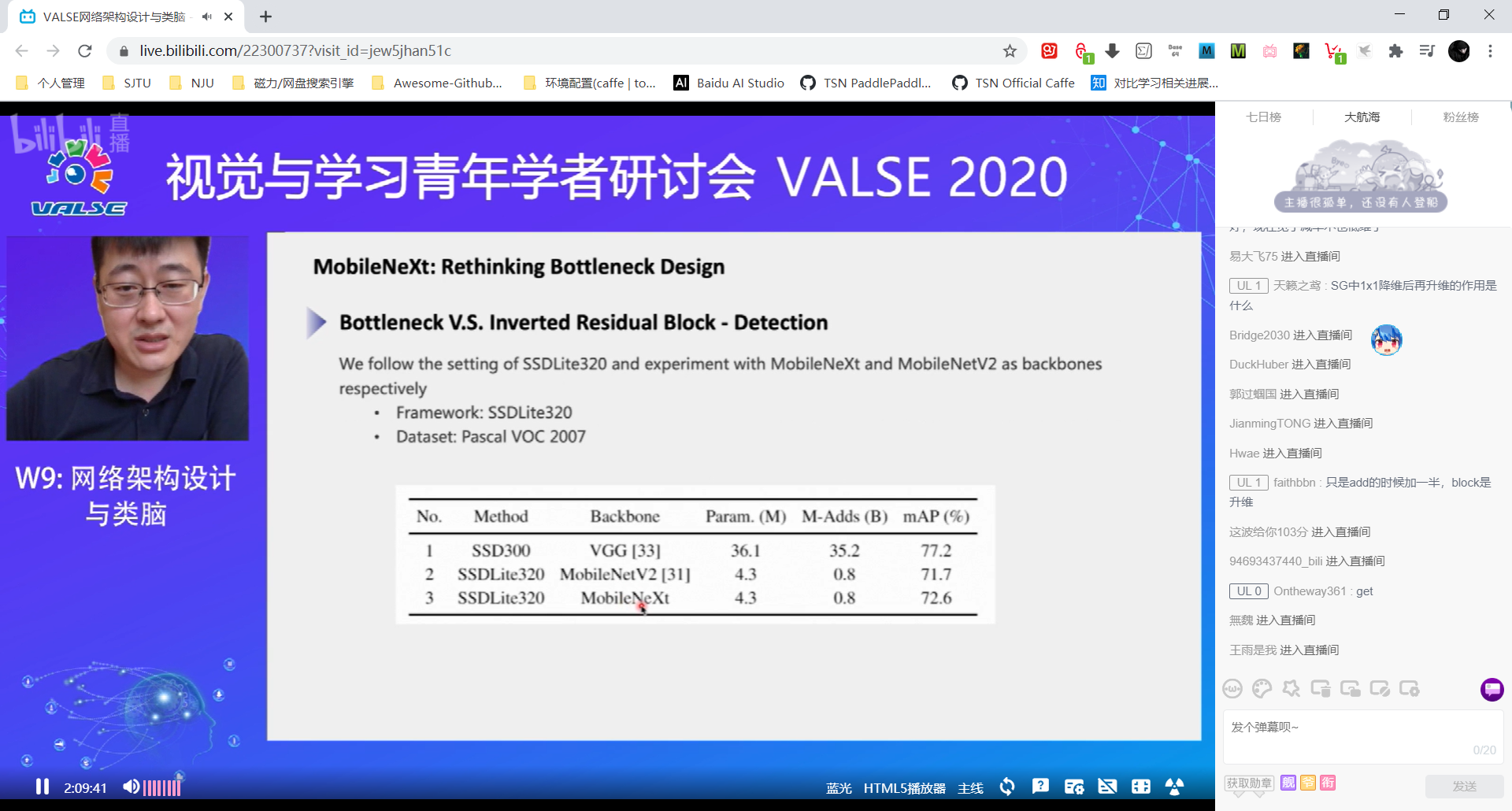

3.1 MobileNeXt: Bottleneck 模块的修改

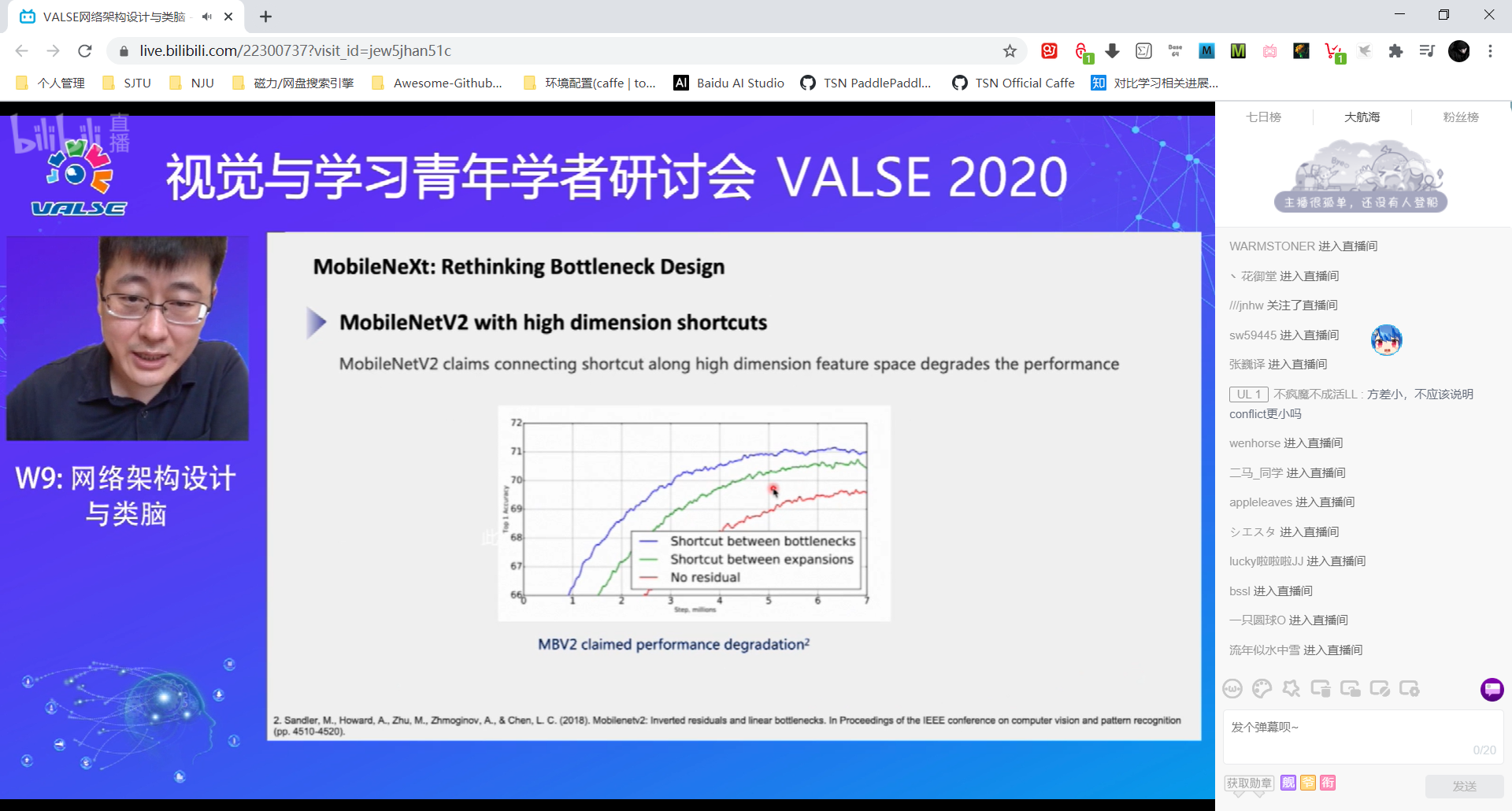

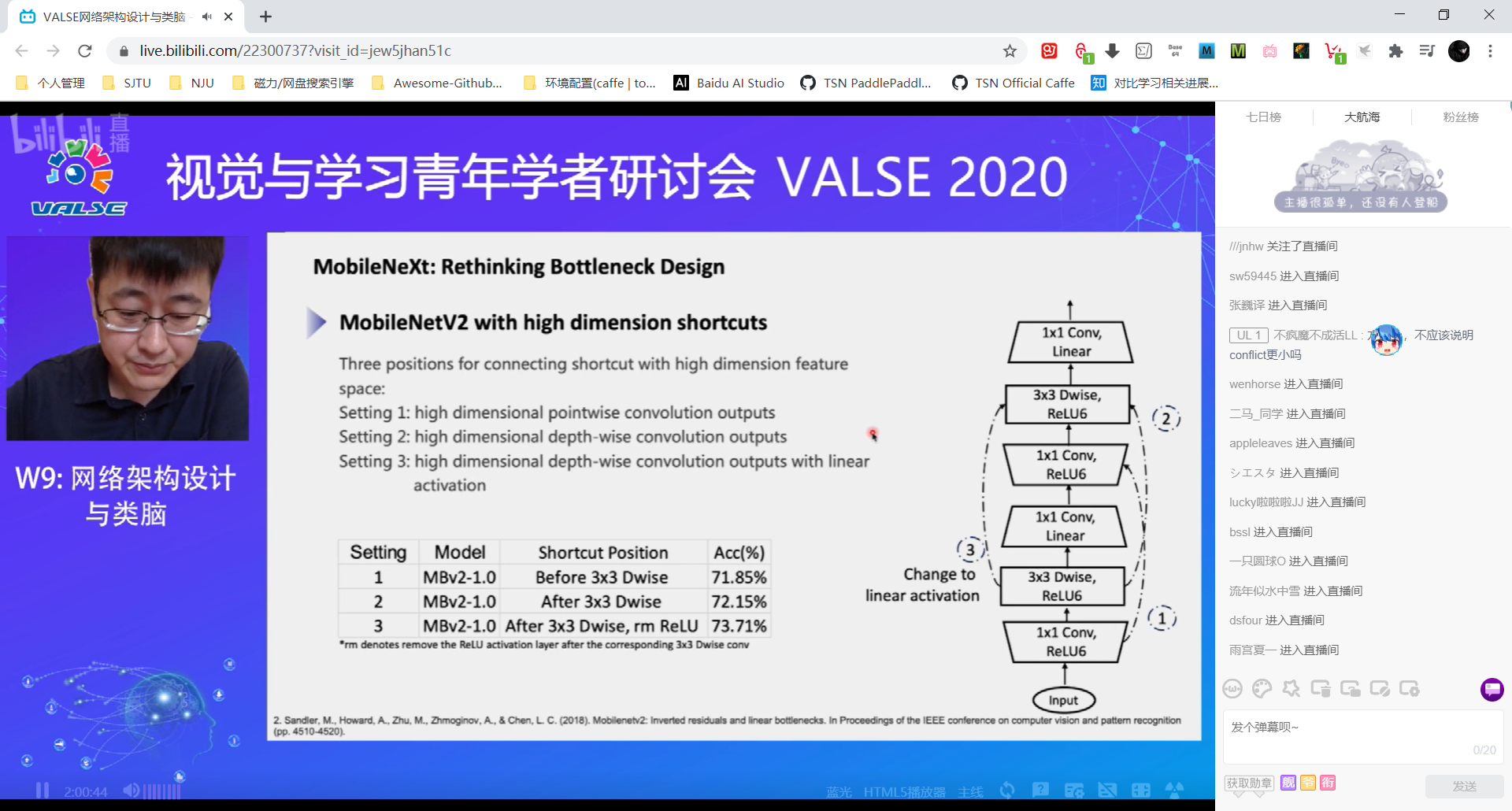

实验表明我们希望shortcut连接在宽网络上才能加速收敛,这与mobilenet v2的动机是相反的。

高维 shortcut 带来 computation overhead

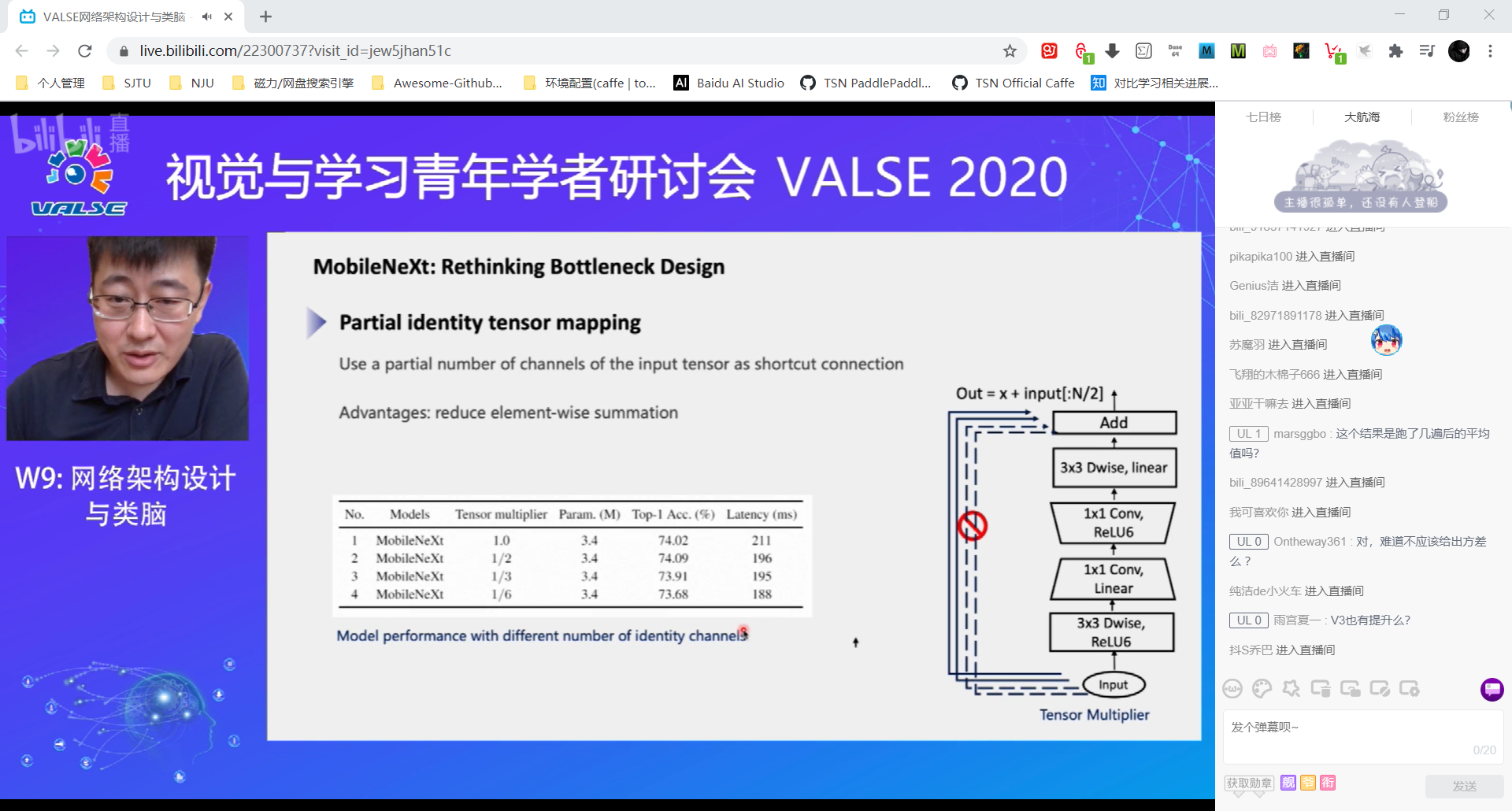

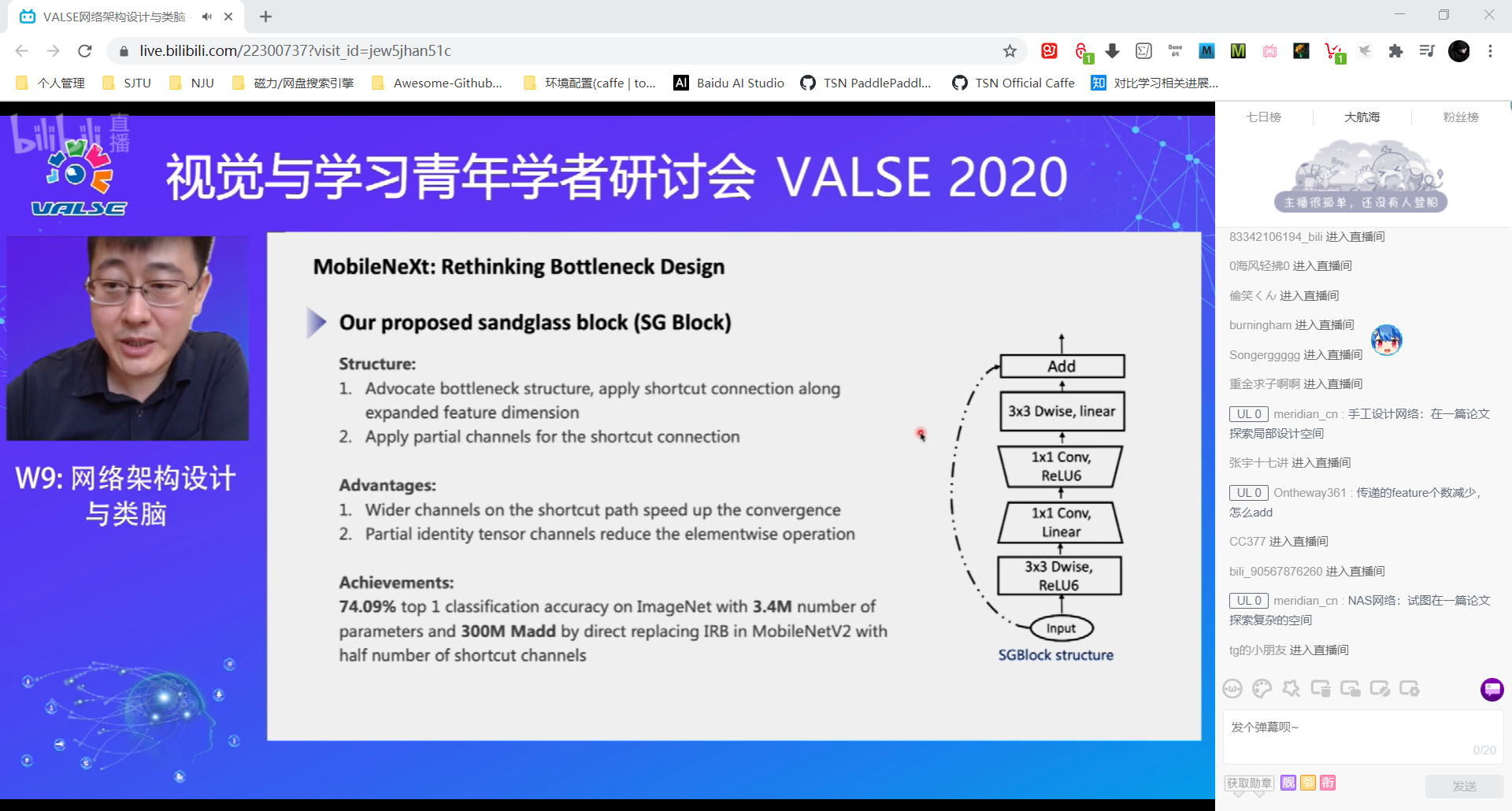

shortcut 连接在了升维之后的 feature 上(加速收敛),并且采用 partial connection 减少计算量

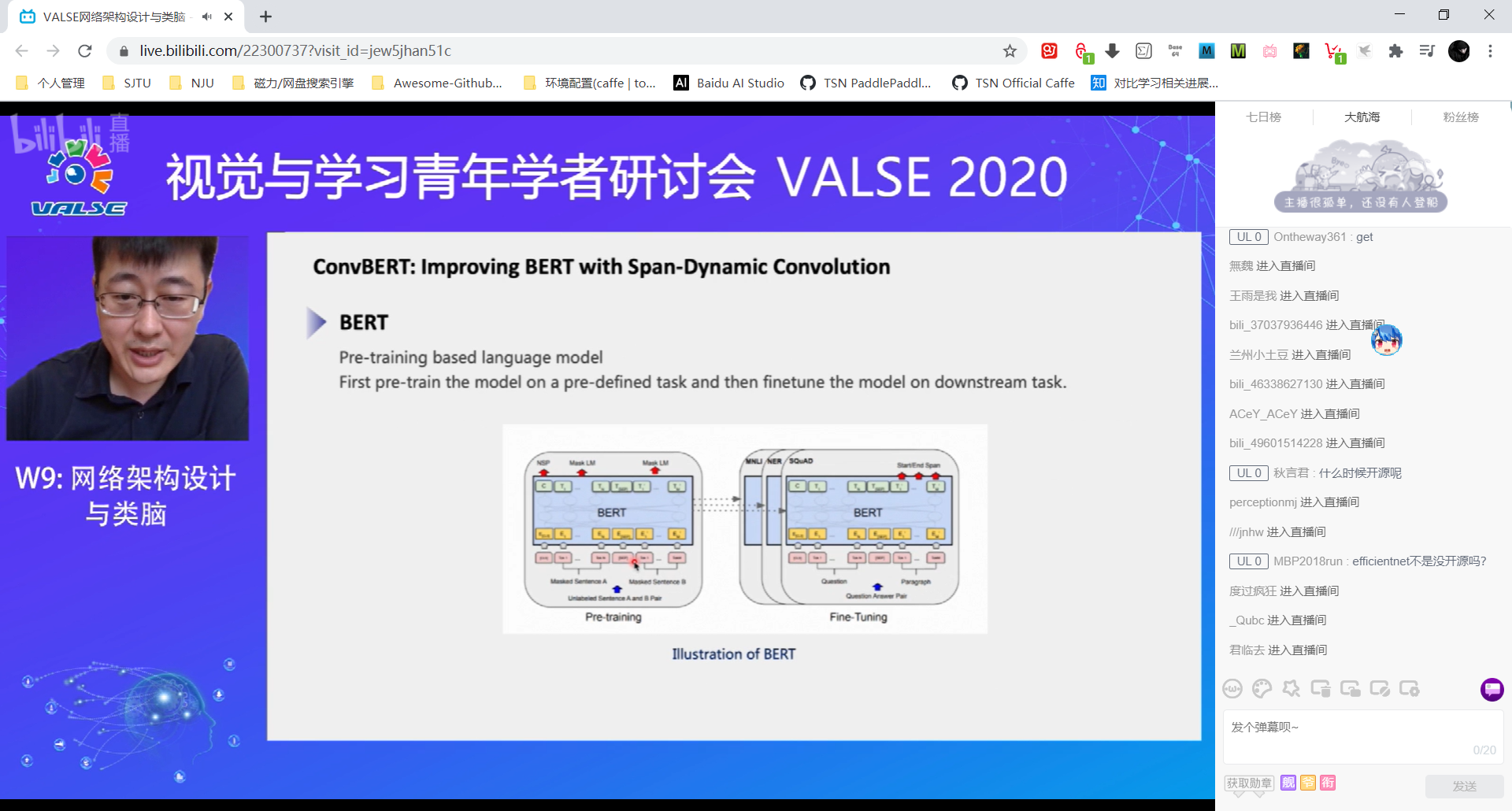

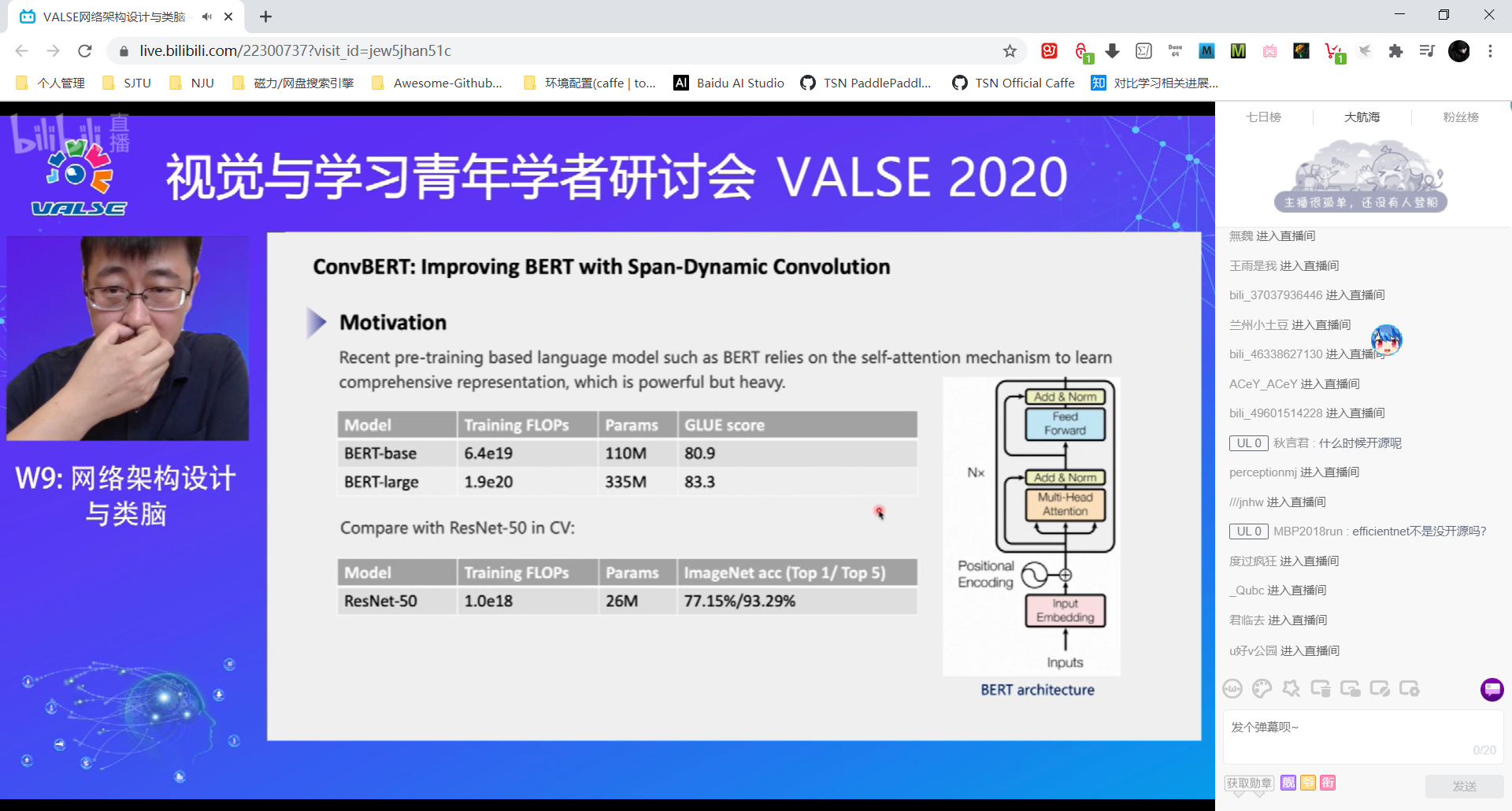

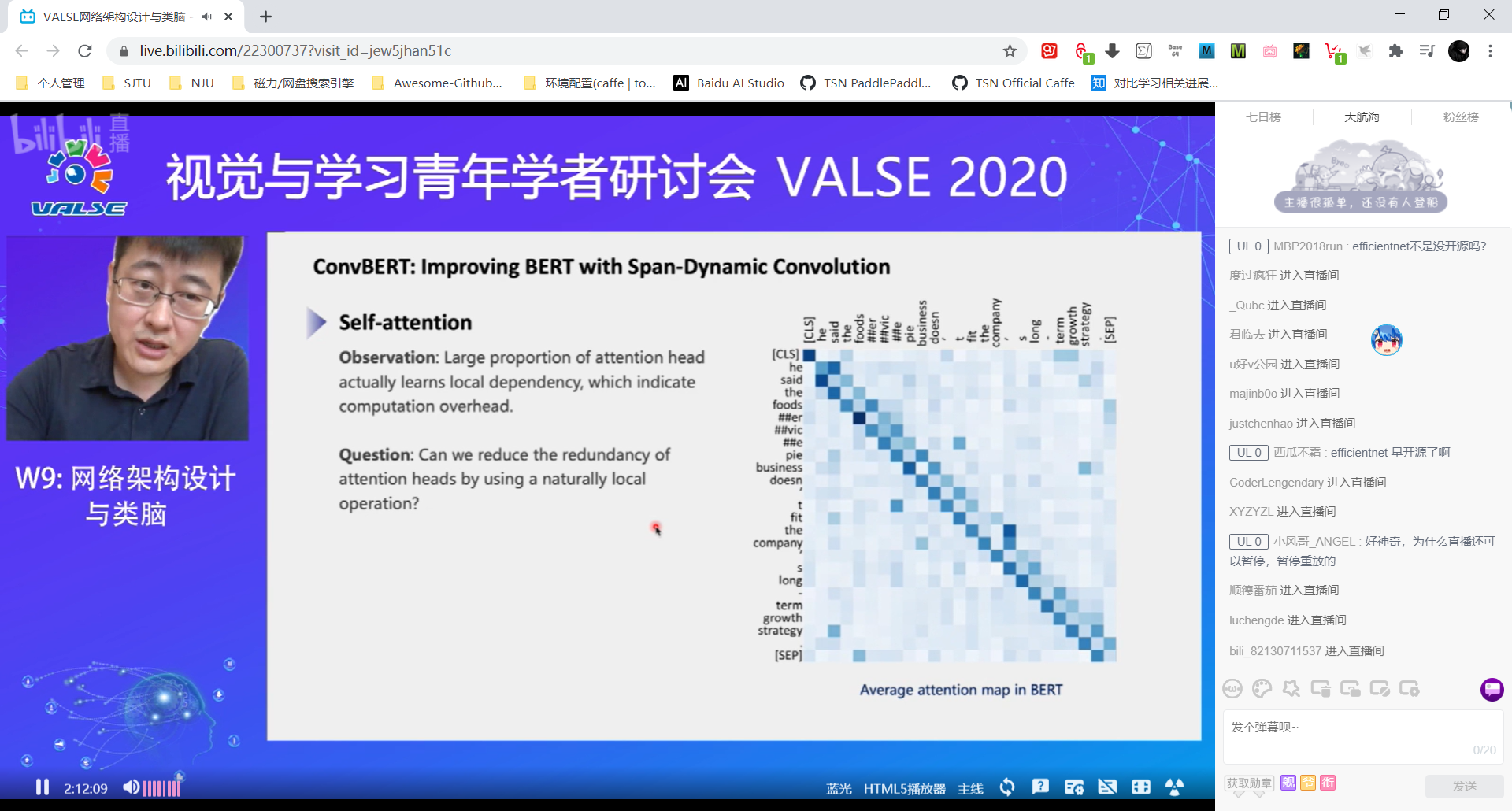

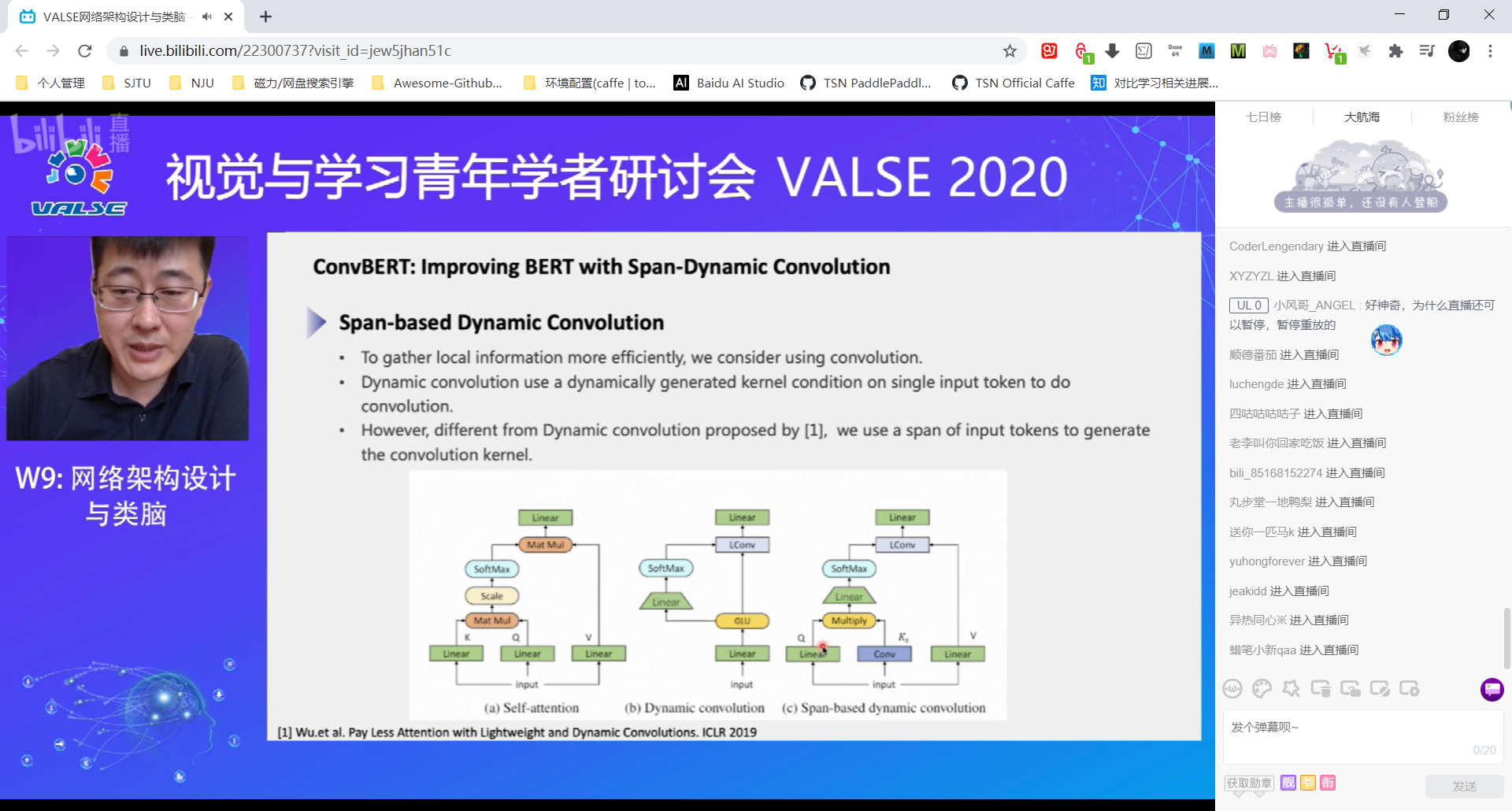

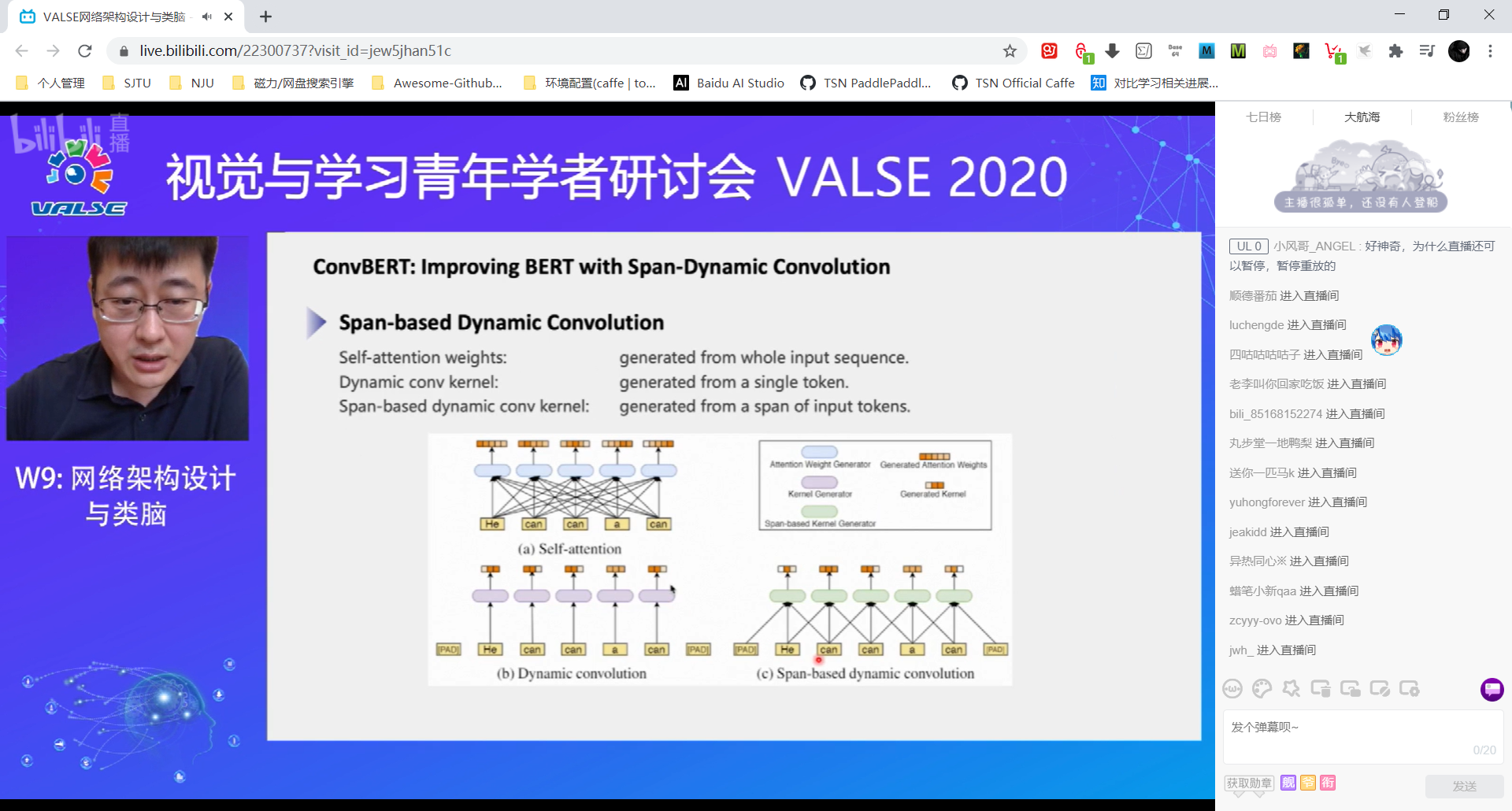

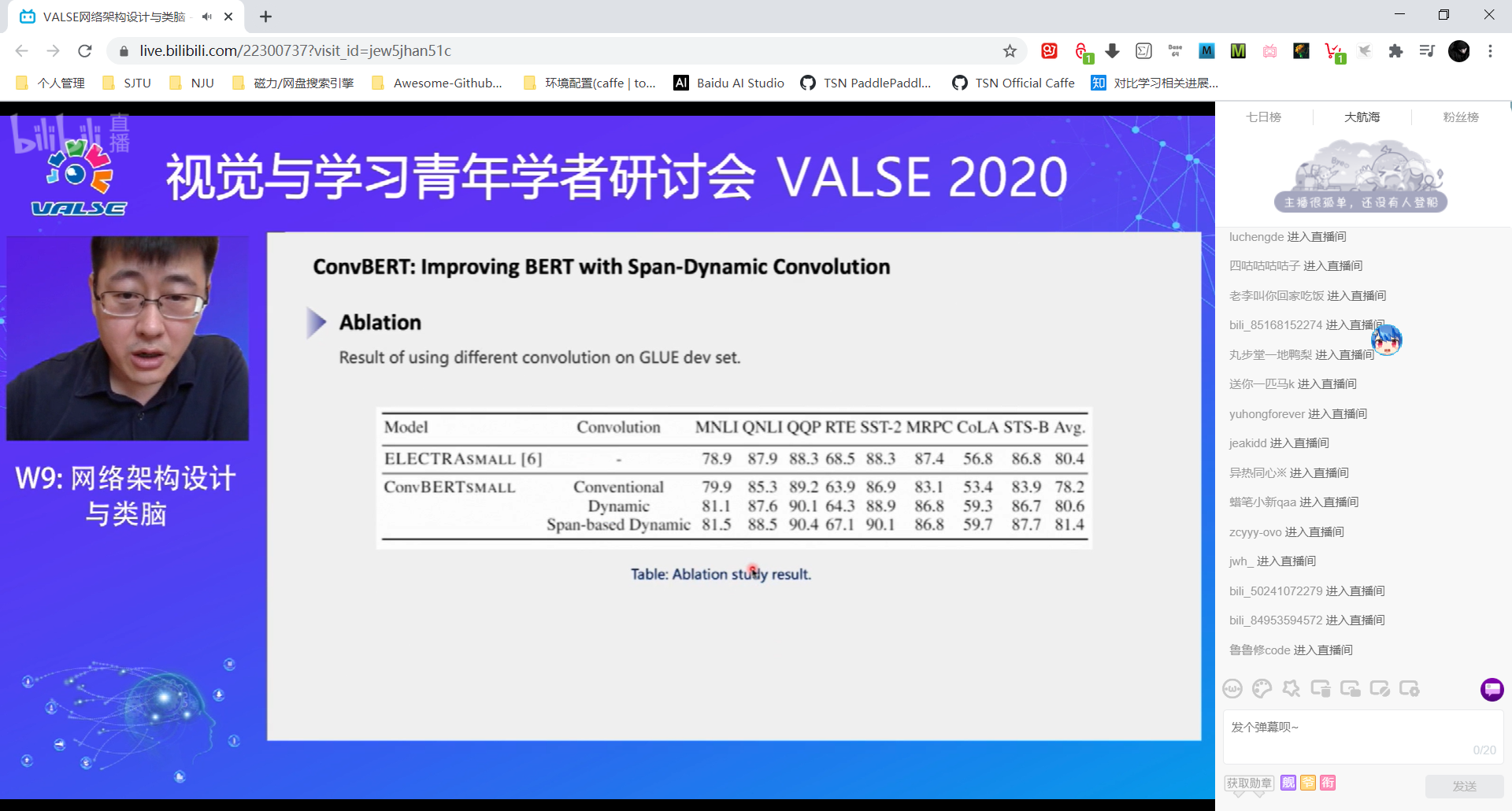

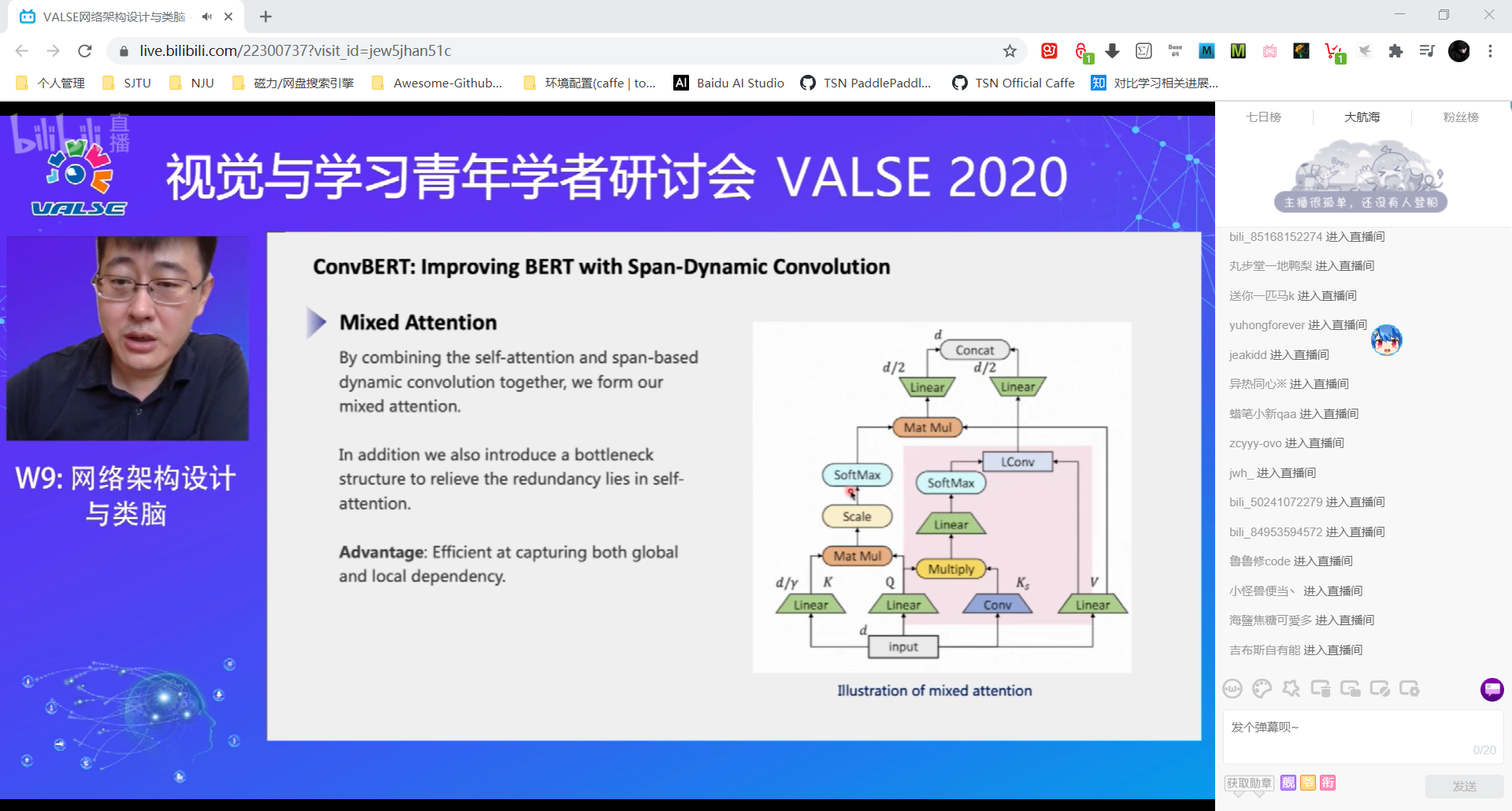

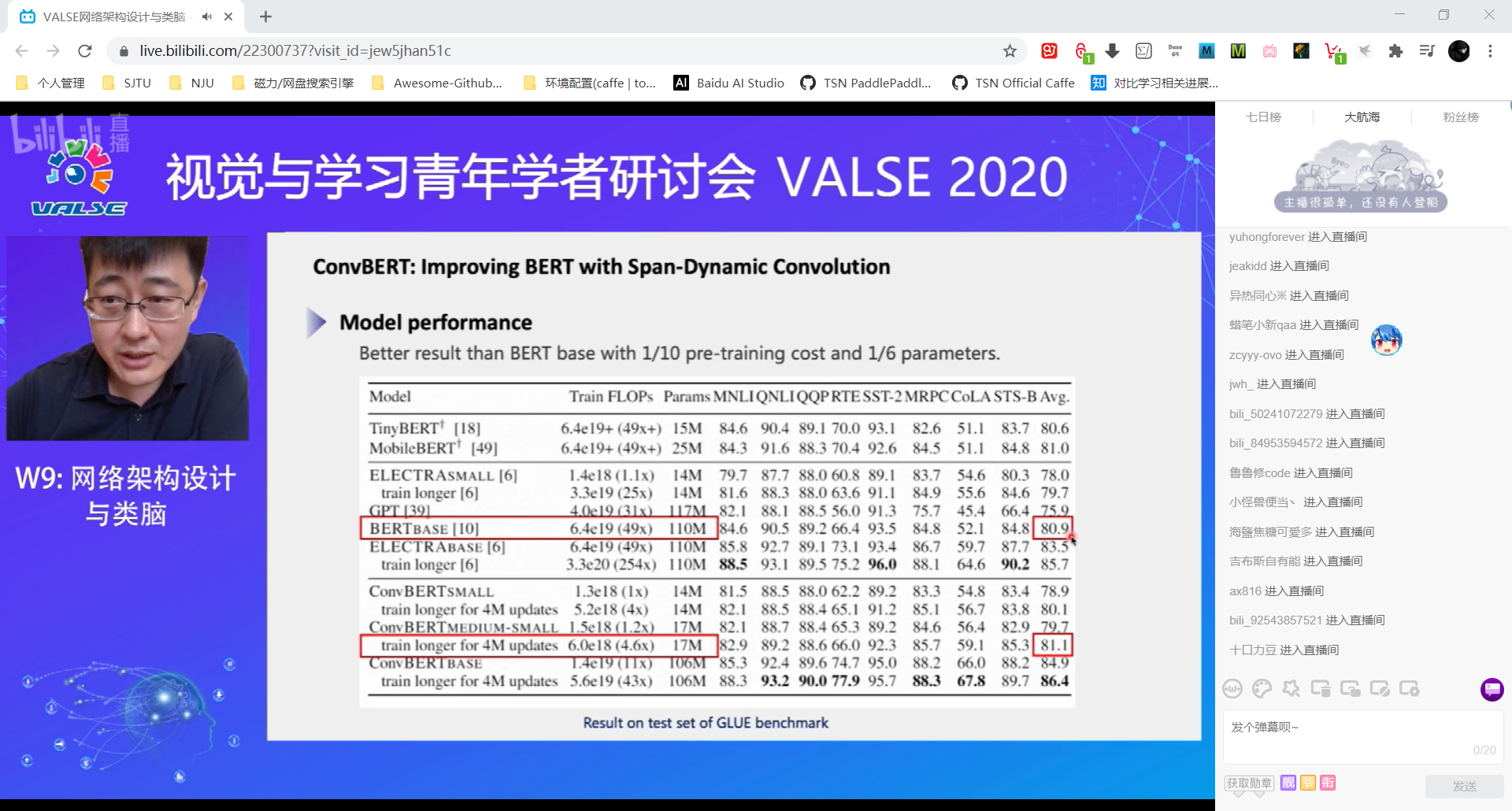

3.2 ConvBERT: 自注意力模块的修改

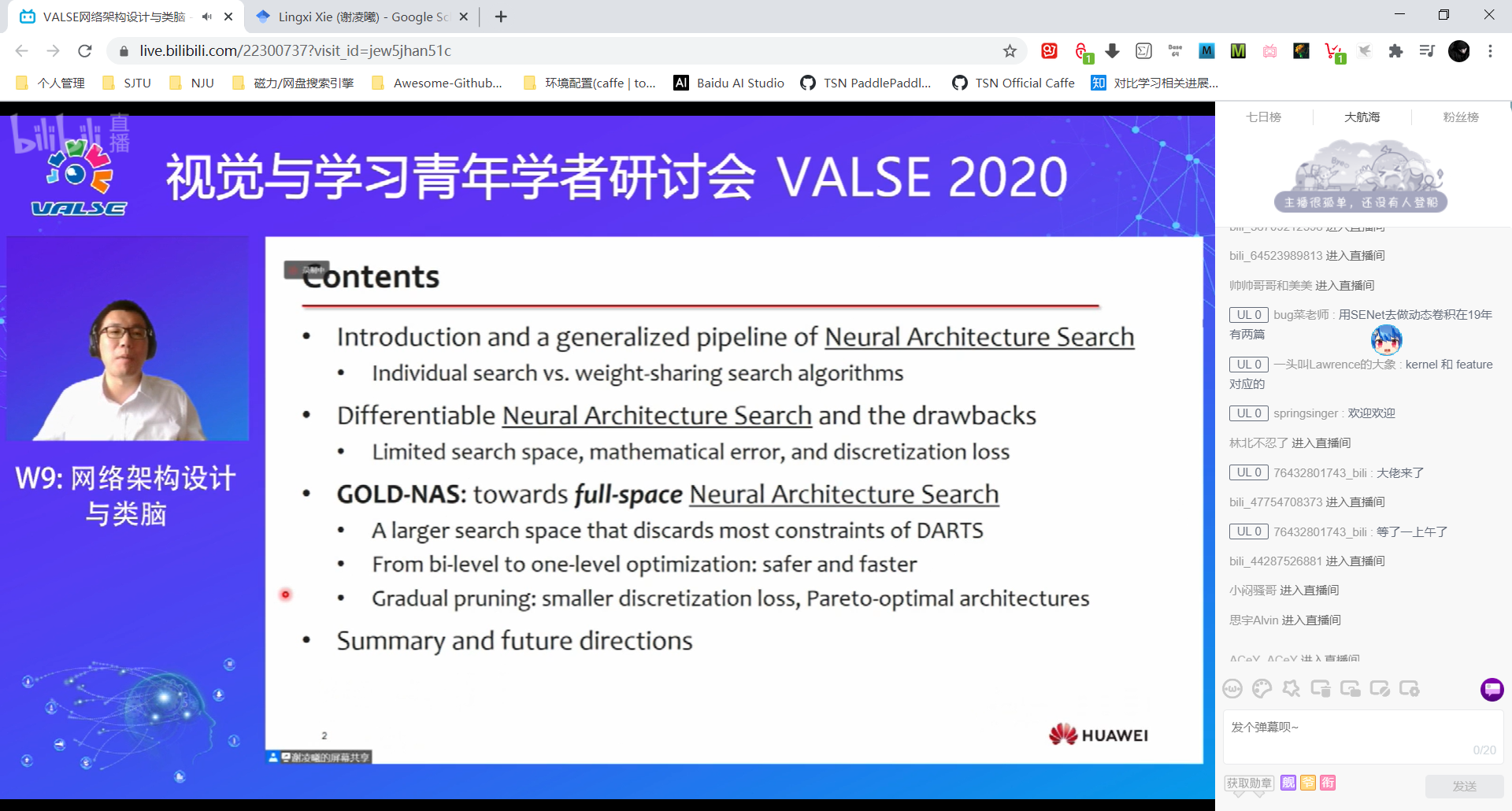

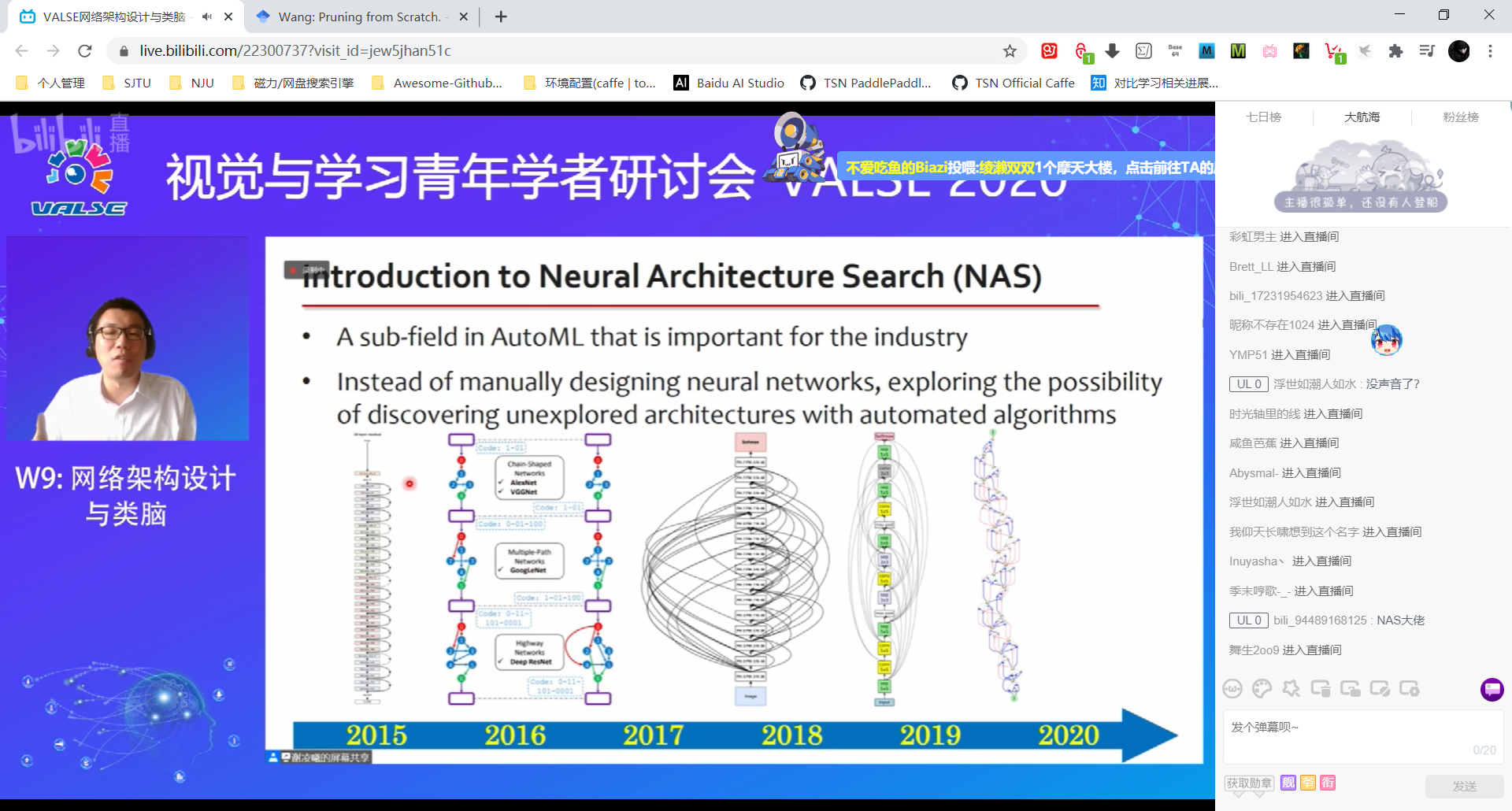

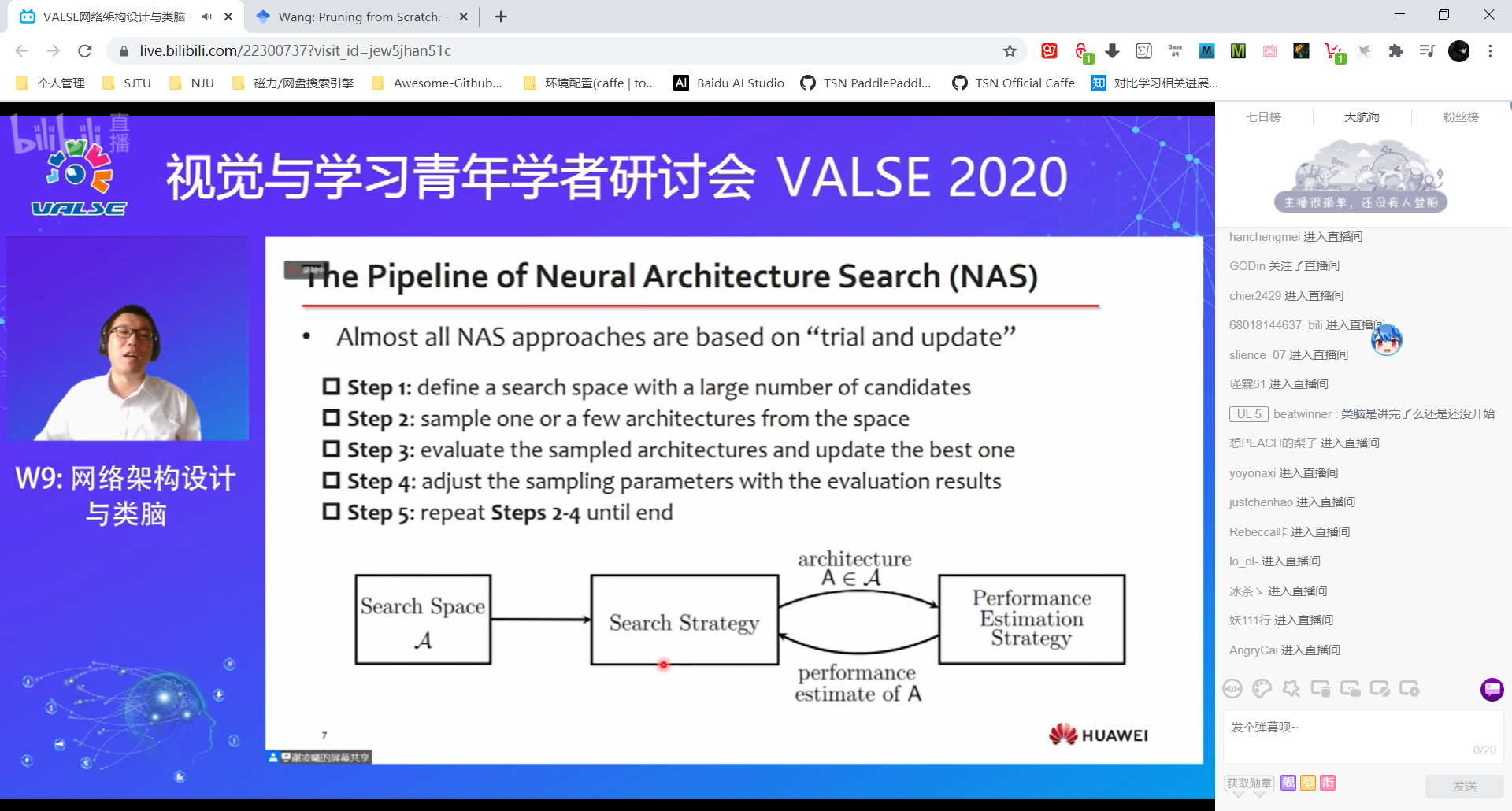

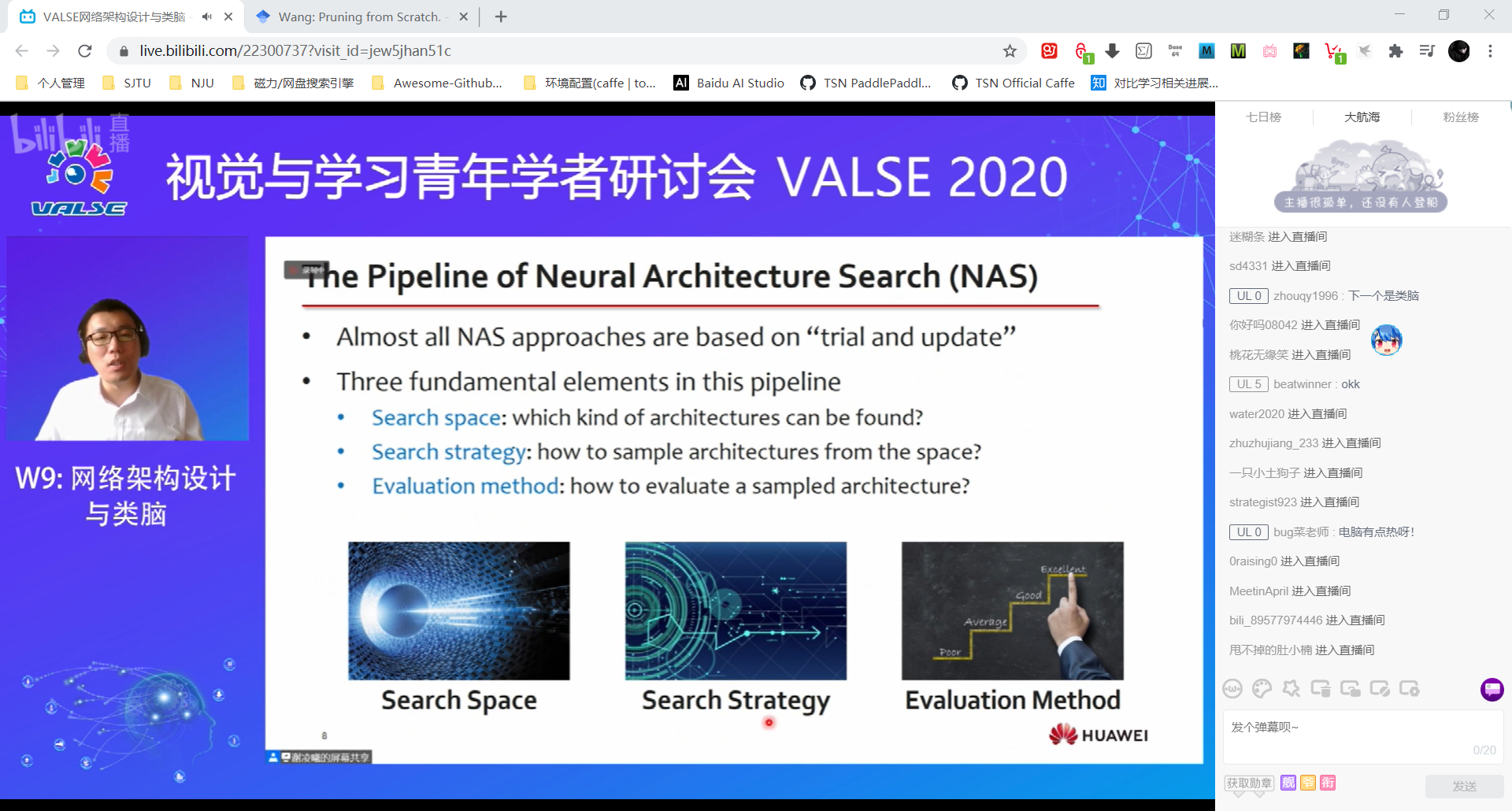

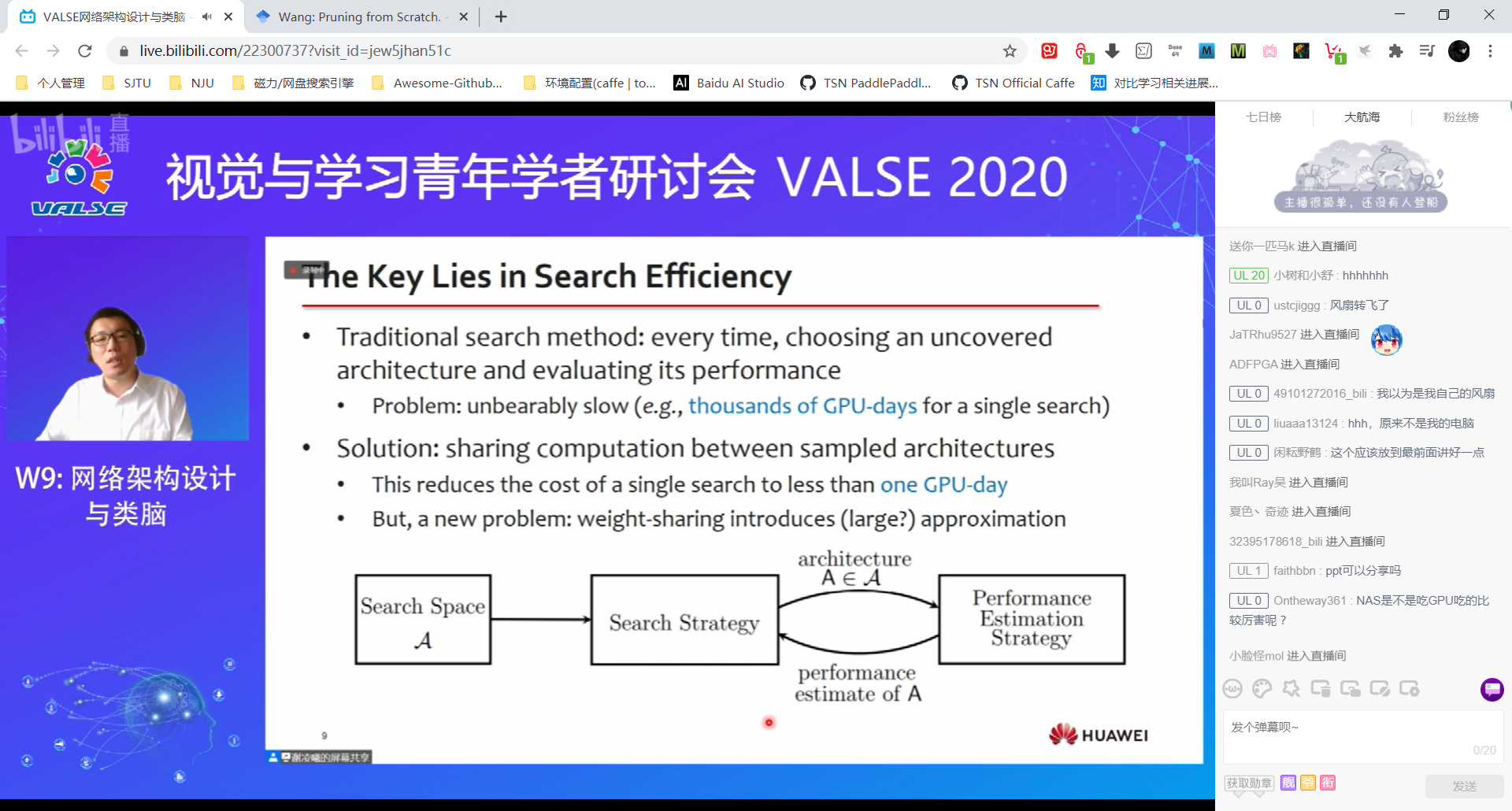

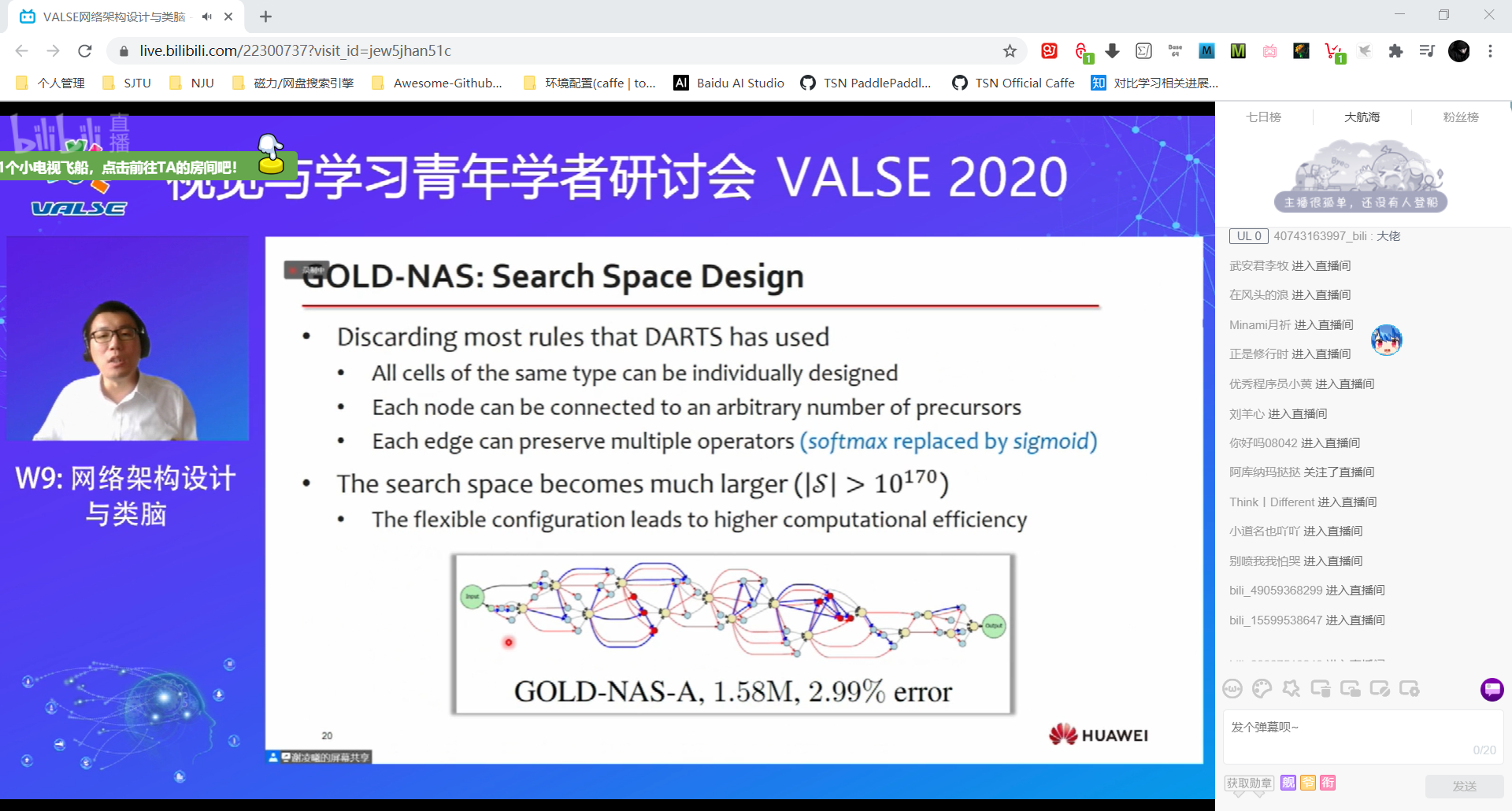

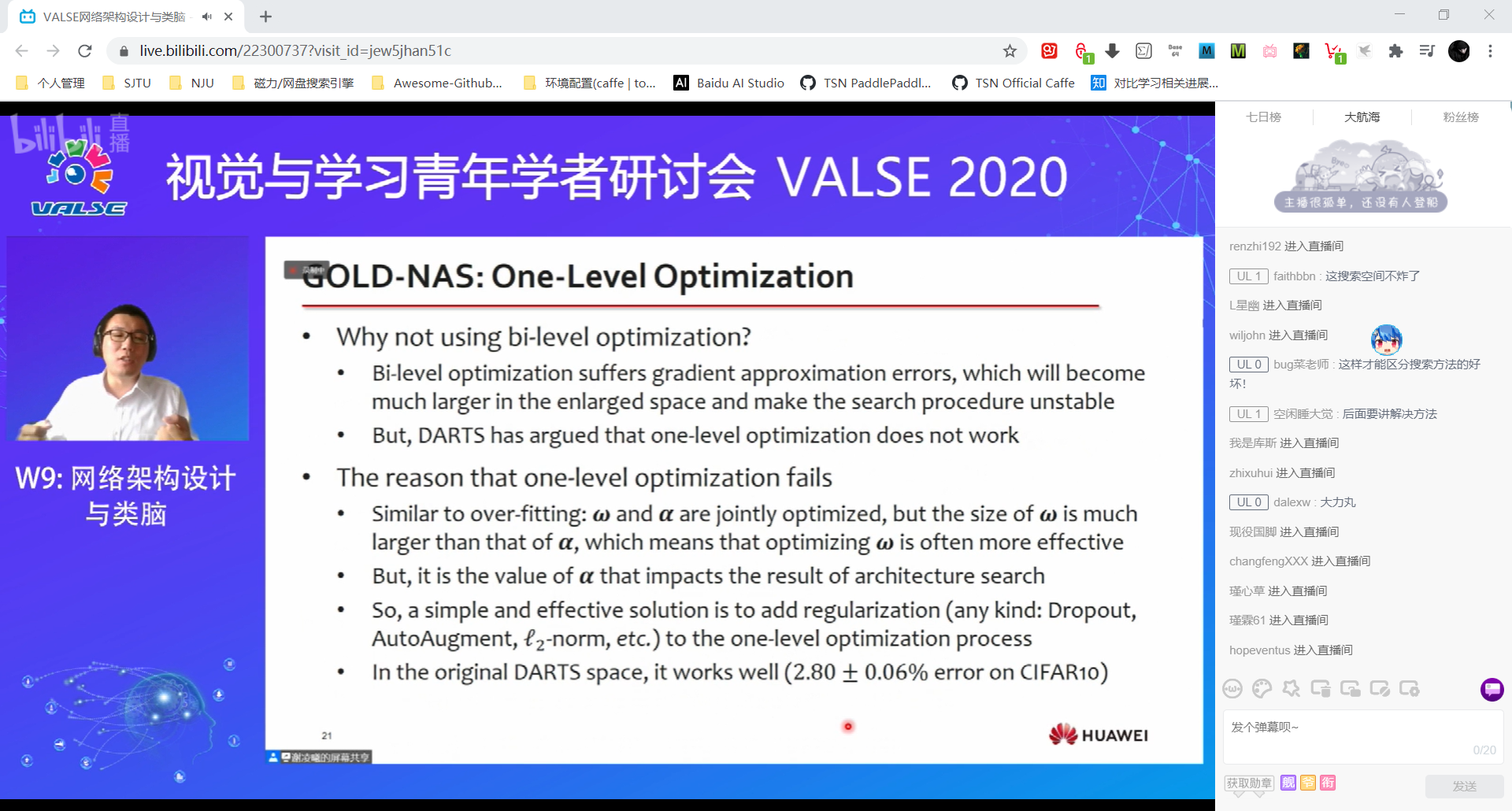

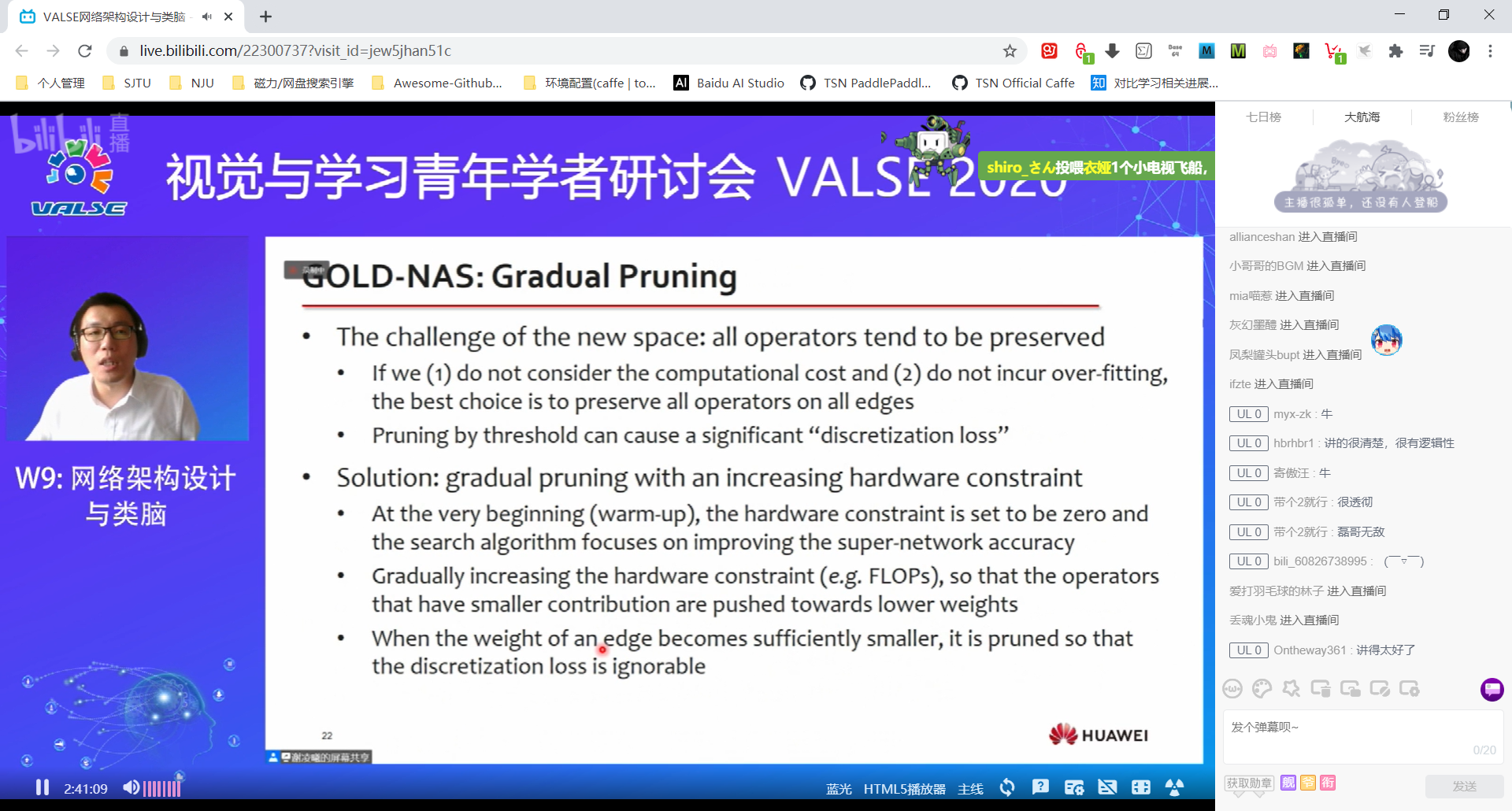

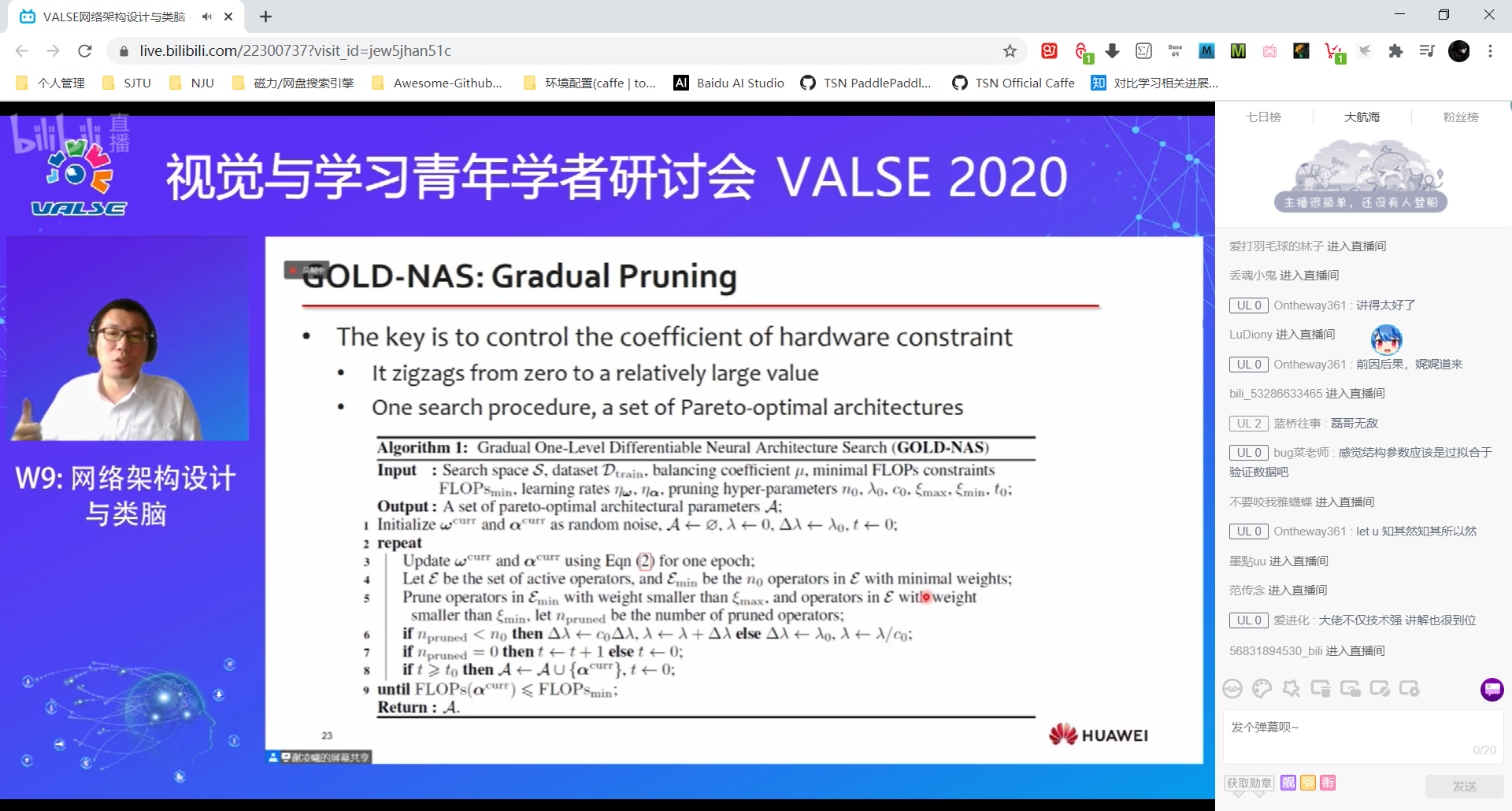

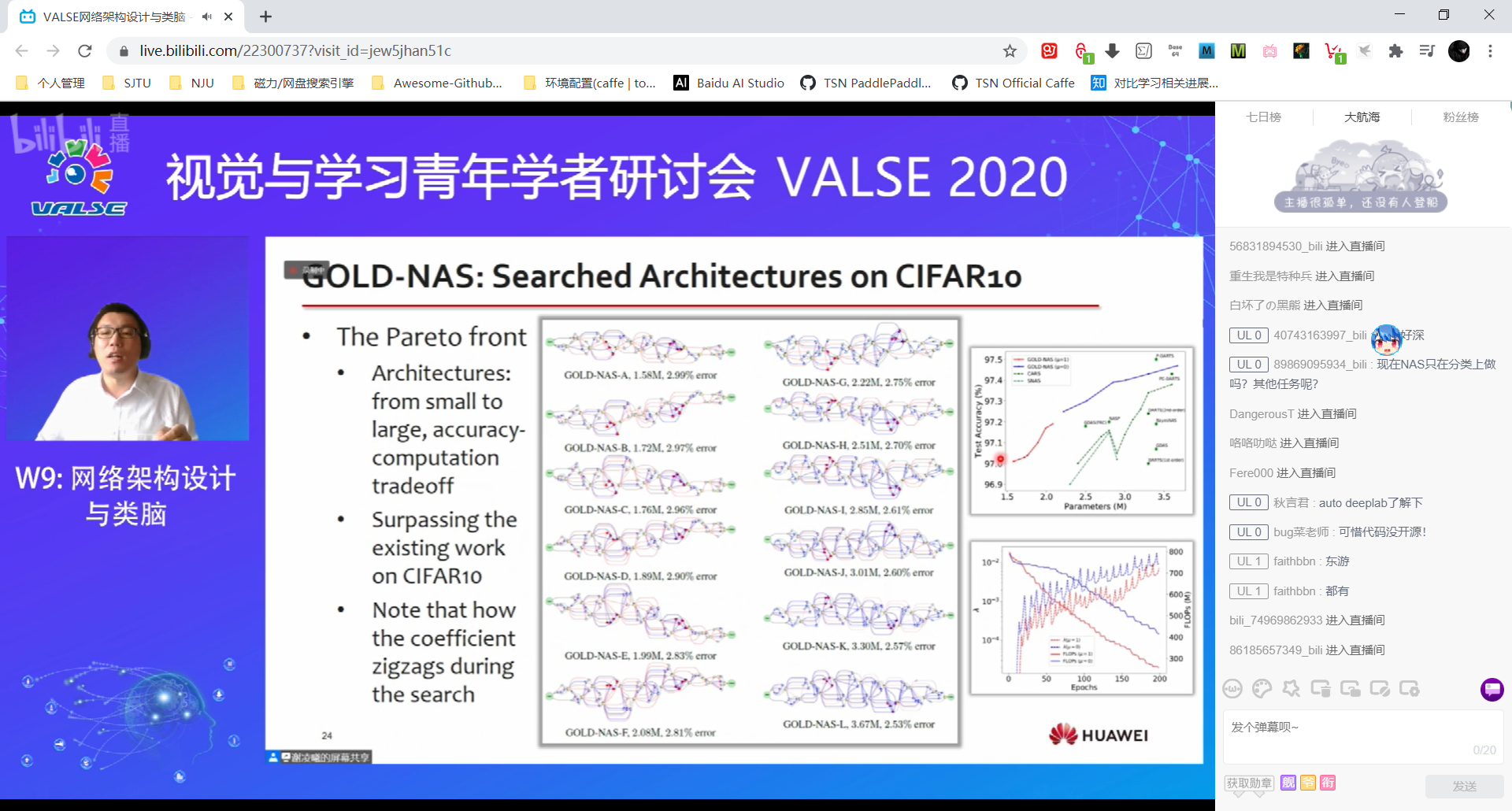

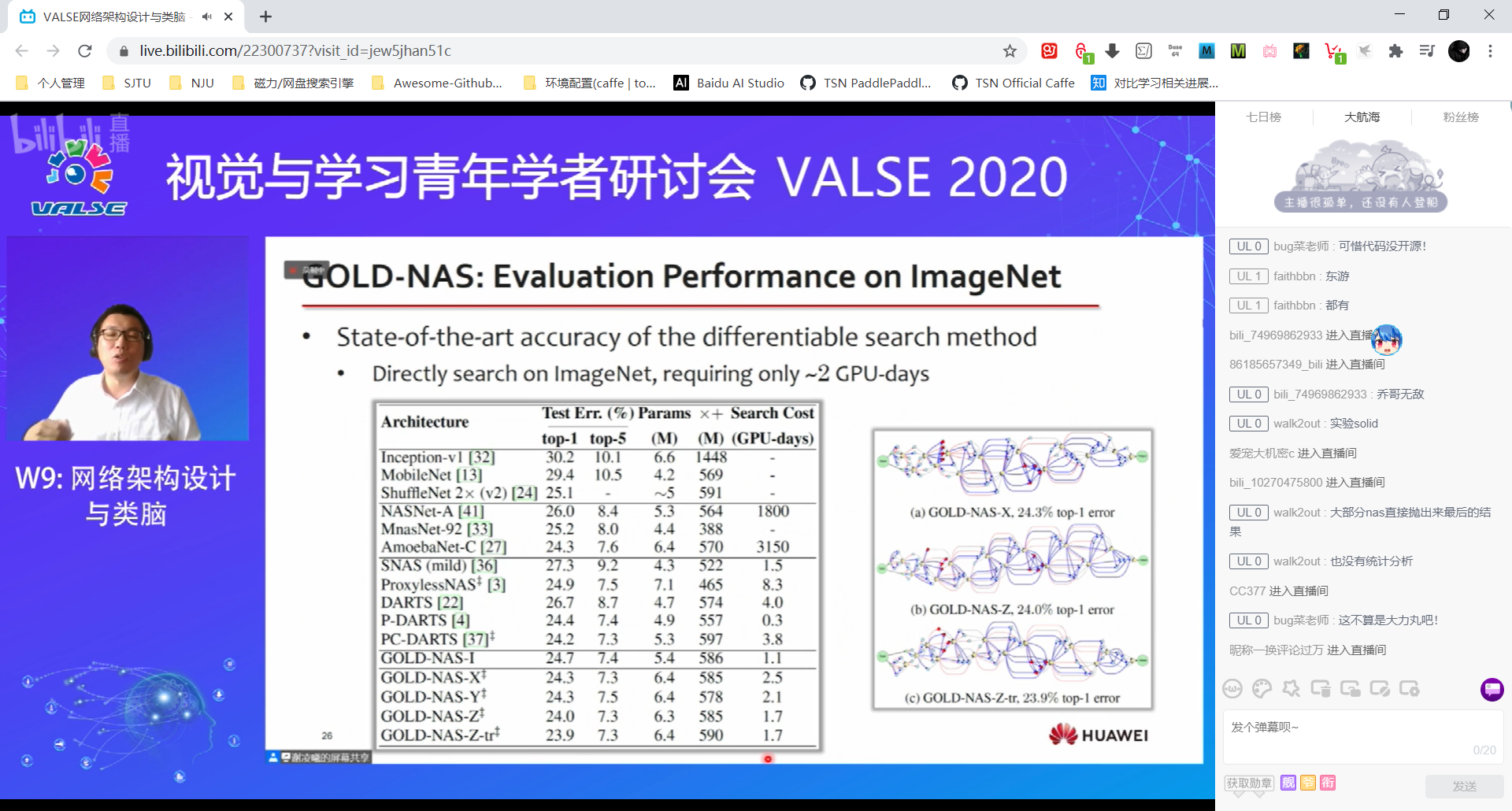

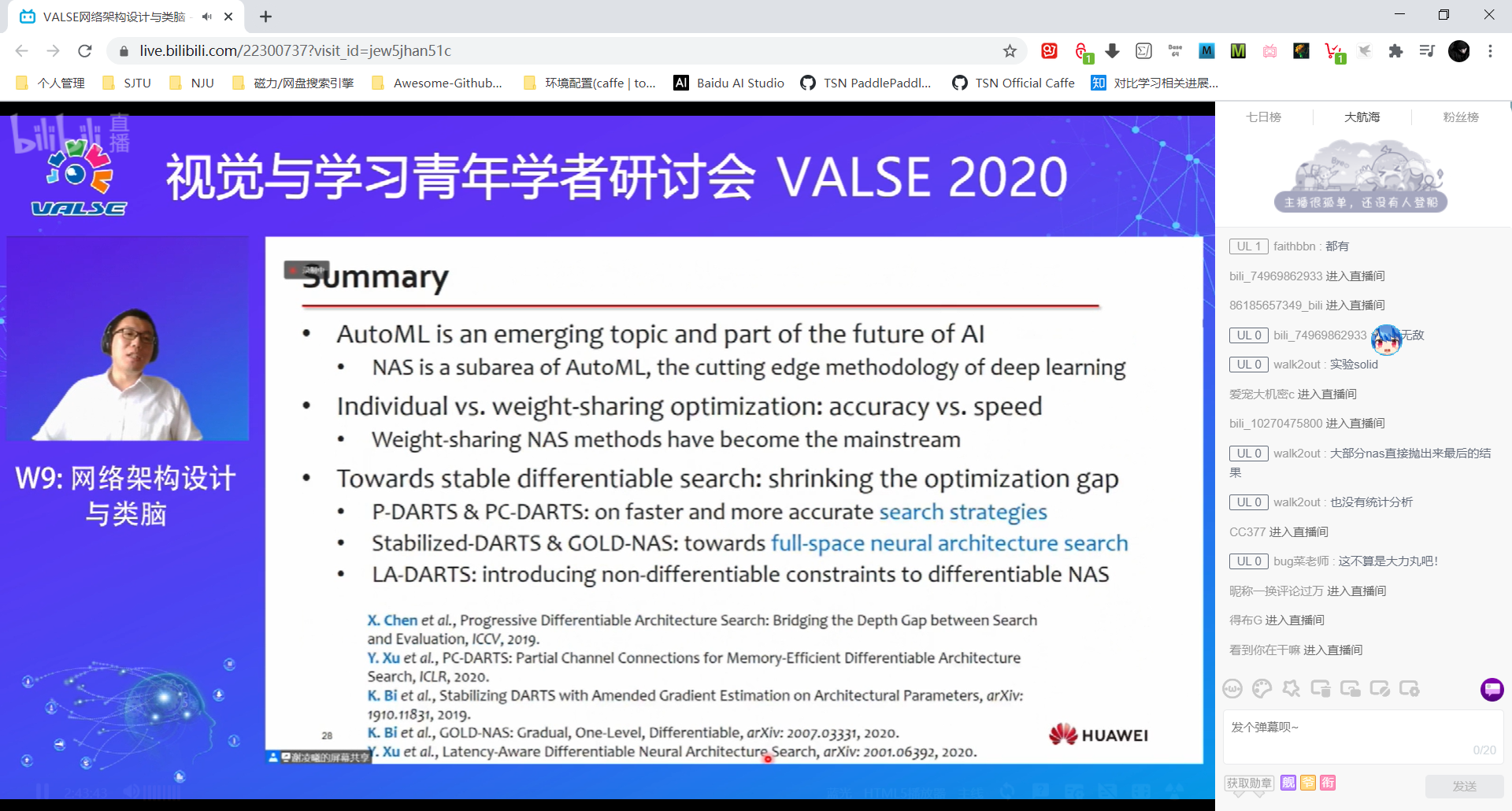

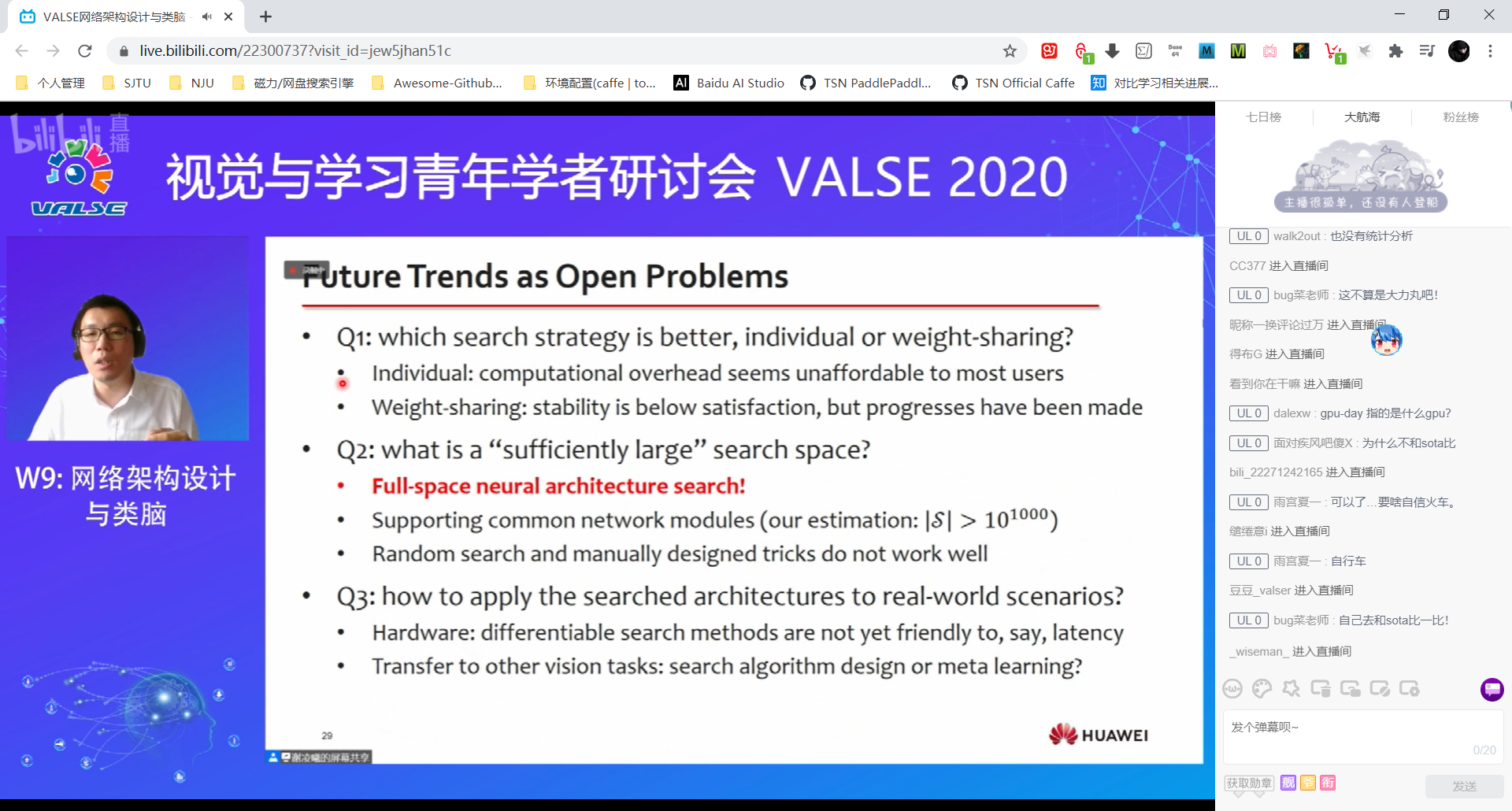

4. Full-space Neural Architecture Search (Using GOLD-NAS)

【时间】10:50-11:20

【讲者】谢凌曦(华为)

【题目】Full-space Neural Architecture Search

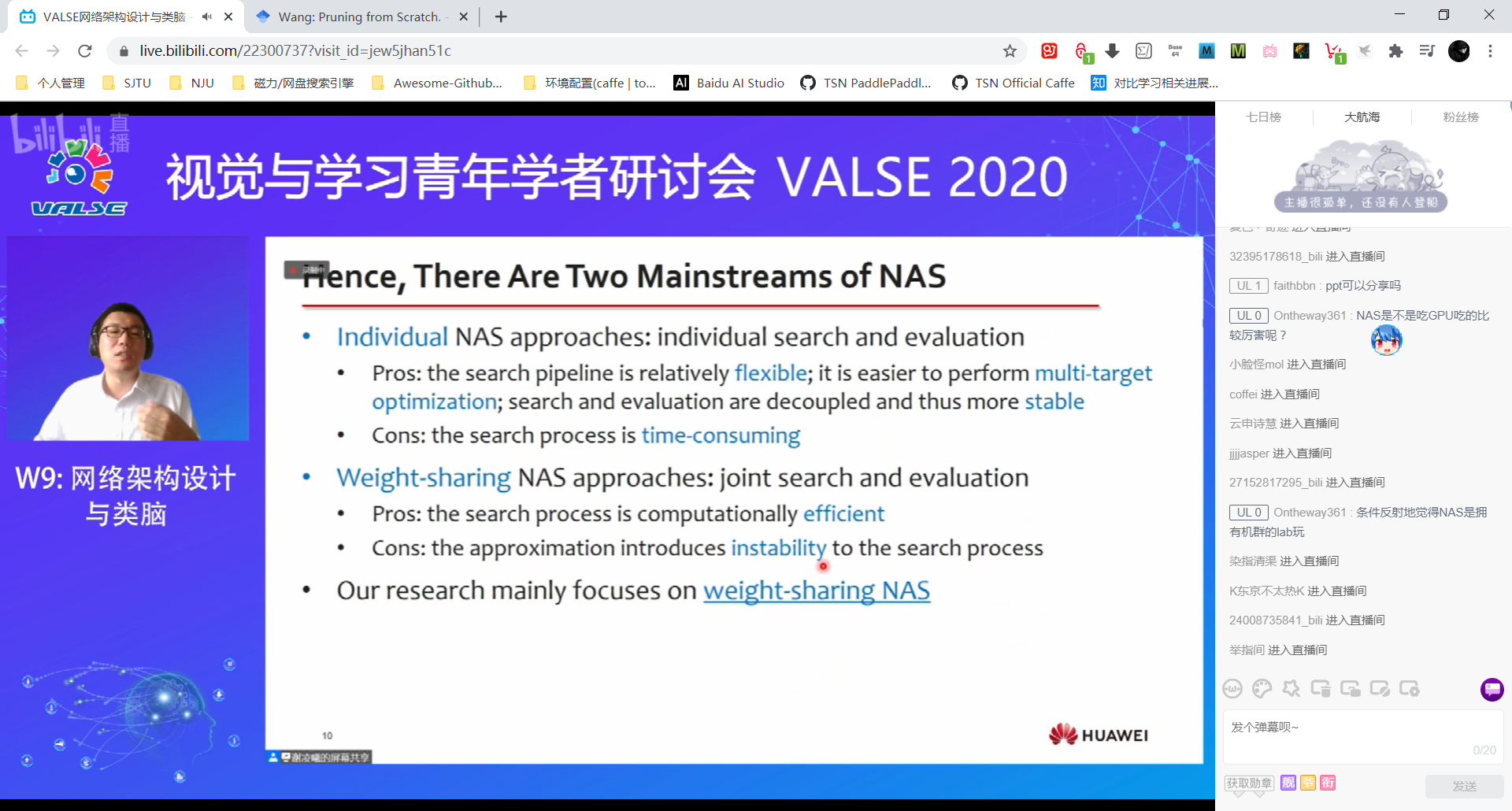

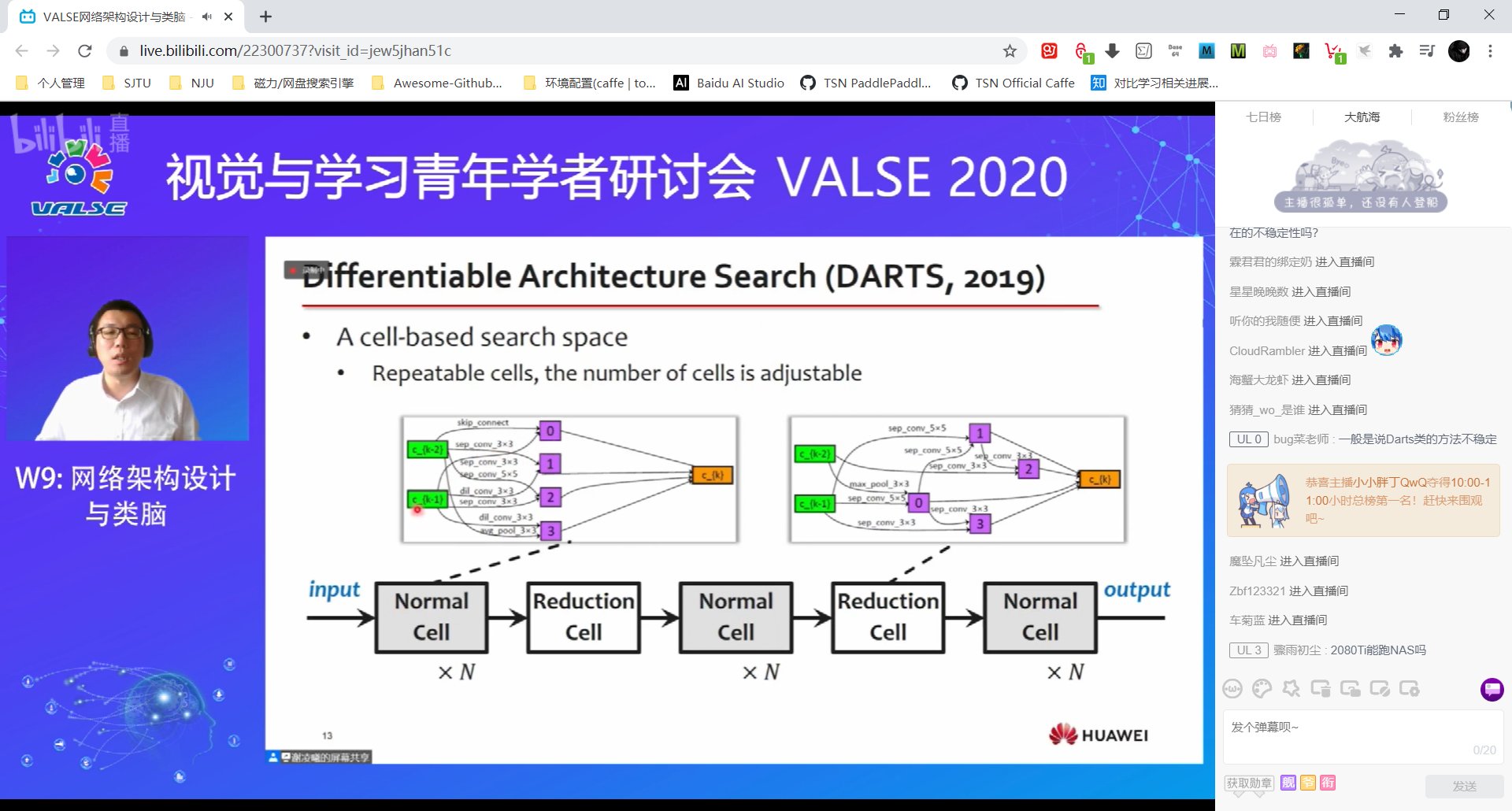

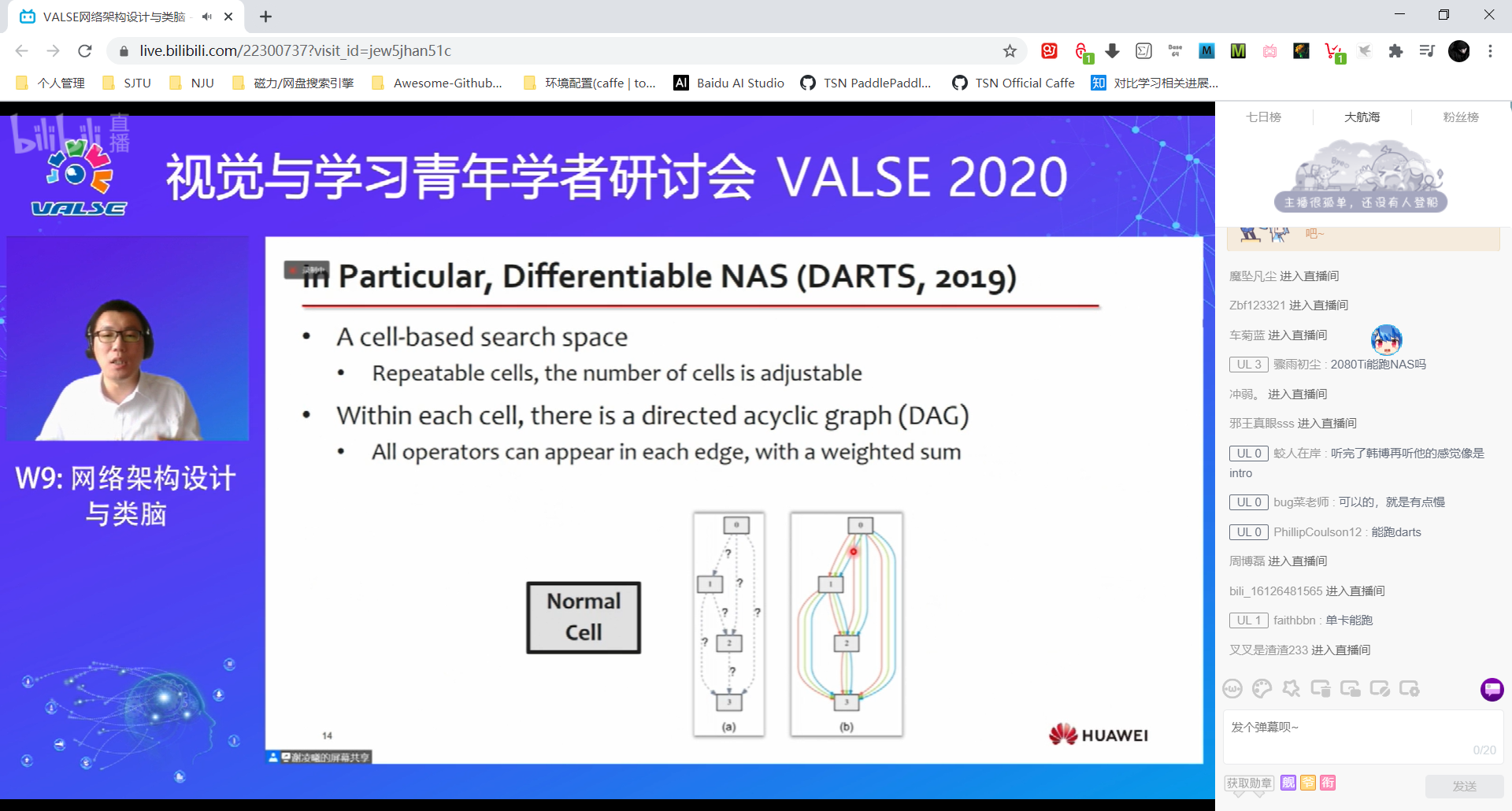

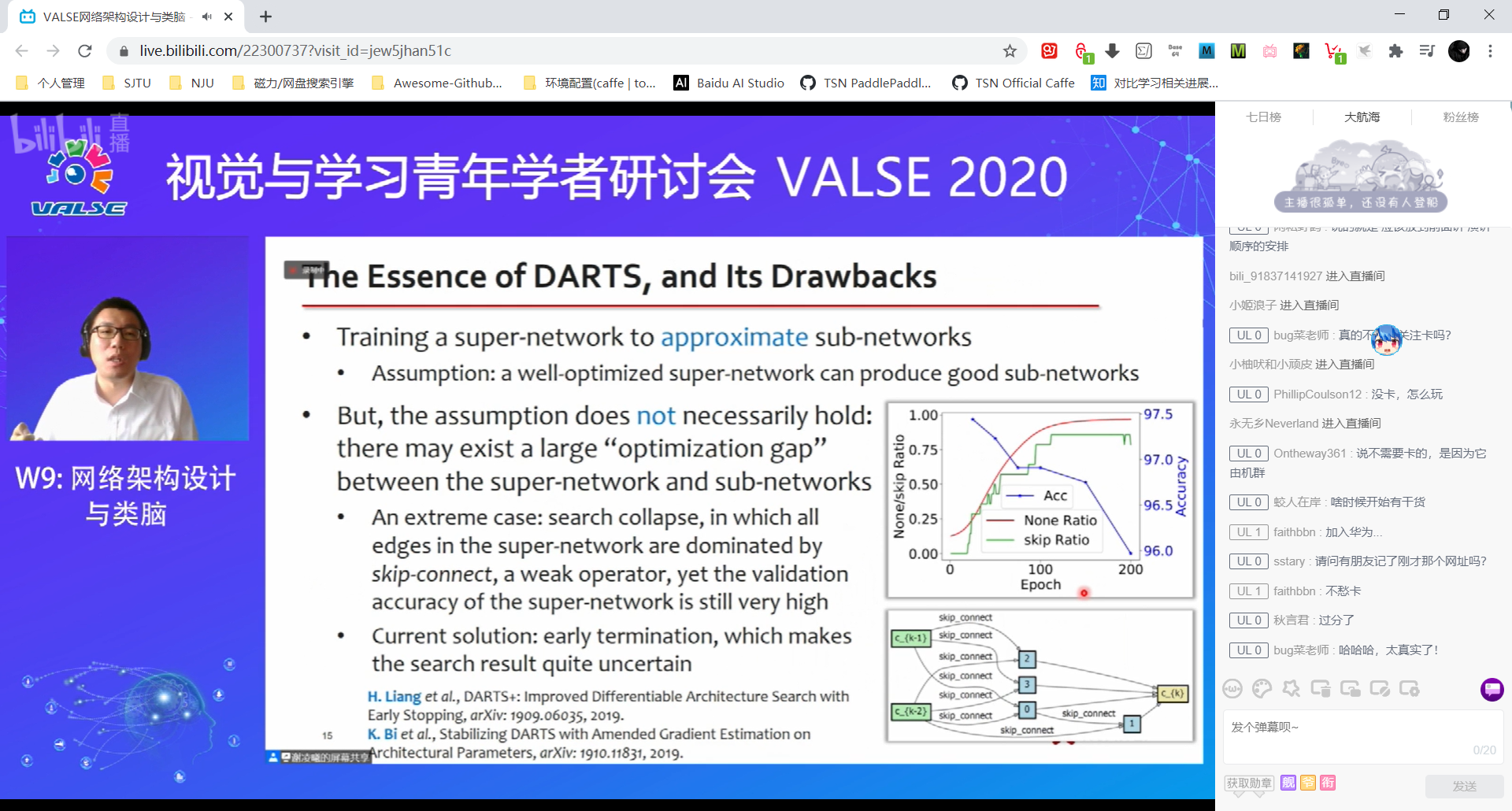

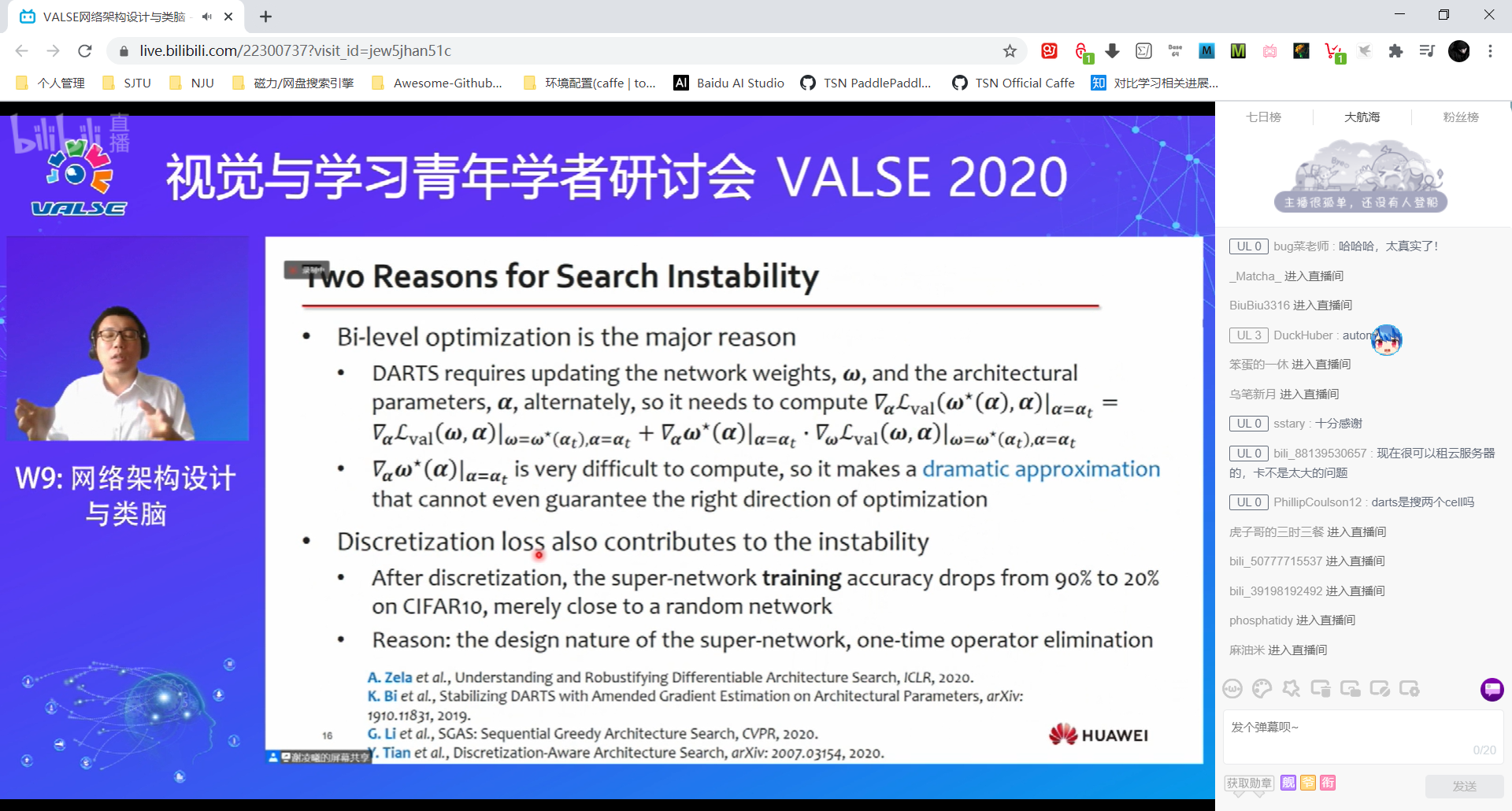

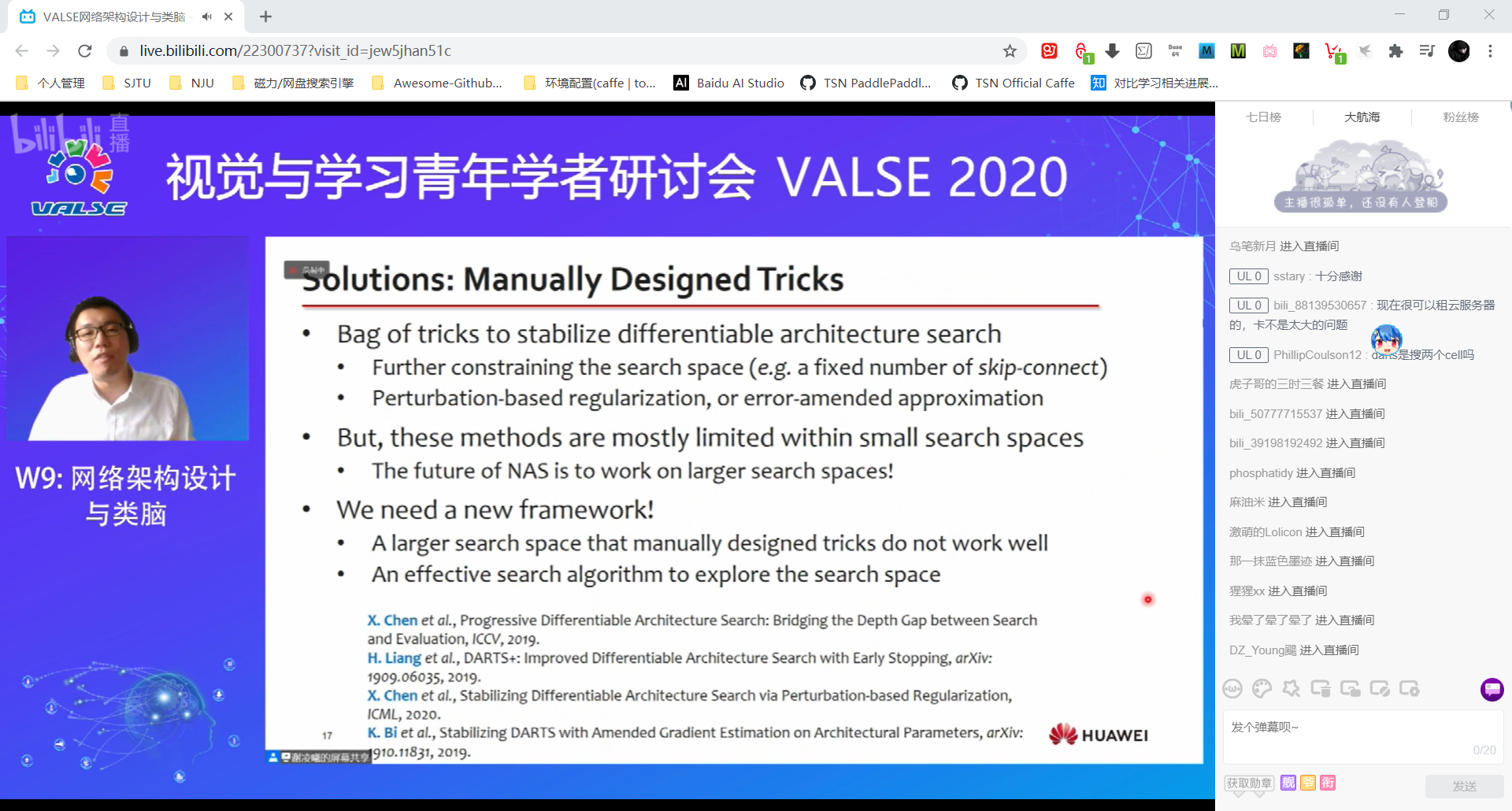

4.1 可微分NAS

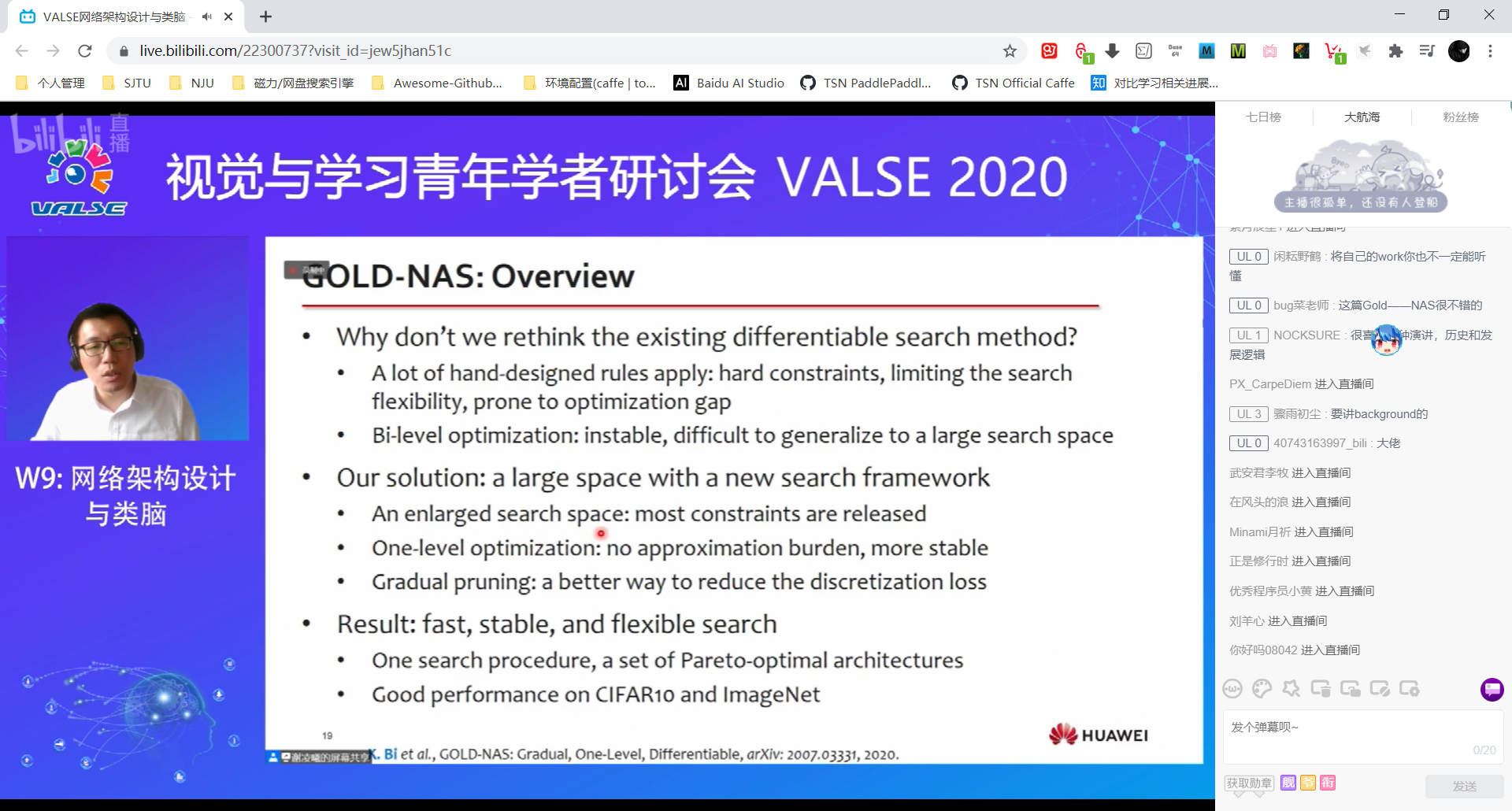

4.2 GOLD-NAS

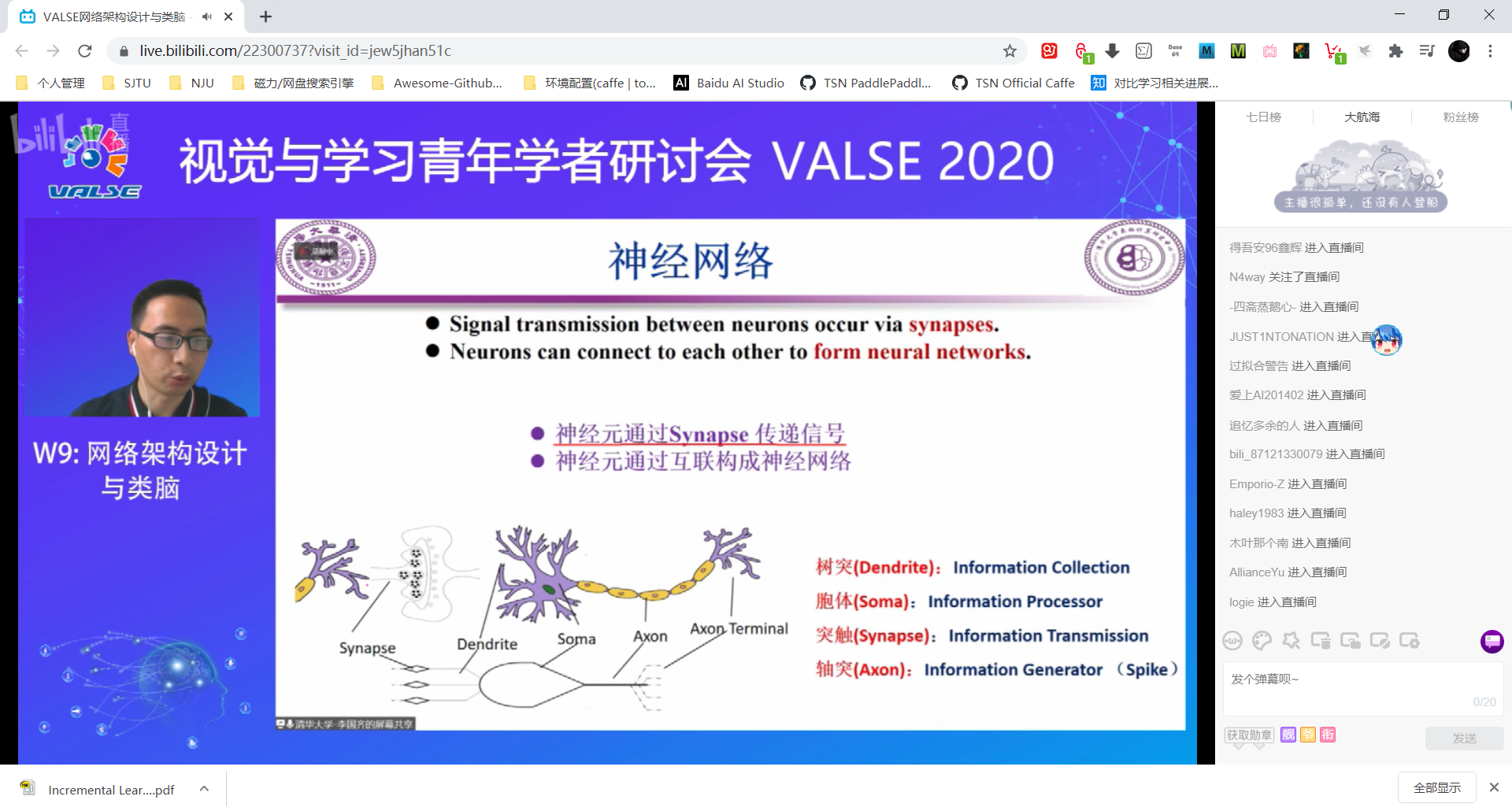

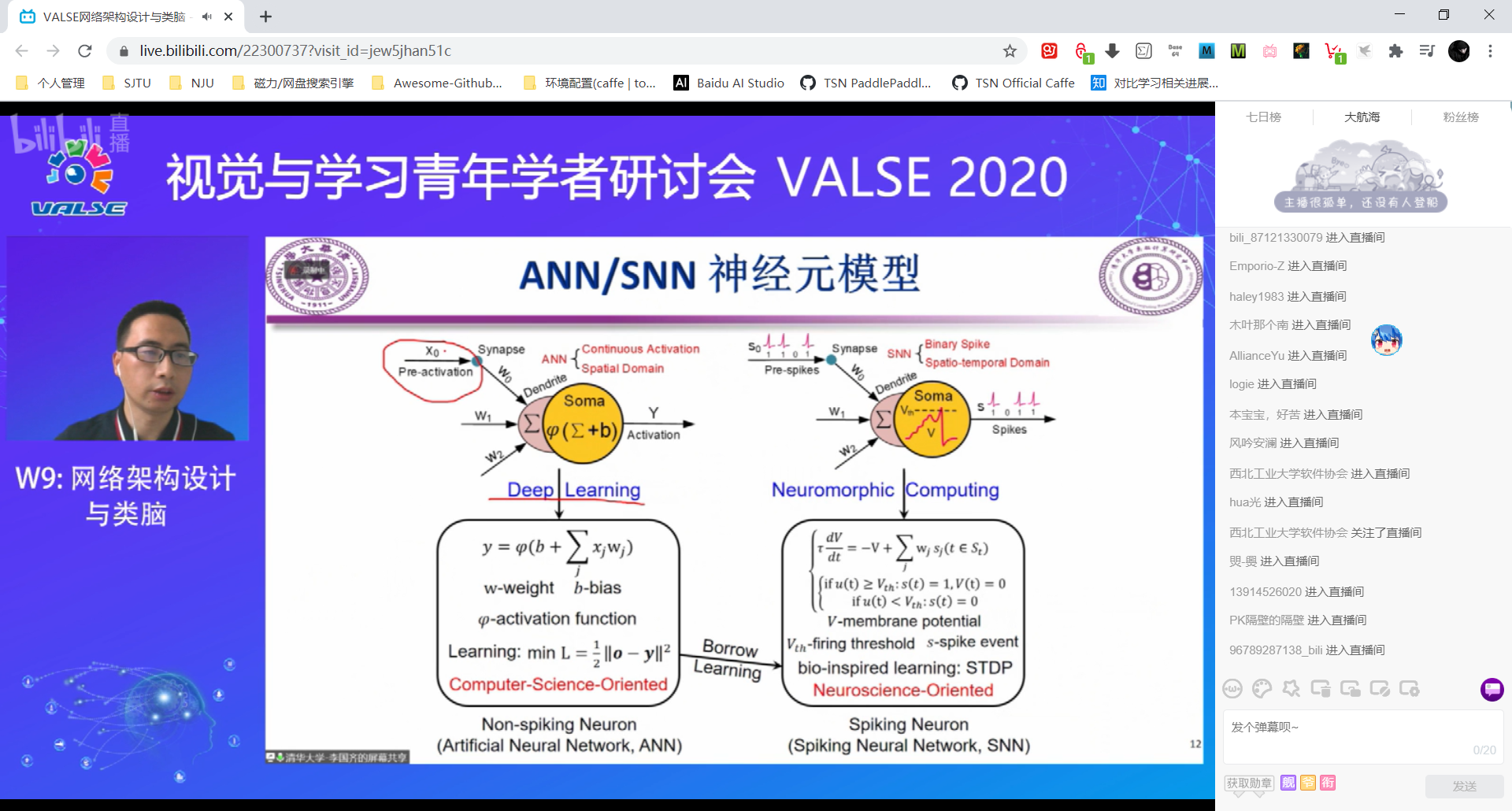

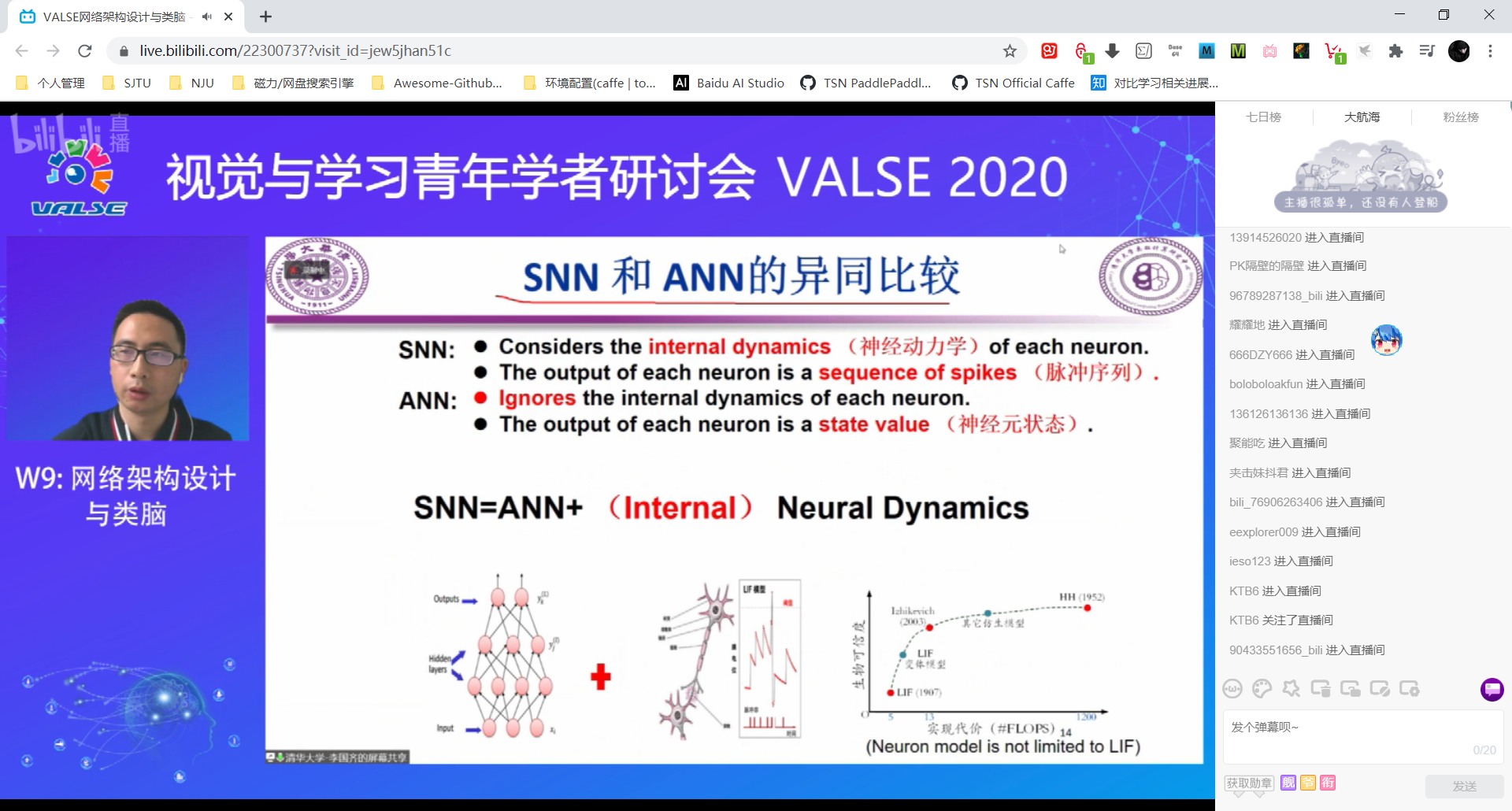

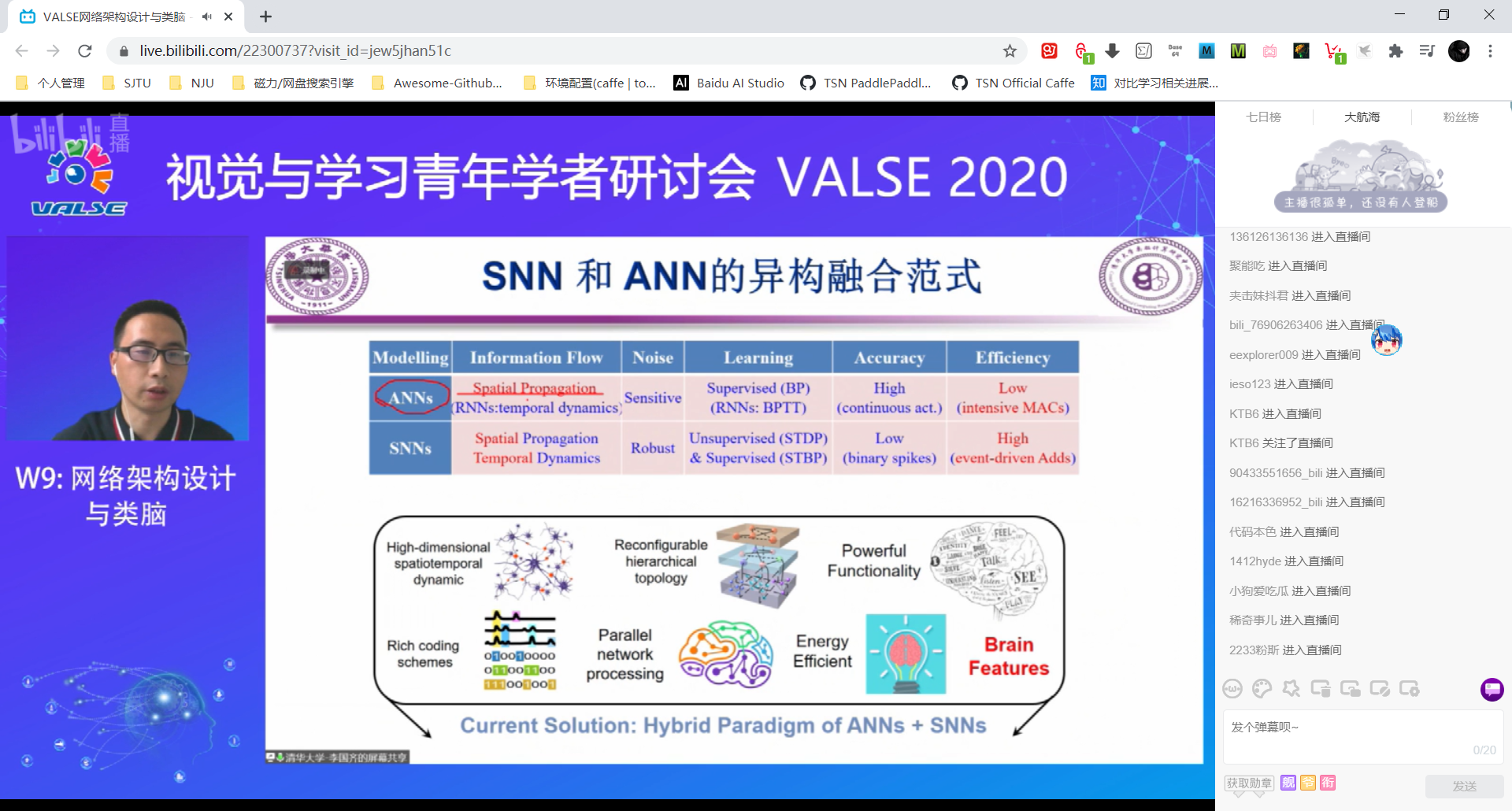

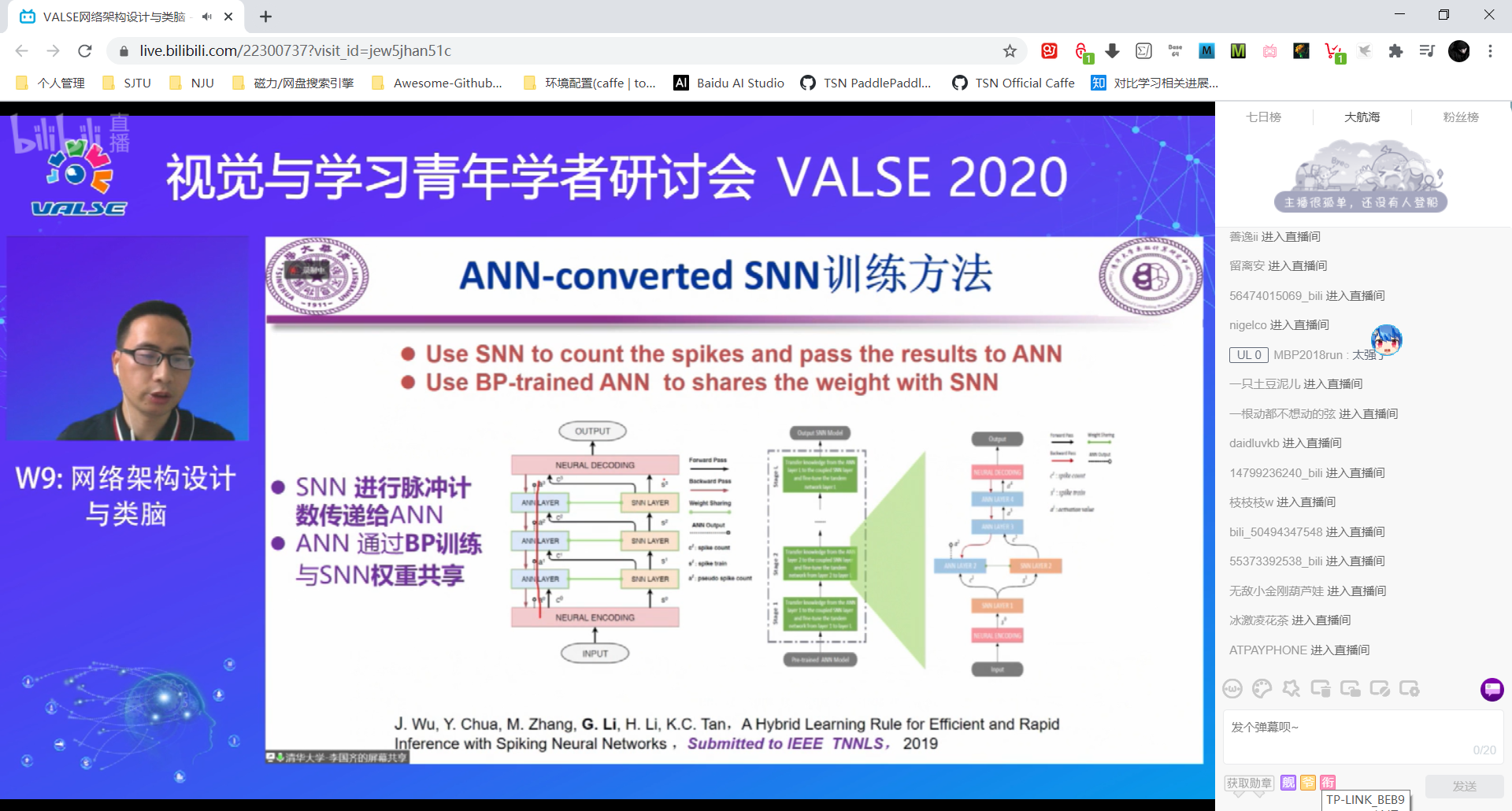

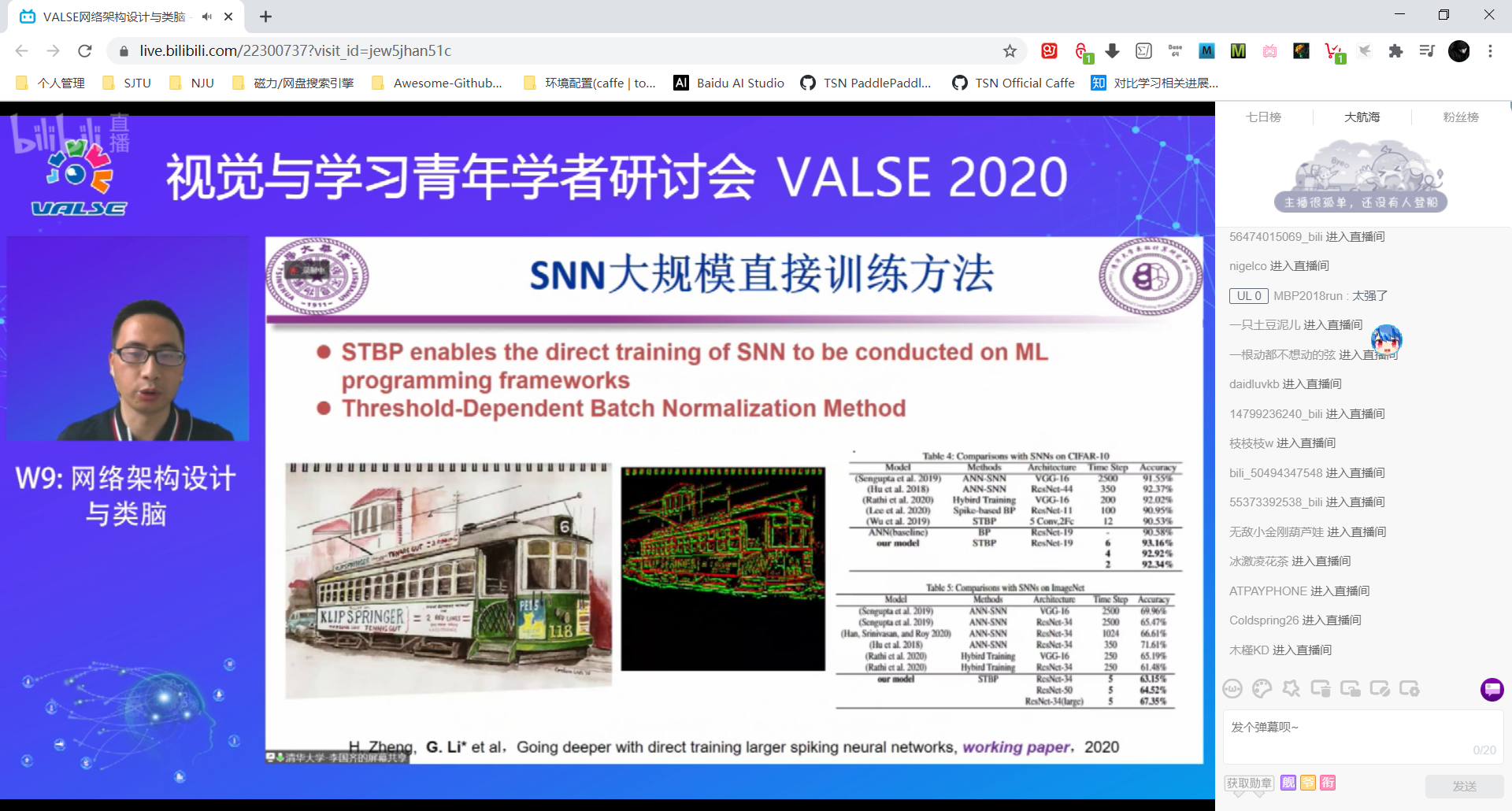

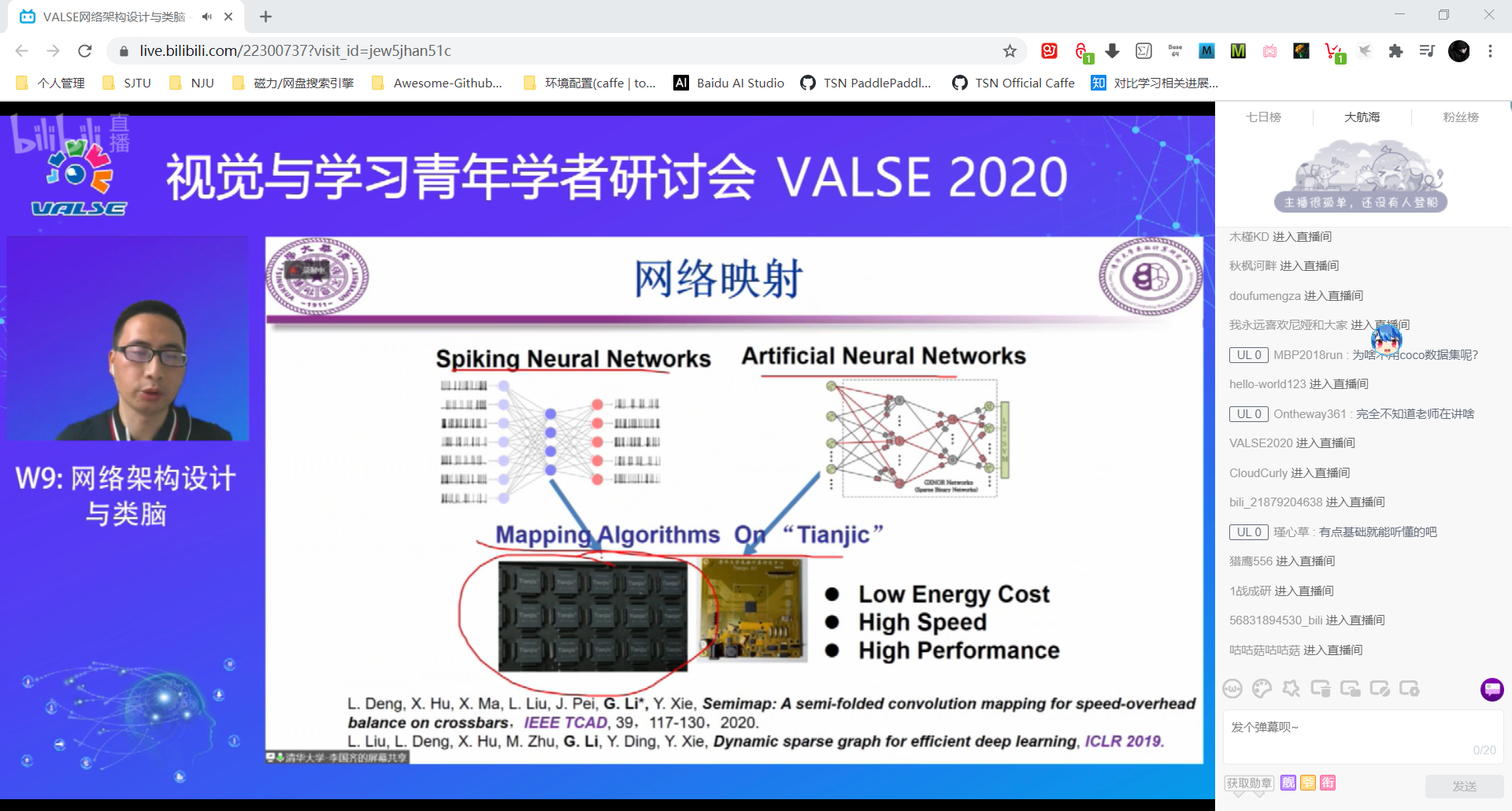

5. Brain Inspired Computing with Hybrid Artificial and Spiking Neural Networks 基于异构融合的类脑计算

【时间】11:20-11:50

【讲者】李国齐(清华大学)

【题目】Brain Inspired Computing with Hybrid Artificial and Spiking Neural Networks

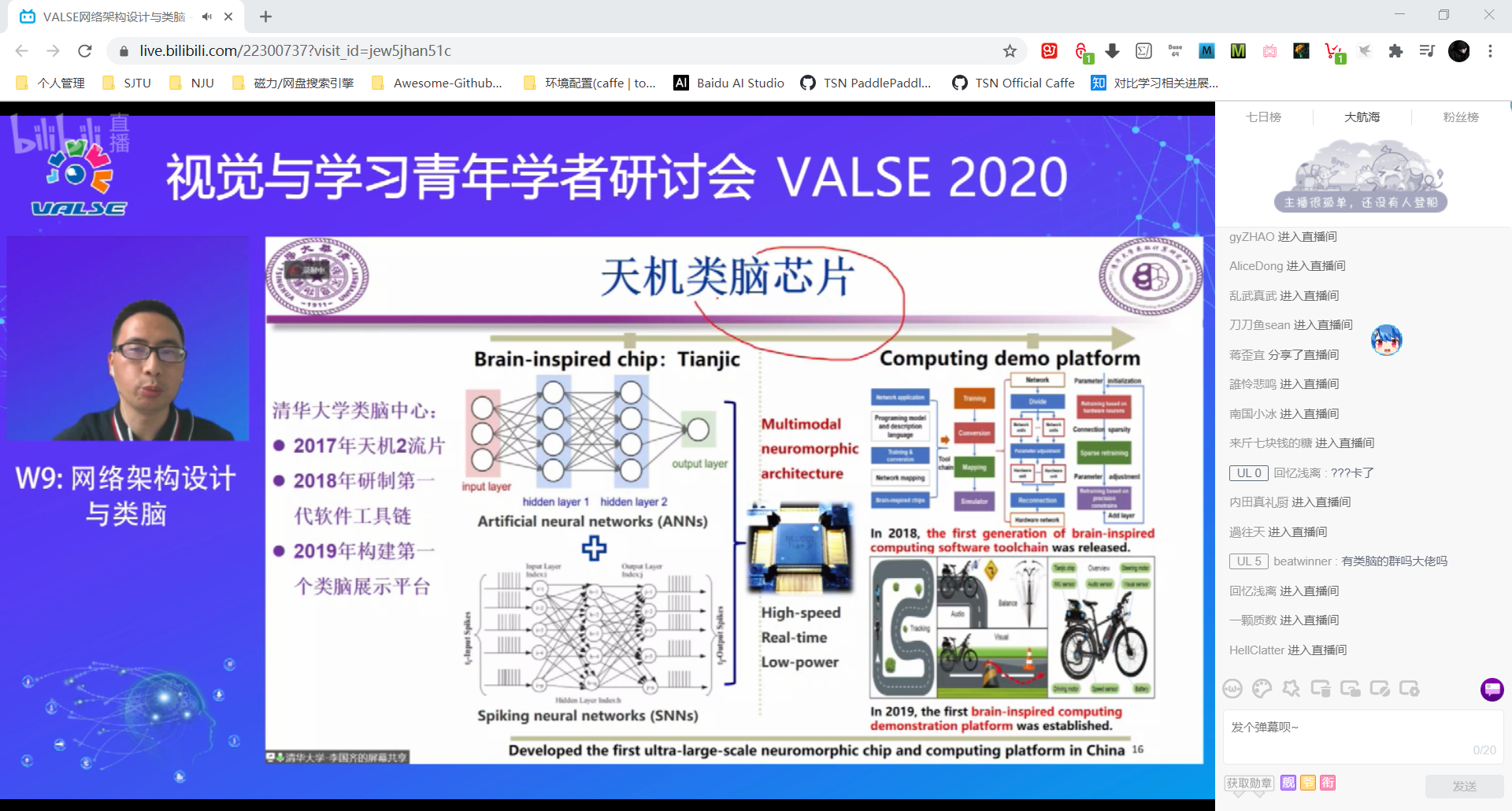

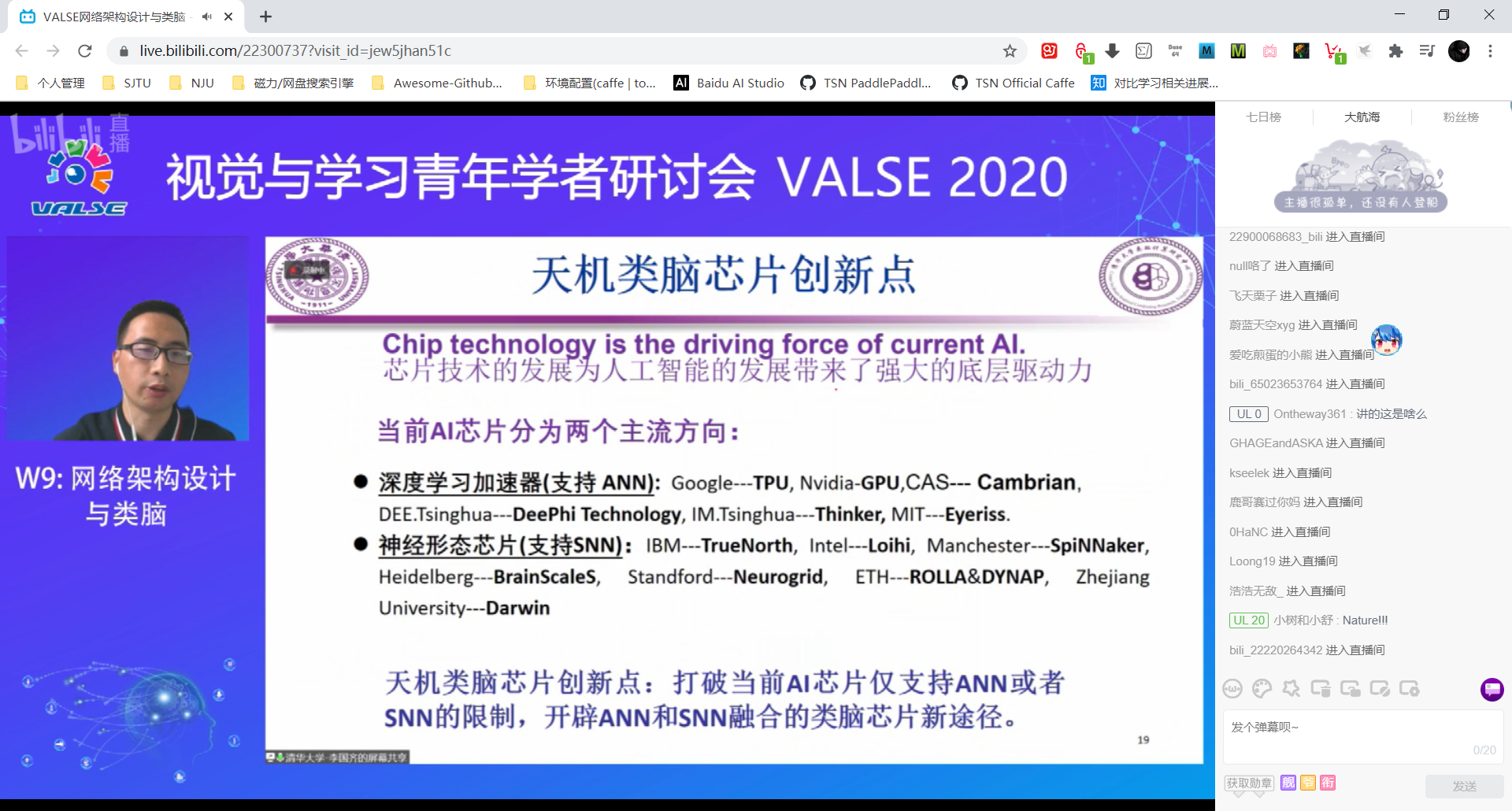

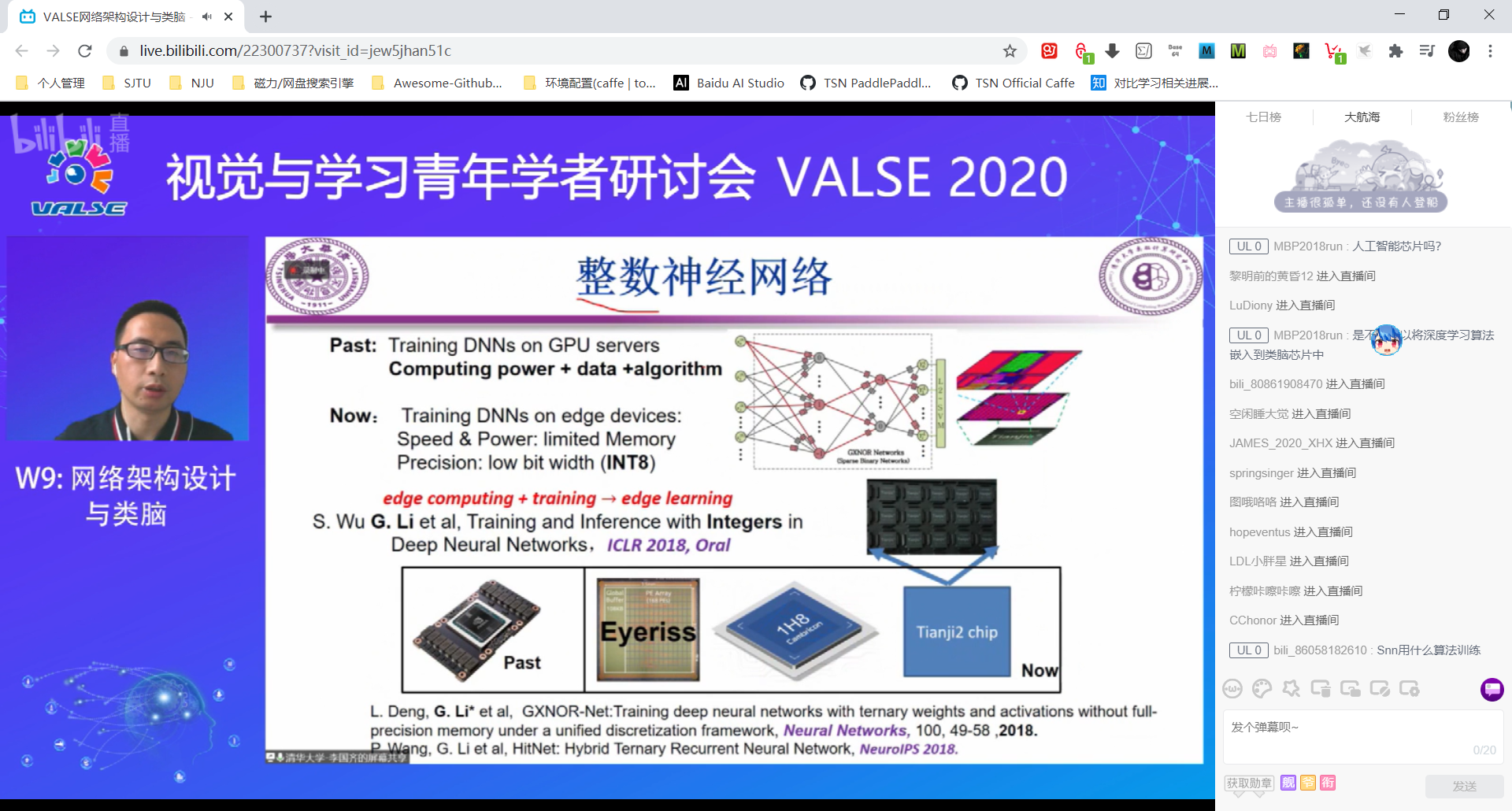

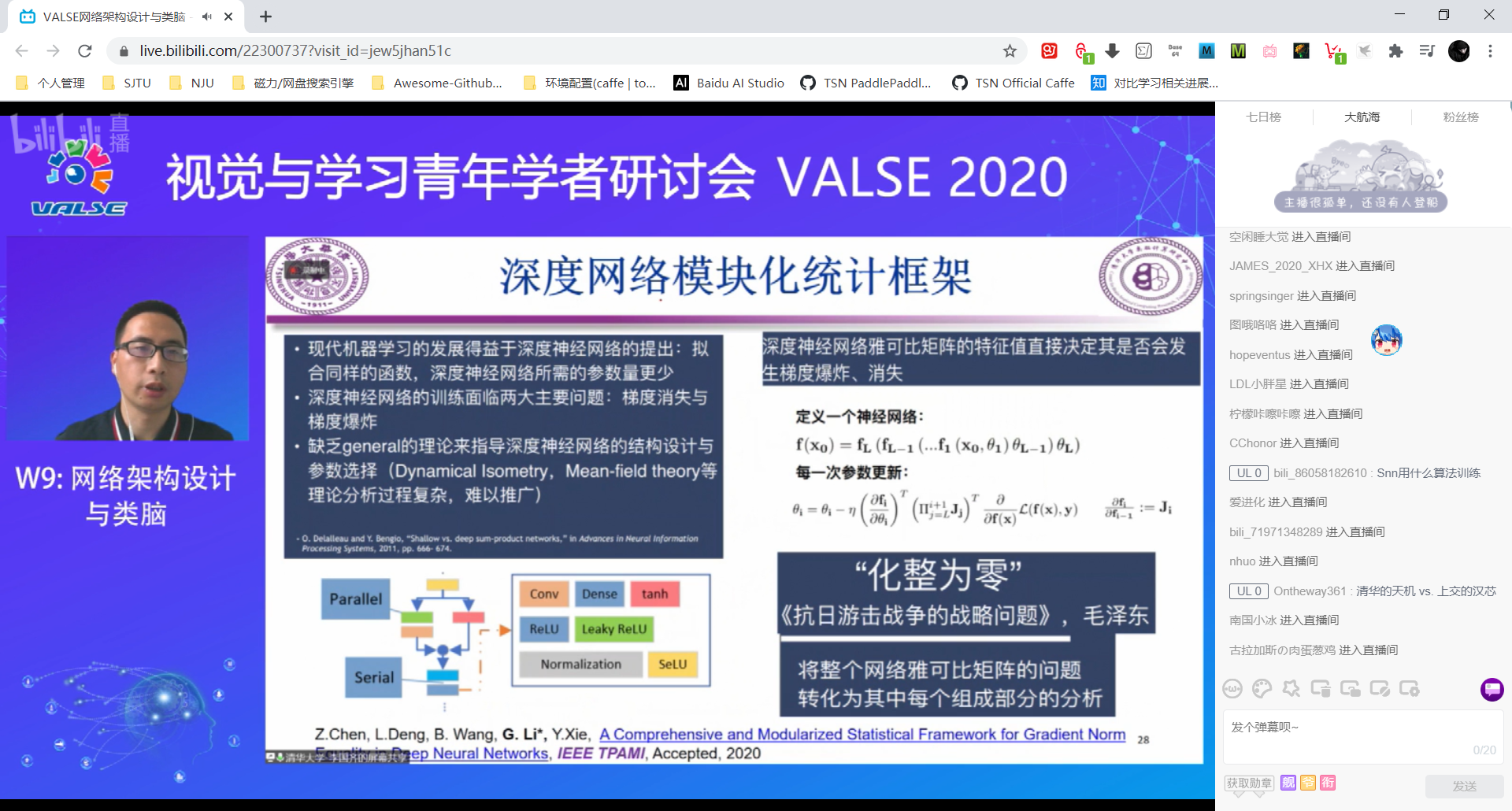

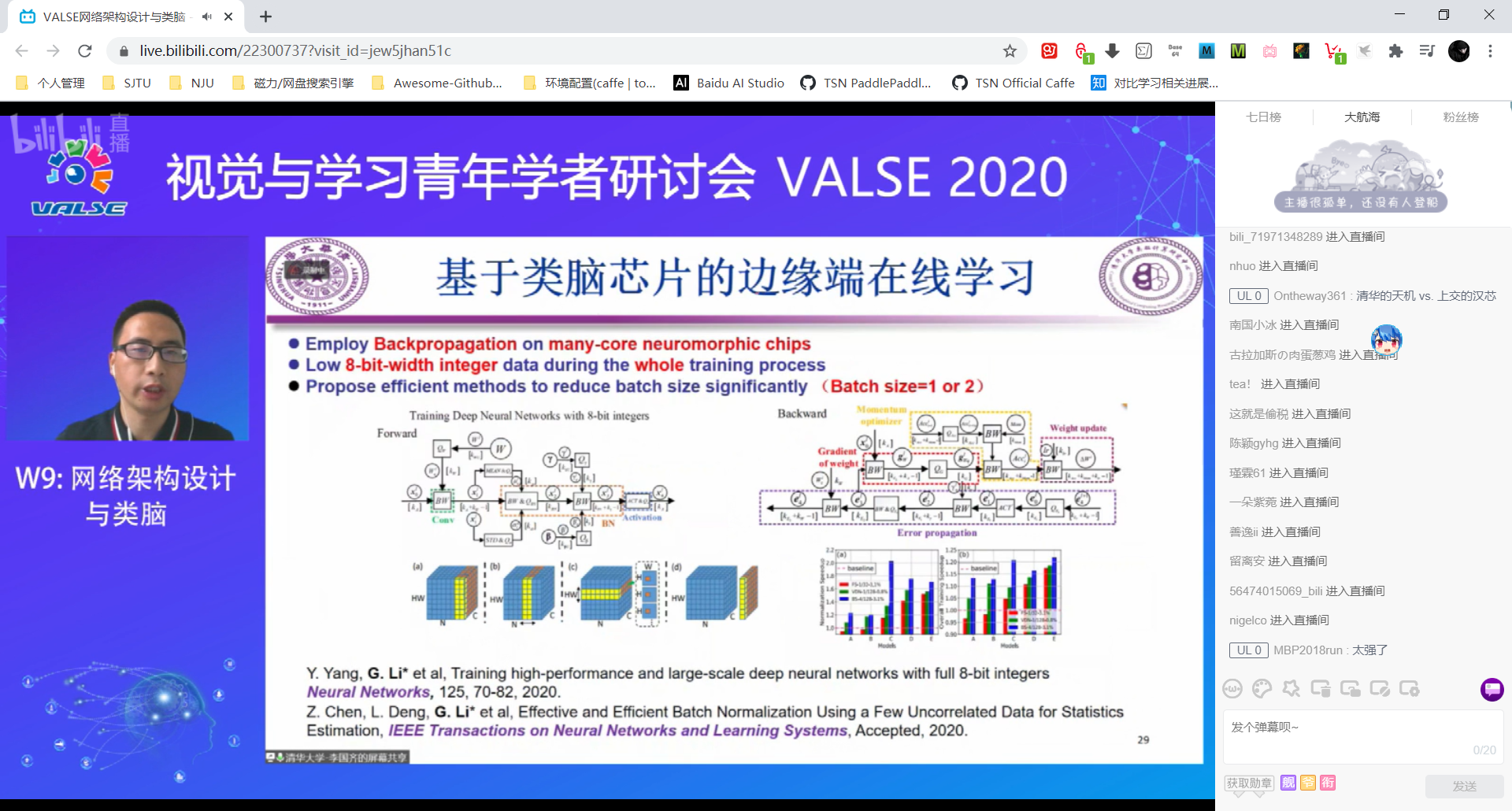

5.1 天机类脑芯片

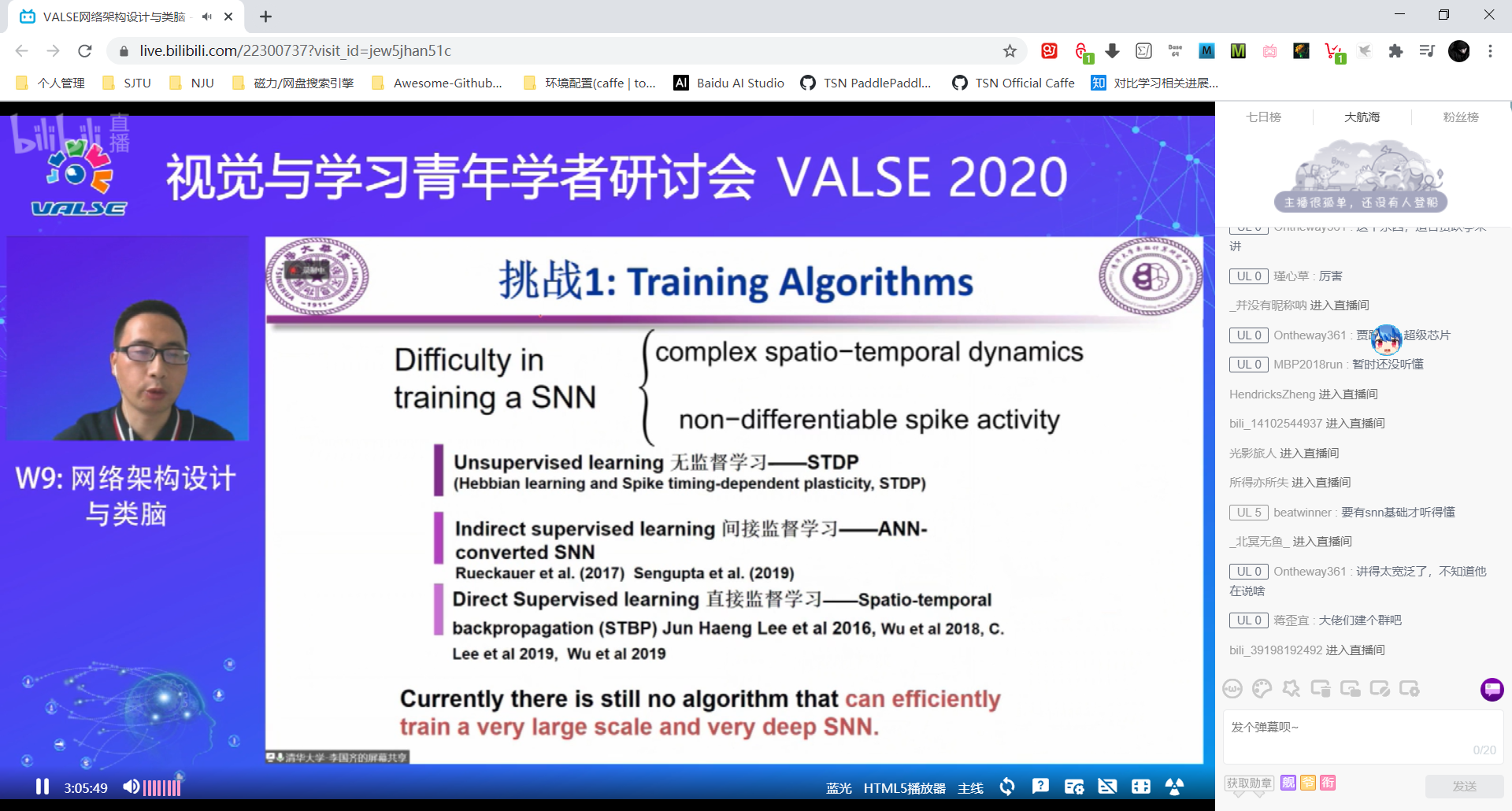

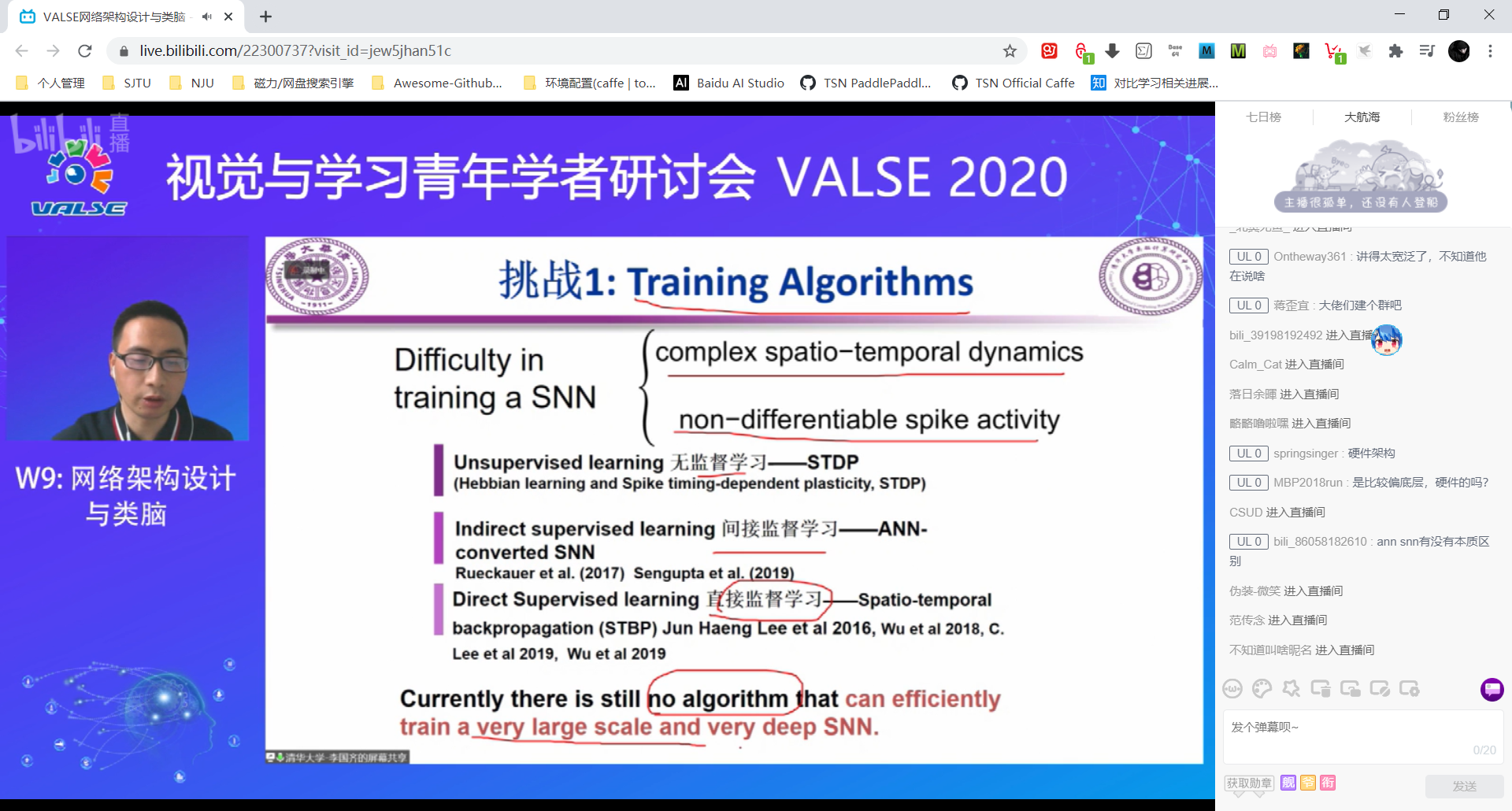

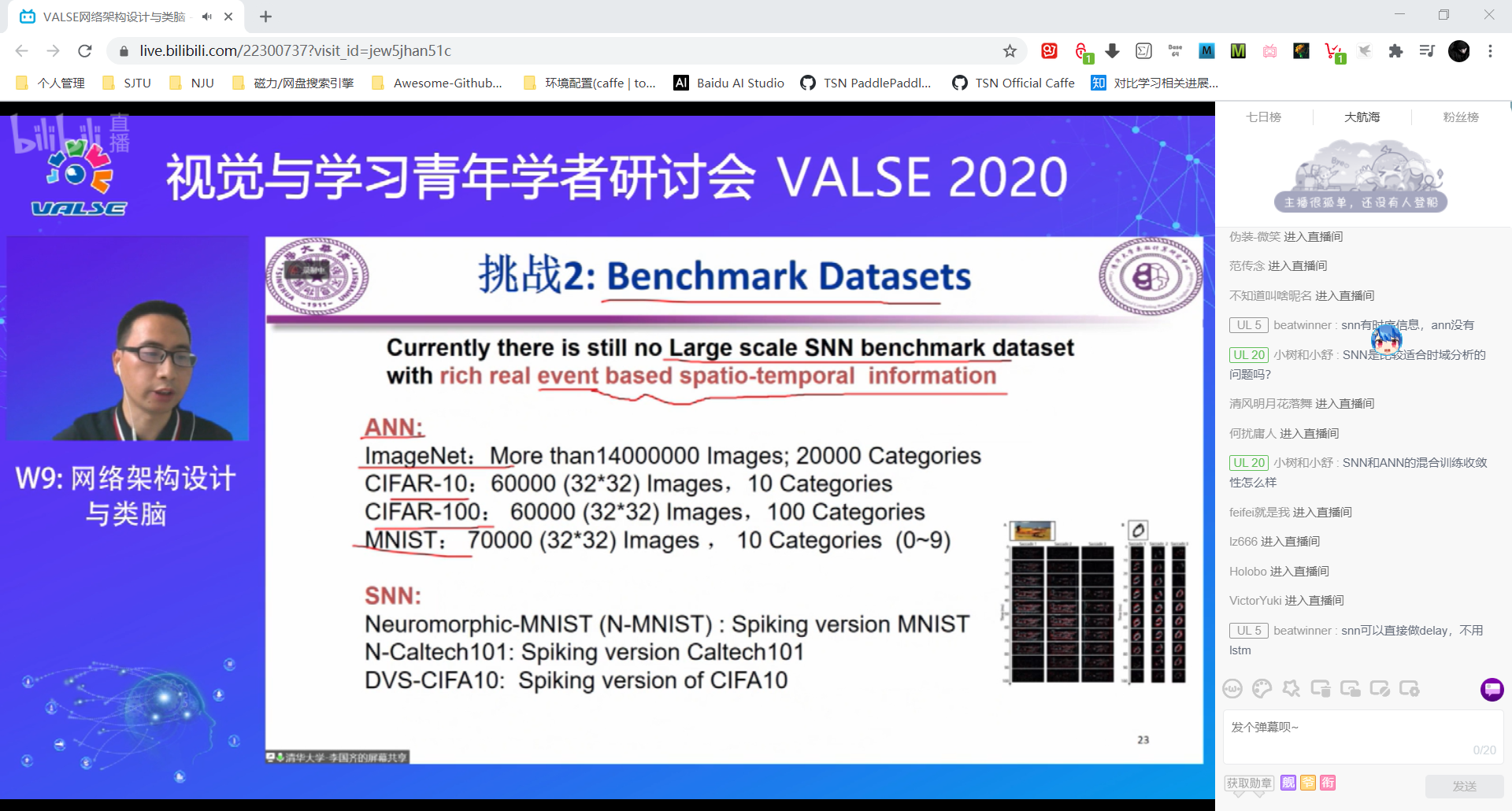

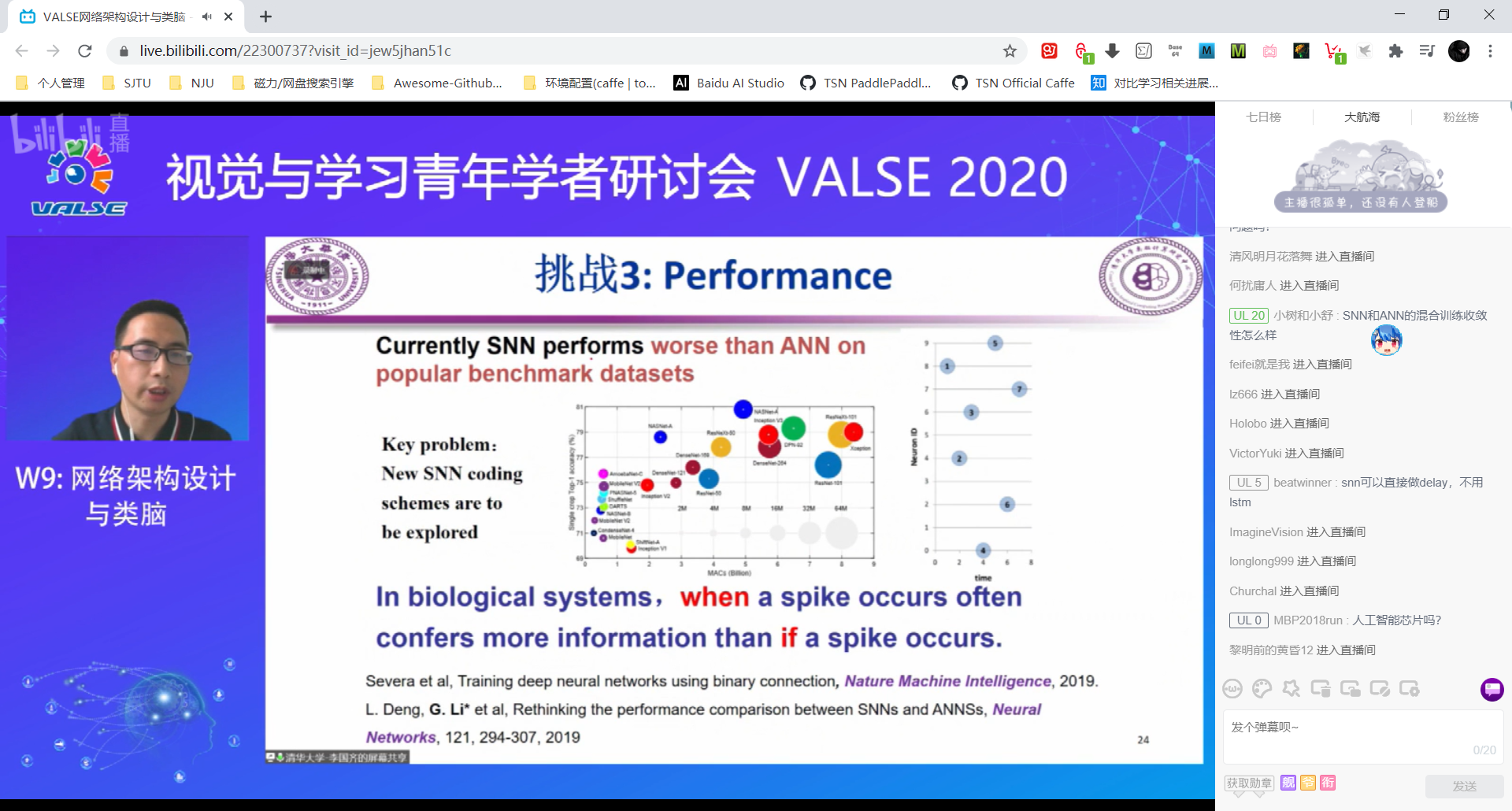

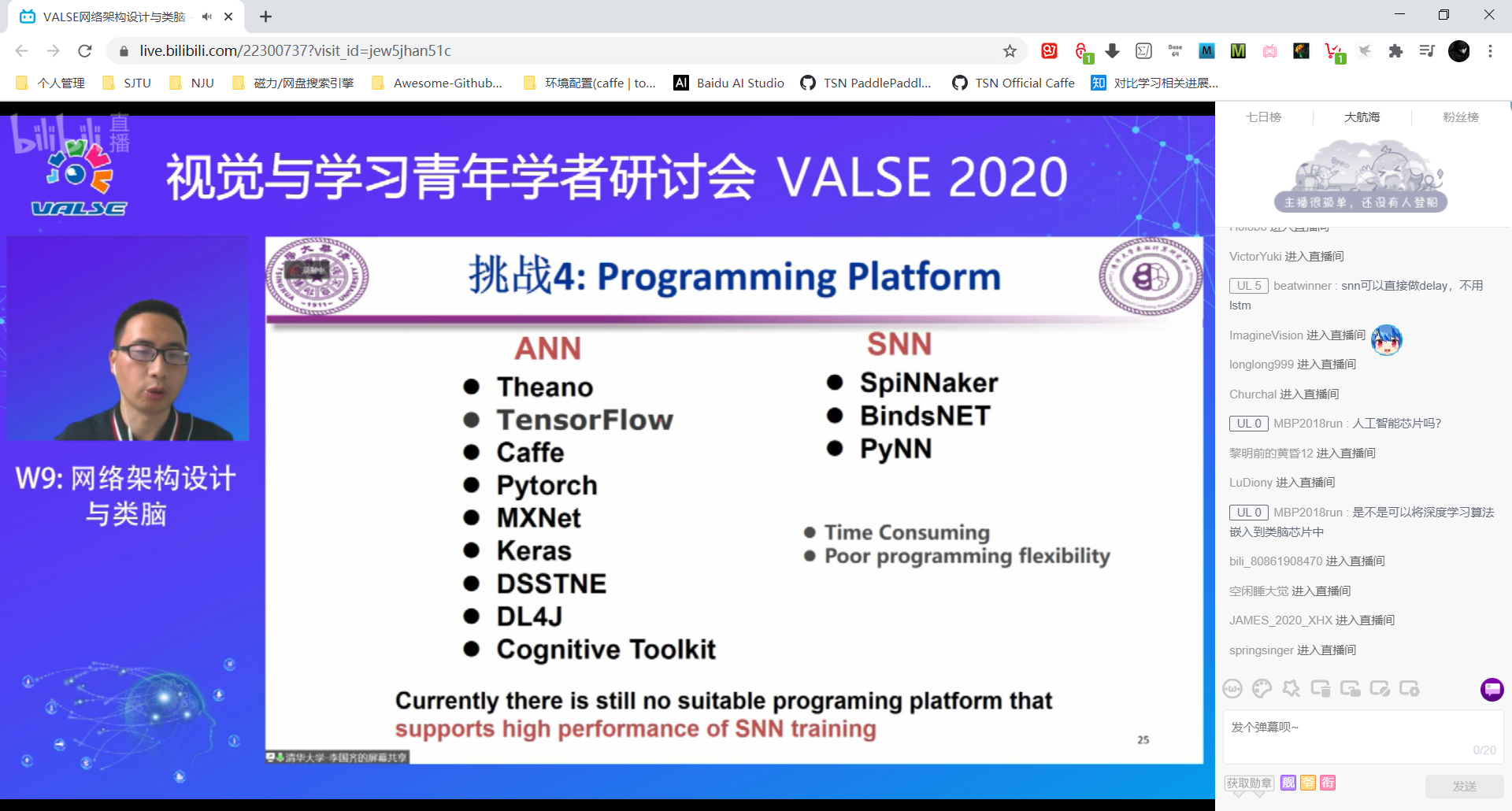

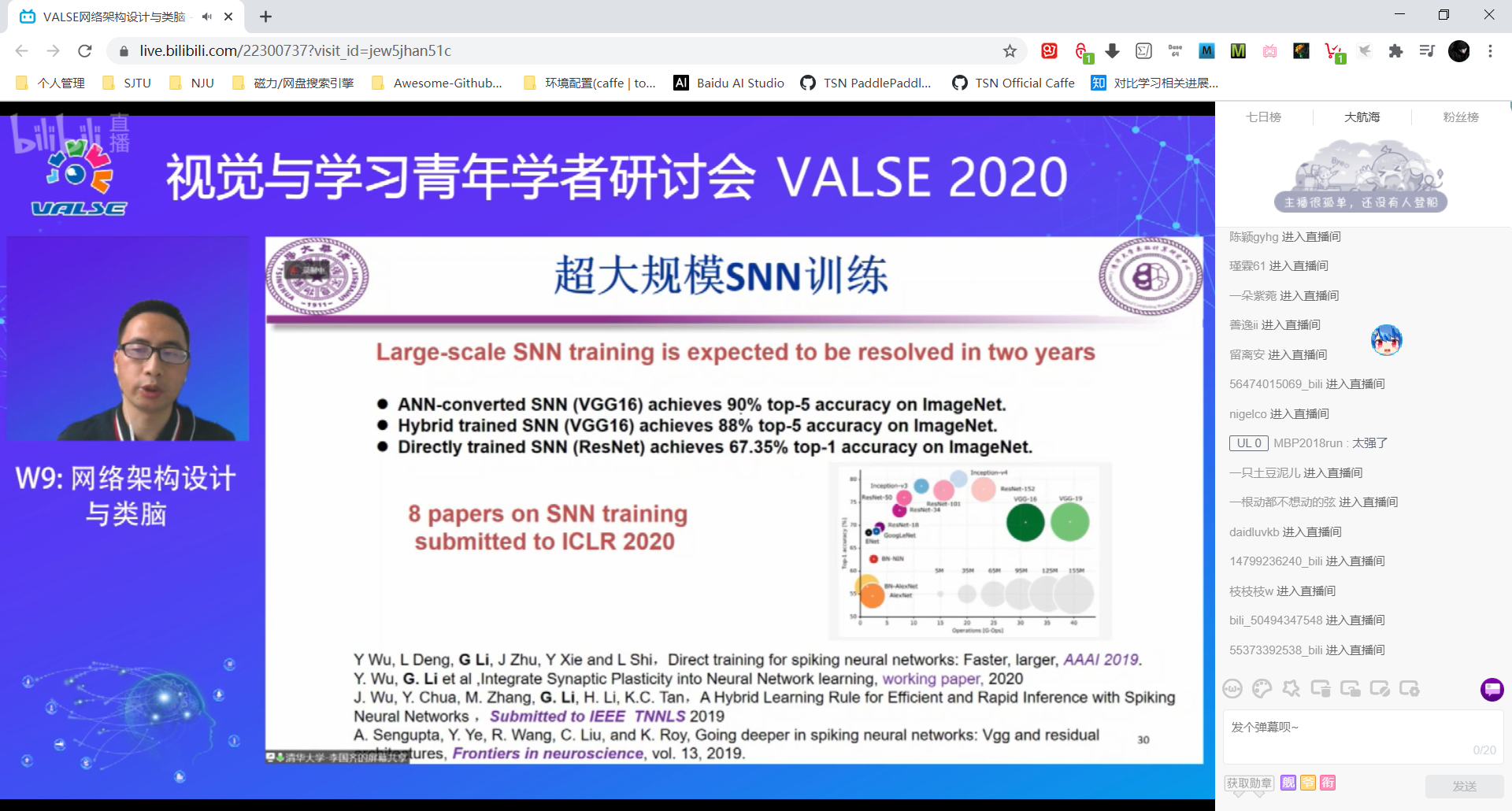

5.2 SNN脉冲神经网络的挑战

5.3 Related Works

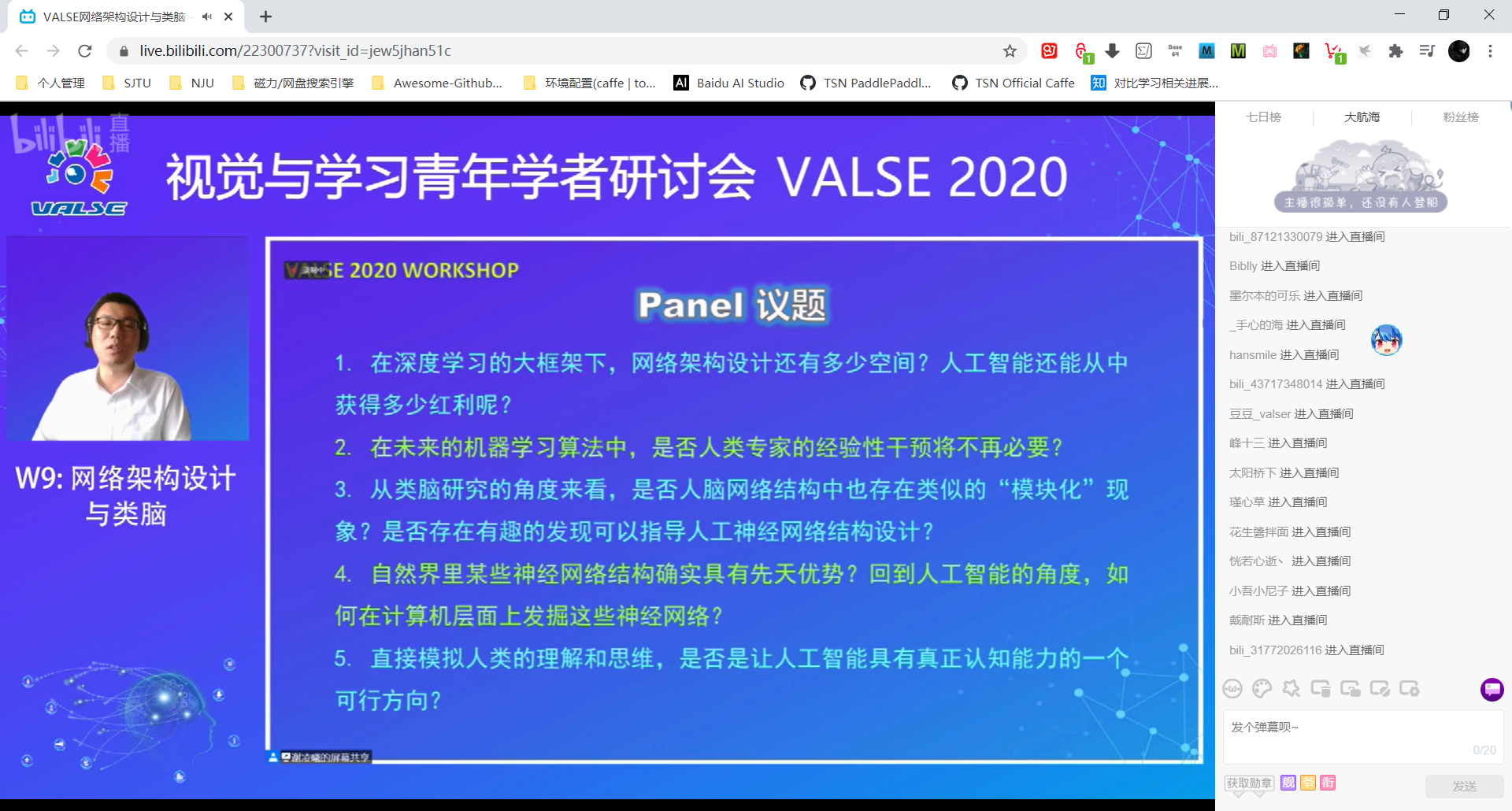

Panel (待更新)